在使用 Python 程序进行网络爬虫开发时,可能因以下原因导致被封 IP 或封禁爬虫程序:

1、频繁访问网站

爬虫程序可能会在很短的时间内访问网站很多次,从而对目标网站造成较大的负担和压力,这种行为容易引起目标网站的注意并被封禁IP或限制访问。

2、突然访问量增大

如果您的爬虫程序在较短的时间内突然增加访问量,可能会被目标网站视为恶意行为,而将其视为攻击或 DDoS 攻击、拒绝服务等行为。

3、访问限制或反爬虫策略

一些网站会在 robots.txt 文件中对爬虫访问进行限制,并且常常会针对爬虫的特定行为设置反爬虫机制。例如,检测爬虫IP、JavaScript 防护等措施。如果爬虫没有正确地遵守前述规则和协定,就可能会被封禁。

4、数据格式或请求错误

如果爬虫请求中包含错误的数据格式、请求头(HTTP Header)信息不完整或错误,或者应答内容不按正常流程处理,则会被目标网站视为异常请求或恶意请求并被封禁。

总之,如果您的 Python 爬虫程序被封,则需要确认您的程序是否有以恰当的频率和方式进行请求,并严格遵守目标网站的爬虫规则和协议。同时还应该准确定位问题,并采取有效的解决方案和调整策略,尽量减少被封或封禁的风险。

爬取不到数据也可能是触发网站反爬虫机制

反爬虫策略是一种目标网站用来阻止或限制网络爬虫程序对其内容进行采集的方法。以下是常见的反爬虫策略:

1、验证码

通过验证码验证需要在爬取过程中输入正确验证码才能进行访问,从而防止机器人攻击。

2、限制访问频率

设置 IP 爬取页面频率和爬取量的限制。如果某个 IP 的访问速度超过一定值,则视为恶意访问并限制或封禁该 IP。

3、用户行为分析

检测非人类类型访问,如识别并记录浏览器指纹、观察前后访问行为间的时间等,以便确定是否存在恶意行为。

4、User-Agent 识别

检测 HTTP 请求中的 User-Agent 字段(HTTP 请求头),如果请求来自于爬虫程序常用的 UA,则将其视为爬虫程序或恶意访问,并限制或禁止访问。

5、强制使用 JavaScript

网站可能要求客户端运行 JavaScript 才能正常显示内容,从而防止爬虫程序对目标页面进行爬取

6、动态加载内容

使用 Ajax 技术动态加载数据并涵盖在原始HTML中,增加页面分析的难度。

总之,在进行网络爬虫开发时,应该注意这些反爬虫策略,并尽可能地遵守网站的访问规则和协议,以避免被网站封禁 IP 或受到其他限制。如果您的爬虫程序需要突破这些反爬虫策略,则需要使用更高级的技术,例如模拟人类行为、使用代理 IP、使用分布式架构和其他进行反制决策等方法来绕过阻碍。

爬虫被封IP怎么解决

如果您的爬虫被目标网站封禁或限制访问,可以采取以下方法来解决:

1、暂停爬取

暂停您的爬取程序一段时间(例如数小时或数天)使其充分休息,然后逐渐递减并调整下次访问时的间隔时间。

2、更换 IP

更换爬取程序所在的 IP 地址,例如使用代理 IP 或者 VPN把请求转发到其他地址上。

3、修改 User-Agent

尝试修改HTTP请求头字段中的 User-Agent 字段,使其不再被目标网站视为恶意行为。建议各个请求都采用不同的UA,避免过度频繁地使用每一种UA

4、使用分布式架构

将爬取程序分散到多个服务器/设备上,以降低单个 IP 地址的请求量和频次。

5、优化访问速度

通过分析请求路径、数据量等因素,优化爬取程序代码和算法,从而降低对目标网站的负担和回应速度。

6、遵守网站规定与协议

始终遵守目标网站的爬虫规则和协议,在爬取过程中保持良好的行为和合理的请求方式,并测试是否有robots.txt文件中声明禁止访问的路径。

总之,当您的爬虫被封 IP 时,应该及时采取措施防止继续受到限制。在采取解决方法时,需要确认问题原因,遵循网络爬虫规则和道德约束,以避免出现身份识别、隐私保护和法律风险等问题。

python爬虫使用代理ip

可以使用 Python 程序通过代理服务器来访问目标网站。以下是使用代理 IP 的一般步骤:

1、从免费或付费代理 IP 服务提供商处获得代理 IP 列表,通常代理 IP 是一个由 IP 地址和端口组成的元组类型,例如 (123.45.67.89, 8080)。

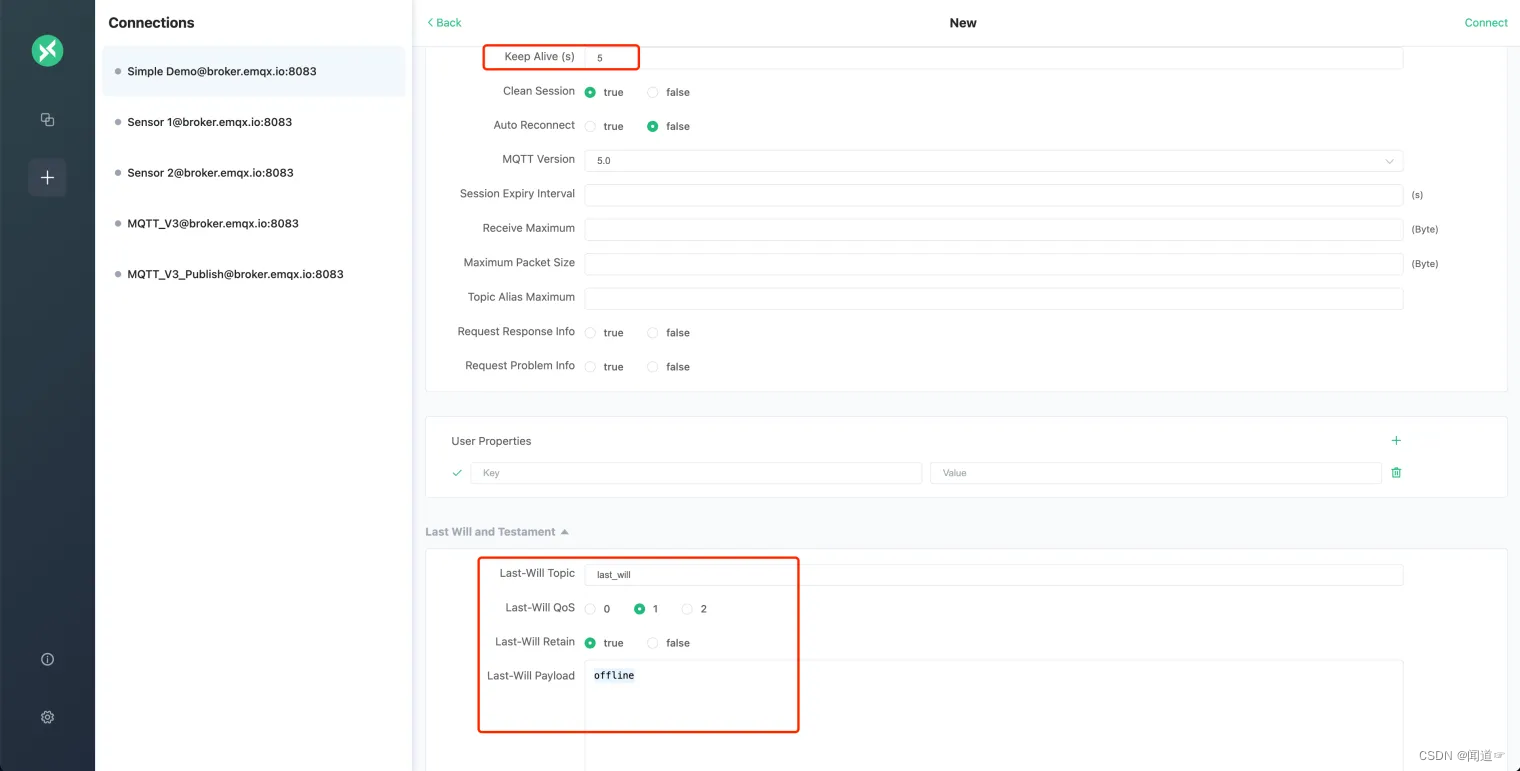

2、在 Python 程序中使用 requests 库创建一个会话对象,并使用 ‘proxies’ 参数来设置代理 IP。例如:

import requests

# 提取代理链接(http://jshk.com.cn/mb/reg.asp?kefu=xjy)

proxies = {

"http": "http://123.45.67.89:8080",

"https": "http://123.45.67.89:8080",

}

session = requests.Session()

session.proxies.update(proxies)

response = session.get("http://www.example.com")

3、测试代理 IP 是否可用:如果代理 IP 不可用,则需要更换代理 IP 或采取其他的代理 IP 轮询措施。例如,在请求响应时检查状态码和 headers,如果感觉不可靠,就可以弃用该 IP 地址。

总之,当使用代理 IP 时,我们应该选择可靠的 IP 服务提供商,并定期检测、更新和维护代理列表。在爬取过程中,遵守主机网站的规则与协议,最大限度地减少对网站产生干扰或影响。尽管使用代理IP可能有助于爬虫程序免受封禁,但我们仍需明确为何需要使用代理 IP 及怎样最大限度地减少被封禁的风险。