神经网络算法解读

机器学习流程:

- 数据获取

- 特征工程

- 建立模型

- 评估与应用

图像数据是一个矩阵300 * 100 * 3

线性函数分类方法:分类(wx+b线性回归)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-WtAo8TiC-1682758945022)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230428204017073.png)]](https://img-blog.csdnimg.cn/dec037de40c94dc8820c9bdf3d600984.png)

损失函数:预测值与实际值之间的差异值

softmax分类器:

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-rMRr35YX-1682758945023)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429112759854.png)]](https://img-blog.csdnimg.cn/73edb428d69946d8890da3e1d1b37f7b.png)

神经网络整体架构(在每一层中进行特征提取)

- 层次结构

- 神经元

- 全连接

- 非线性

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-rEbizKbL-1682758945024)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429150452403.png)]](https://img-blog.csdnimg.cn/e9cd967ab2814b8a94bdab599af16e0d.png)

引入一些非线性函数(激活函数):解决非线性问题

过拟合问题:过拟合问题是神经网络中的一个大问题—可以使用一定的方法降低过拟合问题。

卷积神经网络解读

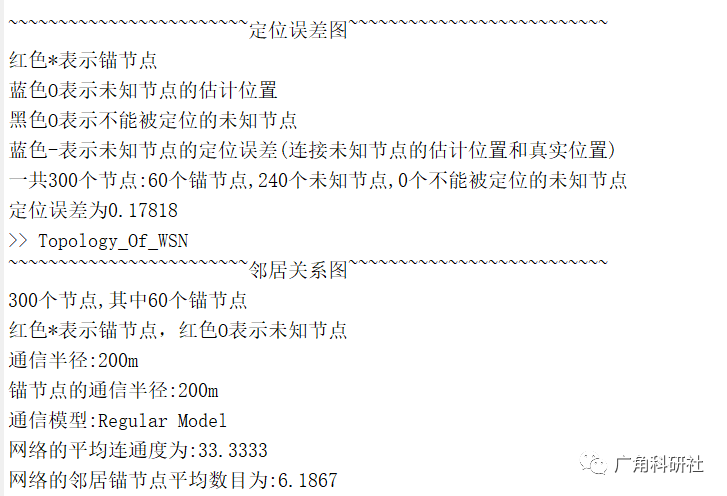

输入图像,得到特征矩阵—卷积的作用

![ssxx[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-JfSnmEZg-1682758945029)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429154527348.png)]](https://img-blog.csdnimg.cn/43b47452248648cab582633054ade886.png)

输入一张图像在3*3的区域内得到其特征值

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-eX43d0kr-1682758945030)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429154728267.png)]](https://img-blog.csdnimg.cn/ec68655dafb842ce97696f3ed2b7dff1.png)

三个蓝色的区域分别代表(R G B)三个颜色的通道。进行特征的提取

Filter:(3 * 3 * 3 ):第一3*3代表的在原始特征之中每3 * 3的区域内选择一个特征

第三个3代表的是三个通道(RGB)-和输入的维度保持一致

内积:两个向量关系大是值大,关系小时得到的值小

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-rvRvXw73-1682758945031)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429155711453.png)]](https://img-blog.csdnimg.cn/038b5b18922f4f9db835a1039bfe0b8b.png)

计算方法:对应位置相乘在求和。在输出特征值的过程中需要和b相加。

在走完每一行后依次向下走两个单位直到完全遍历完得到特征图的信息。(绿色的特征图-矩阵)

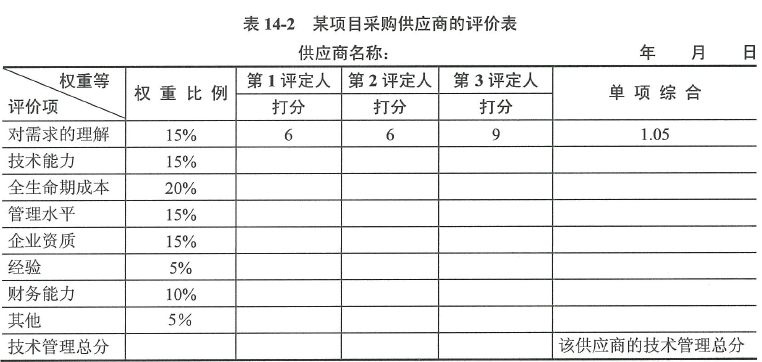

涉及到的参数:

- 卷积核(卷积核越小得到的特征越多一般都选择3*3)随机初始化

- 卷积核filterw0 filterw1根据特征预测的结果不断的调整参数

- Bias(b)也要不断的进行更新。

- 步长:一般情况下比较小,一般为1。

- padding(在周围的一圈加0-在里面的像素点计算次数多)-边缘填充

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-MnqF6eTe-1682758945032)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429161240169.png)]](https://img-blog.csdnimg.cn/786396bdeaef4f69b4756e7e7ae06056.png)

卷积层涉及参数

卷积层:进行特征提取的

- 滑动窗口步长

- 卷积核尺寸(3 * 3 5 * 5)

- 边缘填充

- 卷积核个数(尽量多)

卷积运算不能只做一次,需要做多次

第二层的运算是在第一层的基础上进行运算-可以看到的特征更多,层次越多看到的特征越是全局的特征。—深层信息

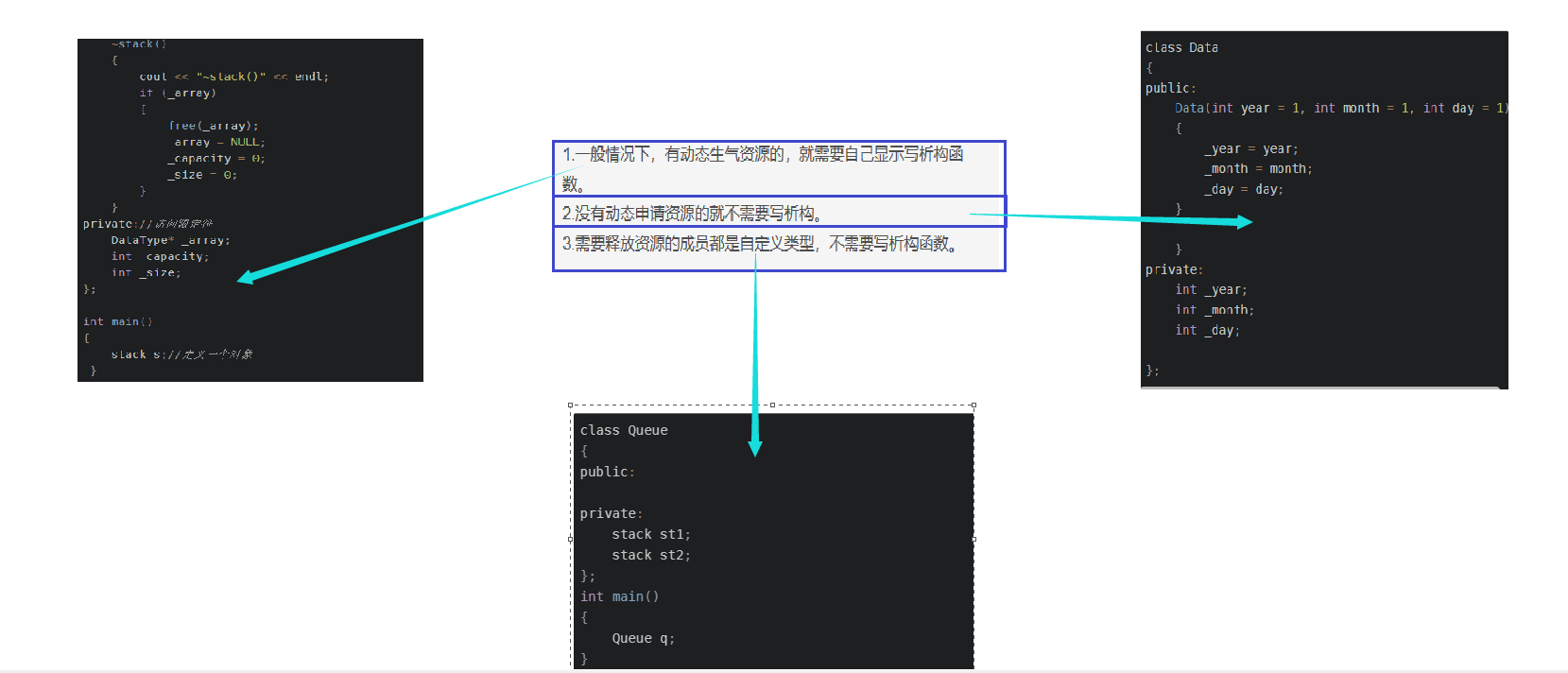

其中引入了一个概念:感受野

感受野

特征图中的一个点相当于图片中多大的区域,层数越多感受野越大。

感受野从3 * 3 到 5 * 5的区域

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-jvB3vB9e-1682758945033)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429165004588.png)]](https://img-blog.csdnimg.cn/71ceab18b6574026a6d919a6c0fd67ea.png)

卷积结构的计算公式

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-50sQ5gi9-1682758945034)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429162239908.png)]](https://img-blog.csdnimg.cn/158b9ad05dab4db68b7888f16adc4eb0.png)

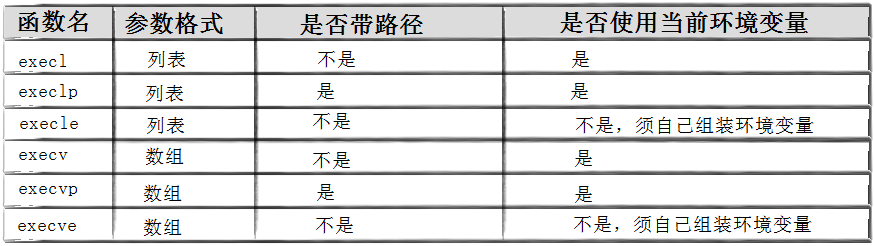

池化层

输入是一个特征图进行压缩的一个过程。

h w进行压缩二c(第三个参数不变)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-V5Entyl8-1682758945034)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429162945920.png)]](https://img-blog.csdnimg.cn/1c0503541be54a17903406085347f8d2.png)

Max_pooling:最大池化

数值大的特征学的越来越大,不重要的特征学的越来越小。

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-hNoPCFz3-1682758945035)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429163244662.png)]](https://img-blog.csdnimg.cn/928ac24bb1d24b3dbdbb17839e301e26.png)

![[外链图片转存失败,源站可能有防盗链机制,建议将图片保存下来直接上传(img-6lqClHnn-1682758945036)(C:\Users\Lenovo\AppData\Roaming\Typora\typora-user-images\image-20230429163428085.png)]](https://img-blog.csdnimg.cn/f1fa1cacc1ae49d8a38186cf99e96b94.png)

包括了:卷积层,激活函数层,池化层,fc(全连接层进行输出)

经典卷积神经网络:

- AlexNet

- Vgg(3*3)

- Resnet 15年 何凯明