Abstract

核心问题

-

挑战 语音风格包含细微的

多样化信息(如情感、语调、节奏),传统基于标签/模板的标注方法难以充分捕捉,制约了语音-语言多模态模型的性能。 -

数据瓶颈: 大规模数据收集与高质量标注之间存在矛盾,亟需自动化标注系统构建兼顾规模与深度的数据集。

创新方法:自动语音标注系统

-

- 多模态特征提取:

- 专家分类器:针对语音特性(如情感分类、音高检测、节奏分析)设计专用模型,提取结构化特征。

- 描述模型:生成初步的文本描述,为后续细化提供基础。

-

2.自然语言标注生成

- 使用微调的LLaMA模型,将结构化特征与初步描述融合,生成自然语言风格提示(如“急促的语速中带有愤怒,伴随断续的喘息声”)。

- 优势:突破传统标签的局限性,提供更丰富、上下文相关的描述。

举例解释

假设听到一段语音,里面的人说话急促、声音颤抖、还带着哭腔。一听就知道TA在害怕。但现在的AI很难把这种“害怕”的语音风格转化成准确的文字描述,比如它可能只会标个“负面情绪”,但无法描述细节(比如“颤抖的哭腔”)。这就是论文要解决的难题:如何让AI像人类一样,用自然语言详细描述语音中的风格细节?

过去的方法就像给语音贴标签,比如“生气-快语速”。但现实中,语音风格可能是复杂的,比如:“生气但压低声音,偶尔停顿,带着讽刺的冷笑”。标签根本无法表达这些细节。

解决方案:让AI自己写“语音小作文”

论文团队发明了一个自动写描述的系统,流程像工厂流水线:

- 第一步:拆解语音特征:

- 用多个“专家工具”分析语音:

- 情感检测器 → 判断是生气、开心还是悲伤

- 节奏分析仪 → 计算说话快慢

- 音高扫描仪 → 检测声音尖锐还是低沉

- 用多个“专家工具”分析语音:

- 第二步:生成自然语言描述:

把上面所有检测结果喂给一个会写作文的AI(微调后的LLaMA),让它把冷冰冰的数据变成生动的句子。- 例:

- 输入数据:情感=愤怒(强度80%)、语速=快(120字/分钟)、呼吸声=明显

- 输出描述:“急促的语速中带有强烈的愤怒,呼吸粗重,仿佛在努力克制情绪”。

- 例:

用这个系统,他们做了一个超大语音数据集:

- 内容:2000小时语音,200万条录音,覆盖各种场景(吵架、演讲、电影对白…)

- 标注特点:每条语音都配有一句“小作文”描述风格(中英双语)。

各种数据集对比

各语料库特点

FSNR0:

- 关注简单的风格标签,如“悲伤”(sad)。

- 示例:“Seem sad” 表示语音听起来悲伤。

NLSpeech:

- 使用自然语言描述风格,结合多种属性。

- 示例:“A distressful male sound appeared in low volume” 描述了一个低音量的、痛苦的男性声音。

PromptSpeech:

- 强调语音的情感和物理特性。

- 示例:“A heartbroken woman’s voice, almost a murmur” 描述了一个几乎像耳语的伤心女性声音。

TextrolSpeech:

- 关注语音的节奏和音调变化。

- 示例:“Speaking at a fast pace, the pleasing male sustains a regular pitch and energy” 描述了一个以快速度说话的、令人愉悦的男性声音,保持稳定的音高和能量。

SpeechCraft(作者提出的语料库):

- 引入了更多细粒度的属性,如年龄、话题、强调和转录本。

- “Reflecting on a topic in the fields of Health and Fitness, a sad youth with low pitch and normal volume states, ‘Well, you know, life is holistic, Dave.’ She speaks at a fast pace, signifying her sadness.”

- 这里描述了一个在健康和健身领域反思话题的悲伤年轻人,声音低沉、音量正常,快速说话,表达了她的悲伤。

- 另一个示例涉及讨论肖像画的自然女性声音,高音、正常音量,快速说话,强调了“fascinates”这个词。

Introduction

-

现有技术的局限性:

- 语音合成(TTS):当前模型(如VALL-E、Natural Speech 2)缺乏对语音风格的细粒度控制(如情感强度、重音位置)。

- 语音理解(ATT):音频描述模型(如SALMONN、Qwen)只能生成粗粒度描述(如“男人说话,狗在叫”),无法捕捉说话风格细节(如“愤怒的颤音、讽刺的停顿”)。

- 数据瓶颈:现有开源数据集(如VCTK、LibriTTS)缺乏对语音风格(韵律、身份、情感、语境)的细粒度标注,制约模型能力提升。

-

研究目标:

构建大规模、细粒度标注的语音数据集,支持:- 可控语音合成:通过自然语言精准控制语音风格(如“强调第二个词,语速渐快”)。

- 深度语音理解:生成包含说话人身份、情感、场景的详细描述。

创新方法:自动语音标注系统

-

多维度语音分析:

- 基础属性分类器:检测性别、情感、音高等。

- 韵律特征提取:分析词汇重音(如句子中的关键词强调)、主题信息(如对话场景是商务谈判还是日常聊天)。

- 专家模型协作:结合多个专用模型(如音高检测器、情感分类器)提取结构化特征。

-

自然语言生成(LLM驱动):

- 使用微调的LLaMA 2模型,将结构化特征转换为定制化自然语言描述。

- 关键改进:

- 摒弃传统模板(如“情感=生气,语速=快”),生成自由文本(如“声音低沉,每句话结尾刻意拖长,带有威胁语气”)。

- 支持中英双语,提升标注多样性与细节丰富度。

SpeechCraft数据集特点

- 规模与构成:

- 数据量:2000小时语音,超200万片段(目前最大开源语音风格数据集)。

- 来源:整合AISHELL-3、Zhvoice、LibriTTS-R等四大双语数据集,覆盖多样化场景(演讲、对话、影视等)。

- 标注内容:每条语音对应自然语言风格描述,包含:

- 说话人身份(如“年轻女性,带南方口音”)。

- 情感与韵律(如“激动,句末音调上扬”)。

- 场景与主题(如“会议讨论,背景有键盘敲击声”)。

实验与贡献

-

实验结果:

- 语音合成(TTS):

- 使用SpeechCraft训练的模型可通过文本指令精准控制重音位置(如“强调‘绝对不行’中的‘绝对’”),MOS评分提升12%。

- 支持复合风格生成(如“悲伤但强装镇定,伴随轻微鼻音”)。

- 语音理解(SST):

- 音频描述任务中,生成的文本包含说话人身份识别(如“中年男性,声音沙哑”)和场景推断(如“户外促销活动,背景有嘈杂人声”),F1分数提升18%。

- 语音合成(TTS):

-

三大贡献:

- 方法论:首个全自动细粒度语音标注系统,结合专家模型与LLM生成自然语言描述。

- 数据集:开源最大规模双语语音风格数据集SpeechCraft,填补研究空白。

- 应用突破:首次实现基于自然语言的语音重音控制与多维度音频描述生成(超越传统事件检测)。

RelatedWorks

Tag-basedSpeechDatasets

1. 什么是基于标签的语音数据集?

传统语音数据集通过**标签(Tags)**标注语音特征,例如:

- 说话人身份(Speaker ID):标记“男性-25岁-美国口音”。

- 情感分类(Emotion Labels):标记“生气、开心、悲伤”。

- 基础属性:语速(快/慢)、音高(高/低)、性别等。

典型数据集:

- TESS:包含7种基础情感(如愤怒、恐惧)的录音,由演员表演。

- IEMOCAP:多人对话数据集,标注情感类别(如“中性、兴奋”)。

- VCTK:多说话人语音库,主要标注说话人ID和文本内容。

2. 基于标签的数据集的应用

这些数据集推动了以下技术发展:

- 语音克隆(Voice Cloning):通过说话人ID标签,AI学习模仿特定人的声音(如用1分钟语音克隆特朗普的音色)。

- 一次性语音合成(One-shot TTS):输入一段陌生人的语音和文本,AI合成该人声音的新句子。

- 情感语音合成:输入标签“悲伤”,AI生成带有悲伤语调的语音。

- 语音情感识别(SER):通过标签训练AI判断语音中的情感类别。

3. 局限性:为什么标签不够用?

尽管标签推动了早期研究,但其缺陷在复杂场景中逐渐暴露:

3.1 情感分类过于简化

-

问题:现实中的情感是混合且渐变的,但标签只能表达单一类别。

例子:- 真实场景:某人强忍泪水,声音颤抖但试图保持平静。

- 标签限制:传统数据集只能标注“悲伤”或“中性”,无法描述“压抑的哽咽声”或“声音颤抖的强度变化”。

-

数据偏差:情感数据集多由演员“表演”录制(如刻意大笑或怒吼),与真实场景差异大(日常对话中的情绪更微妙)。

3.2 缺乏细粒度控制

- 语音合成的“僵硬感”:

输入标签“生气”生成的语音可能只是整体提高音量,无法实现细节控制(如“前半句平静,后半句突然爆发”)。

对比案例:- 传统标签:生气 + 快语速 → 合成效果:全程大吼,机械感强。

- 自然语言描述:“前半句压低声音,后半句语速加快,伴随急促呼吸声” → 合成效果更自然且有层次感。

3.3 忽略韵律细节

- 重音与语调:标签无法标注句子中关键词的强调(如“我没说你可以走”中的“没”需加重)。

- 后果:合成的语音可能重点模糊,听众难以抓住语义核心。

3.4 数据多样性不足

- 模板化标注:许多数据集使用固定模板填充属性,如“性别=女,情感=开心,语速=中”。

- 结果:生成的描述千篇一律,缺乏个性化(如“欢快的笑声中夹杂着咳嗽声”这类复杂场景无法表达)。

4. 新方法的突破:从标签到自然语言描述

SpeechCraft的自动标注系统如何超越传统标签?

4.1 从“贴标签”到“写作文”

- 传统方法:像在快递盒上贴标签(仅写“易碎品”)。

- 新方法:像写一份包裹说明(“内部为玻璃花瓶,倾斜时可能发出轻微碰撞声,需避免震动”)。

技术实现:

- 多维度分析:

- 不仅检测基础属性(性别、情感),还分析韵律(重音位置、停顿节奏)、场景(背景噪声、对话上下文)。

- 自然语言生成:

- 用大语言模型(LLaMA 2)将分析结果转化为自由文本,例如:

“女性声音,语速先快后慢,在‘必须’一词上加重,背景有键盘敲击声,语气坚定但略带疲惫。”

- 用大语言模型(LLaMA 2)将分析结果转化为自由文本,例如:

4.2 实际优势举例

- 语音合成控制:

- 指令:“生成一段语音,前半句轻柔,在‘梦想’一词拉长音调,后半句加速,充满激情。”

- 模型利用自然语言描述精准调整合成参数,实现动态风格变化。

- 语音理解升级:

- 输入一段争吵录音,AI生成描述:“男女对话,男方音调升高,频繁打断对方,关键词‘承诺’重复两次,背景有摔门声。” → 更深度理解对话冲突。

NaturalLanguageStylisticDatasets

1. 从“标签”到“自然语言描述”的进化

早期的语音数据集用标签(如“生气、快语速”)标注语音,但这种方式过于简化。后来,研究者尝试用自然语言描述语音风格,比如:“声音颤抖,语速忽快忽慢,带着压抑的哭腔”。这一进化分为几个阶段:

-

人工标注时代:

- 代表作:InstructTTS(2022年)

- 方法:雇人听语音,从三个层次描述情感(如“表层情绪是愤怒,深层情绪是失望,伴随呼吸急促”)。

- 缺点:成本极高,数据规模小(人工标注100小时语音可能需要数月)。

-

模板生成时代:

- 代表作:PromptTTS、MM-TTS

- 方法:用预定义的“风格因子”(如性别、音高、语速、情感)组合生成模板。例如:

- 输入:情感=悲伤,语速=慢 → 生成描述“缓慢而悲伤的声音”。

- 缺点:模板固定,组合有限,缺乏灵活性(比如无法描述“悲伤中夹杂苦笑”)。

-

大模型(LLM)辅助时代:

- 代表作:TextrolSpeech(目前最大开源风格语音数据集)

- 方法:用ChatGPT根据标签生成多样化模板(如“情感=开心”对应多个句子:“欢快的声音如春风”或“语调轻快,带着笑意”)。

- 优点:提升描述多样性。

- 缺点:仍依赖预定义标签,未结合真实音频特征(见下文分析)。

2. 现有数据集的局限性:组合爆炸 vs. 真实细节

2.1 组合数量有限

以TextrolSpeech为例:

- 预定义风格因子:5个(性别、音高、语速、音量、情感)。

- 每个因子的选项:

- 情感:8种(如开心、悲伤)

- 性别:2种(男/女)

- 音高:3种(高/中/低)

- 语速:2种(快/慢)

- 音量:2种(大/小)

- 总组合数:8×2×3×2×2 = 432种。

问题:

- 真实语音的风格组合远超过432种(例如“开心但强忍泪水”或“愤怒中带讽刺”无法被覆盖)。

- 后果:两个不同的语音片段若标签相同,生成的描述会完全一致,丢失细节差异。

例子:

- 语音1:某人开心大笑,语速快,背景有掌声。

- 语音2:某人假装开心,语速快,声音僵硬。

- 标签:情感=开心,语速=快 → 两者生成相同描述:“欢快的快语速”。

- 缺失信息:语音2的

“假装”情绪和僵硬感无法被捕捉。

2.2 脱离真实音频的“纸上谈兵”

现有方法(如TextrolSpeech)的致命缺陷:

- 生成逻辑:仅根据文本标签(如“情感=中性”)让LLM描述,未分析真实音频特征。

- 后果:描述可能与实际语音不符,成为“虚构的文学创作”。

对比案例:

- 真实语音:一段中性语气的演讲,但说话人频繁清嗓子,声音沙哑。

- 传统方法:标签=中性 → 生成描述:“平稳的中性语调”。

- 理想描述:“声音沙哑,句间有清嗓声,整体语气平稳但略显疲惫”。

3. 理想解决方案:结合音频分析与自由生成

本文的自动标注系统如何突破上述局限?

3.1 核心思想:让AI“边听边写”

-

步骤1:深度分析音频

用多个专家模型提取真实特征:- 基础属性:性别、音高、语速(传统标签)。

- 韵律细节:重音位置(如“我要去”中的“要”被加重)、停顿频率。

- 场景信息:背景噪声(如键盘声、风声)、说话人身份(如“青年男性,带广东口音”)。

-

步骤2:动态生成描述

将分析结果输入微调的LLaMA 2模型,生成定制化描述。

关键优势:- 每个语音片段的描述独一无二(即使标签相同,细节不同则描述不同)。

- 结合真实音频特征,避免“虚构”。

3.2 实际效果对比

以同一标签“情感=中性”为例:

- 传统模板法:生成10条语音,描述均为“中性语调,语速适中”。

- 本文方法:

- 语音A(疲惫中性)→ “声音低沉,句尾气息微弱,偶有咳嗽”。

- 语音B(冷静中性)→ “语调平稳,关键词发音清晰,背景安静”。

- 语音C(紧张中性)→ “语速稍快,句间停顿短促,喉音明显”。

4. 为什么说这是技术突破?

- 数据质量:描述与真实语音特征严格对齐,提升模型训练可靠性。

- 规模与成本:自动标注200万条语音的成本远低于人工(节省数百万美元)。

- 应用价值:

- 语音合成:输入“模仿语音A的描述”即可复现疲惫感。

- 语音鉴定:通过描述细节判断录音是否被编辑(如背景声异常)。

未来想象:

- AI配音师:导演输入“角色在雨夜独白,声音沙哑,每句话前深吸气” → AI自动生成符合要求的语音。

- 情绪辅助诊断:通过分析语音描述中的“颤抖、停顿”辅助识别心理状态。

Auto-captioningfromAudiotoSpeech

1. 什么是音频/语音描述?

- 任务定义:让AI听一段音频(比如对话、环境声、演讲),然后用自然语言生成一段文字,描述其中的声音内容、语音风格和上下文信息。

- 例子:

- 输入:一段争吵录音 → 输出:“一男一女激烈对话,男方声音高亢,频繁打断对方,背景有摔门声。”

- 输入:一段雨夜独白 → 输出:“女性声音低沉,语速缓慢,伴随雨声和偶尔的雷鸣,语气充满孤独感。”

- 例子:

2. 技术发展:从“听声音”到“写描述”

2.1 大规模音频描述数据集

- 推动技术:类似CLIP的图像-文本对比学习模式被应用到音频领域,诞生了AudioClip和CLAP等模型。

- 原理:

- 模型学习“声音片段-文本描述”的配对关系。例如,听到鸟叫声,生成“清晨林间鸟鸣”。

- 对比学习:让模型区分匹配的“音频-文本”对和不匹配的对(如鸟叫 vs. “汽车轰鸣”)。

- 原理:

2.2 语音描述的独特挑战

- 语音 ≠ 普通音频:语音包含复杂的说话人风格(身份、情感、口音)和语言语义(内容含义)。

- 传统音频模型:擅长描述环境声(如“狗叫、音乐声”),但无法捕捉语音中的情感细节(如“压抑的愤怒”)。

- 语音专用模型:如SECap,专注于从语音中提取情感信息并生成描述。

3. SECap框架:语音情感描述的突破

3.1 核心方法

- 小规模人工标注:SECap基于少量人工标注的语音情感数据(如“声音颤抖,带着哭腔”)。

- Q-former策略:

- 作用:从语音中分离情感相关特征(如颤抖、音调变化)和一般语义特征(如说话内容)。

- 类比:就像从一杯咖啡中分离出“苦味”和“香气”,让模型专注分析情感成分。

3.2 在本文系统中的应用

- 提取情感特征:SECap帮助自动标注系统捕捉语音中的情感细节(如“强忍泪水的哽咽声”)。

- 增强LLM输入:将情感特征输入大语言模型(LLaMA 2),生成更丰富的描述(如“声音颤抖,语速忽快忽慢,试图保持平静”)。

4. 现有技术的不足

4.1 描述维度单一

- 仅限情感:当前模型只能描述情感(如生气、开心),无法覆盖其他风格维度:

- 说话人身份(如“青年男性,带广东口音”)。

- 韵律细节(如“句尾音调上扬,关键词加重”)。

- 场景信息(如“会议讨论,背景有打字声”)。

例子对比:

- 现有模型输出:“说话人听起来很生气。”

- 理想输出:“中年男性,声音沙哑,语速快且不规律,在‘必须’一词上加重,背景有键盘敲击声,语气充满不耐烦。”

4.2 缺乏全局描述能力

- 片段化描述:现有模型生成的描述像“碎片化标签”(如“生气、快语速”),而非完整句子。

- 无法串联上下文:例如,无法描述“前半句平静,后半句突然爆发”的动态变化。

5. 未来方向:从“情感描述”到“全风格描述”

5.1 技术需求

- 多维度特征提取:同时分析情感、身份、韵律、场景等。

- 动态语言生成:用LLM将多维特征整合为连贯的自然语言描述(如“声音先轻柔后激昂,伴随逐渐加快的语速”)。

5.2 应用场景

- 无障碍技术:为听障者生成包含说话人情绪和场景的详细字幕。

- 语音取证:通过描述细节(如背景噪声异常)判断录音真实性。

- 个性化语音助手:根据用户实时情绪调整回应风格(如焦急时加快语速)。

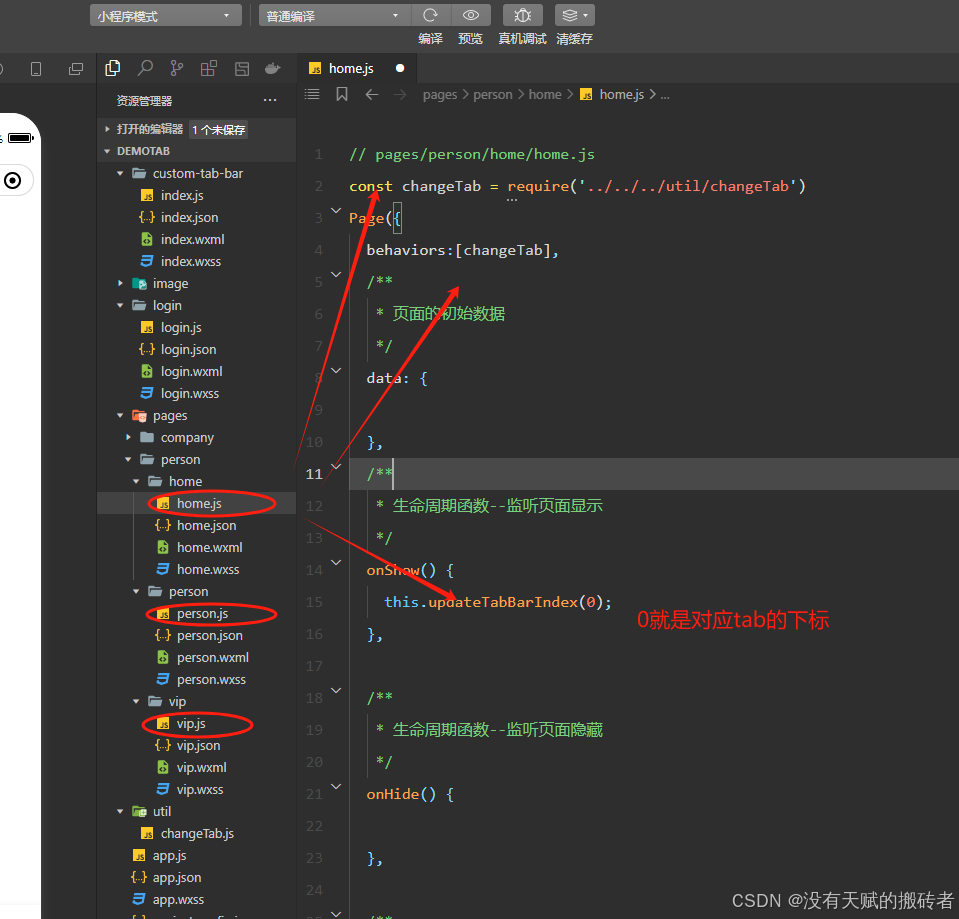

总体流程

图一

这张图展示了语音表达风格的自动标注系统框架,以下是详细说明:

系统框架概述

- 目标:开发一个自动化的语音标注系统,用于生成语音表达风格的自然语言描述。

- 输入:野外语音数据(In-the-wild Speech Data),包括原始音频(Raw Audio)和元数据(Meta Data)。

- 输出:语音表达风格的自然语言描述(Natural Language Description of Speech Expressiveness)。

主要模块

1. 数据准备(Data Preparation)

- 功能:对原始音频进行预处理,生成去噪音频(Denoised Audio)和转录本(Transcript)。

- 子模块:

- 语音增强器(Speech Audio Enhancer):用于去除音频中的噪音,提高音频质量。

- 自动语音识别(ASR):将音频转换为文字,生成转录本。

- 大语言模型(LLM):用于生成语音的自然语言描述。

2. 语音风格识别(Speech Style Recognition)

- 功能:识别语音中的各种风格属性,如音高、能量、速度、年龄、性别、情感基调、强调和话题。

- 子模块:

- 信号处理工具(Signal Processing Tools):包括语音分析器(分析能量、音高、速度)。

- 说话者信息识别(Speaker Info Identify):包括年龄预测器和性别预测器。

- 情感字幕模型(Emotion Captioning Models):包括SECap和Emotion2vec,用于识别情感基调。

- 韵律检测工具(Prosody Detection Tools):包括强调检测器,用于识别语音中的强调部分。

3. 语音风格属性(Speech Style Properties)

- 功能:提取和整合语音的风格属性,包括音高、能量、速度、年龄、性别、情感基调、强调和话题。

4. 重写(Rewriting)

- 功能:利用Expertised LLaMA 2模型,将提取的语音风格属性整合成自然语言描述。

- 子模块:

- Expertised LLaMA 2:一个经过训练的大语言模型,用于生成自然语言描述。

示例流程

- 输入:一个关于政治新闻的野外语音数据,包含原始音频和元数据。

- 数据准备:

- 原始音频通过语音增强器去噪,生成去噪音频。

- 原始音频通过ASR生成转录本。

- 大语言模型(LLM)对语音进行初步分析。

- 语音风格识别:

- 信号处理工具分析语音的能量、音高和速度。

- 说话者信息识别模块预测说话者的年龄和性别。

- 情感字幕模型识别语音的情感基调。

- 韵律检测工具识别语音中的强调部分。

- 语音风格属性:

- 提取并整合语音的音高、能量、速度、年龄、性别、情感基调、强调和话题等属性。

- 重写:

- 利用Expertised LLaMA 2模型,将提取的语音风格属性整合成自然语言描述。

输出示例

Within the realm of politics, an old man with low pitch and moderate volume expresses his opinion at a slow pace, stating, "The way he talks about people", his anger evident in his speech, accentuating the word "people" distinctly.

数据准备(Data Preparation)

1. 数据准备的背景与目标

语音数据通常来源于多样化的渠道(如网络公开视频、用户上传录音、专业有声书等),其质量参差不齐(如背景噪声、低采样率)且元数据格式混乱(如标题、描述不统一)。数据准备的核心目标是通过系统化处理,将原始语音转化为高质量、标准化的数据集,为后续的语音风格识别与描述生成奠定基础。

2. 数据预处理流程

2.1 语音质量增强(Speech Enhancement)

- 适用场景:非专业录音(如用户手机录音、街头采访)。

- 技术方法:

- 降噪(Noise Reduction):使用深度学习模型(如RNNoise)分离人声与背景噪声。

- 去混响(Dereverberation):消除房间回声(适用于会议录音或空旷环境录音)。

- 音量均衡(Loudness Normalization):统一音频响度(避免部分片段过小或爆音)。

例子:

- 原始音频:一段街头采访,背景有车辆鸣笛声。

- 增强后:人声清晰,背景噪声降低70%,音量稳定。

2.2 语音内容转录(Transcription)

- 工具选择:使用Whisper Large-v3模型(OpenAI开发的多语言语音识别模型)。

- 优势:

- 高准确率:尤其在嘈杂环境下表现优于传统ASR(自动语音识别)系统。

- 多语言支持:支持中英双语及其他近百种语言。

- 流程:

- 输入音频 → 分帧处理 → 语音识别 → 输出文字内容。

- 若原始数据已提供转录文本,跳过此步骤。

- 优势:

例子:

- 输入:一段中文会议录音 → 输出:“第二季度预算需削减10%,各部门需重新提交计划。”

2.3 元数据标准化(Metadata Standardization)

-

元数据来源:

- 标题(Title):如视频标题“2023产品发布会”。

- 原始描述(Raw Descriptions):用户上传时填写的文字(如“深夜独白,心情低落”)。

- 网站标签(Video Category Tags):如“教育、科技、娱乐”。

-

处理步骤:

- 数据清洗:去除无关信息(如广告链接、特殊符号)。

- 主题归纳:使用语言模型(如GPT-3.5)整合多来源元数据,生成统一主题标签。

- 输入:标题=“AI伦理讨论”,描述=“专家圆桌会议”,标签=“科技、哲学”。

- 输出:主题=“科技-人工智能伦理研讨会”。

例子:

- 原始元数据:

- 标题:“深夜电台节目片段”

- 描述:“主播分享孤独感,背景有轻音乐”

- 标签:“情感、生活”

- 标准化后:主题=“情感倾诉-孤独主题电台节目”。

3. 技术细节与工具选择

3.1 语音增强系统

- 工具:开源工具包Demucs(擅长人声分离)或商业软件iZotope RX。

- 参数配置:

- 采样率统一为16kHz(平衡质量与计算效率)。

- 音频格式统一为WAV(无损格式,避免压缩损失)。

3.2 Whisper Large-v3配置

- 模型版本:large-v3(参数量15亿,支持长上下文)。

- 语言检测:自动识别输入音频语种,无需预先指定。

- 输出格式:包含时间戳的逐句转录(便于对齐语音与文本)。

3.3 元数据整合模型

- 模型选择:轻量级语言模型(如DistilBERT)或LLM(如GPT-4 Turbo)。

- 提示词设计(Prompt Engineering):

任务:根据以下信息生成语音主题标签 输入标题:{title} 输入描述:{description} 输入标签:{tags} 输出格式:主题分类(如“科技-人工智能伦理研讨会”)

4. 数据准备的意义

- 提升模型鲁棒性:

- 语音增强减少噪声干扰,使后续特征提取(如情感识别)更准确。

- 支持多任务学习:

- 转录文本与语音对齐,可用于训练语音-文本多模态模型(如语音合成与理解)。

- 增强可解释性:

- 标准化元数据帮助研究者快速定位数据子集(如“筛选所有情感标签为‘悲伤’的语音”)。

5. 实际案例:从原始数据到标准数据

5.1 原始数据示例

- 音频文件:user_upload_001.mp3(手机录制,背景有风声)

- 元数据:

- 标题:“登山经历分享”

- 描述:“在山顶遇到暴风雪,差点迷路”

- 标签:“户外、冒险”

5.2 处理流程

- 语音增强:

- 降噪后保存为user_upload_001_enhanced.wav。

- 语音转录:

- Whisper输出:“当时风速突然加大,能见度降到不足五米,我们不得不停止前进。”

- 元数据整合:

- 语言模型生成主题=“户外探险-暴风雪遇险经历”。

5.3 最终标准化数据

- 音频:user_upload_001_enhanced.wav(高质量,无背景风声)

- 文本:转录内容 + 主题标签

- 元数据:

{ "title": "登山经历分享", "description": "在山顶遇到暴风雪,差点迷路", "tags": ["户外", "冒险"], "enhanced_theme": "户外探险-暴风雪遇险经历" }

语音风格识别的工作流程

1. 整体流程概览

语音风格识别的核心目标是从一段语音中提取多维度的风格特征,包括音高、能量、语速、说话人信息(性别、年龄)、情感描述、关键词强调等。这些特征共同构成语音的“风格DNA”,为后续生成自然语言描述提供数据基础。

流程步骤(如图1所示):

- 信号处理 → 提取基础声学特征(音高、能量、语速)。

- 说话人信息识别 → 判断性别、年龄。

- 情感描述 → 分析情感类型及强度。

- 词语强调检测 → 定位句子中被重读的关键词。

2. 信号处理:音高、能量、语速

2.1 技术原理

- 音高(Pitch):声音的频率高低(如女声音高通常高于男声)。

- 处理方法:通过傅里叶变换或自相关算法分析基频(F0)。

- 能量(Energy):语音的响度(如大喊 vs. 耳语)。

- 计算方法:计算音频信号的平均振幅或短时能量。

- 语速(Speed):单位时间内的发音字数或音节数。

- 检测方法:结合语音识别结果统计词/音节数量,除以音频时长。

2.2 分类规则

- 音高:

- 按性别分类:

- 女性:高音高(如200-300 Hz)

- 男性:低音高(如80-150 Hz)

- 参考标准:遵循Audiobox的性别音高划分惯例。

- 按性别分类:

- 能量与语速:

- 分为低、中、高三档(如语速:慢<3字/秒,中3-5字/秒,快>5字/秒)。

例子:

- 一段男性演讲 → 音高分类为“低”,语速“中”,能量“高”。

3. 说话人信息识别:性别与年龄

3.1 技术实现

- 模型选择:使用Wav2vec 2.0(预训练的大规模语音模型)作为基础。

- 预训练优势:Wav2vec 2.0通过海量语音数据学习通用语音特征(如音色、发音习惯)。

- 微调方法:

- 在Wav2vec 2.0的输出层后添加线性分类层,针对性别(男/女)和年龄(如青年、中年、老年)进行微调。

- 训练数据:使用已标注性别和年龄的语音数据集(如VoxCeleb、Common Voice)。

3.2 实际效果

- 性别识别:准确率>98%(基于公开基准测试)。

- 年龄估计:误差范围±5岁(受录音质量、说话人音色变化影响)。

例子:

- 输入一段青年女性语音 → 输出性别=女,年龄=20-30岁。

4. 情感描述:捕捉情绪细微变化

4.1 中英文差异化处理

- 英语语音:使用Emotion2vec模型(九类情感分类)。

- 情感类别:生气、开心、悲伤、恐惧、惊讶、厌恶、中性、平静、兴奋。

- 技术优势:在语音情感识别(SER)任务中达到SOTA(State-of-the-Art)。

- 中文语音:使用SECap模型(生成短句描述)。

- 输出示例:“声音颤抖,语速忽快忽慢,压抑的哭腔(强度85%)”。

- 与传统标签对比:

- 标签:悲伤 → 描述:“悲伤中夹杂哽咽,情绪波动明显”。

4.2 情感标注规则

- 有声书语音:默认标记为“中性”(因其多为平铺直叙的朗读)。

- 其他语音:根据模型输出动态生成描述,保留情感强度与波动细节。

例子:

- 输入一段争吵录音 → SECap输出:“语气激烈,音调逐渐升高,关键词重复,愤怒强度90%”。

5. 词语强调检测:定位句子重音

5.1 技术原理

- 检测单元:以词为单位(中英文均适用)。

- 特征提取:

- 频谱特征:通过残差卷积网络(ResCNN)分析声音频率特性(如能量峰值)。

- 非频谱特征:通过深度神经网络(DNN)分析时长、停顿、音高变化等。

- 决策逻辑:综合两类特征,预测每个词的强调概率,选择概率最高的词作为句子重音。

5.2 实际应用

- 输入句子:“这个方案必须今天通过!”

- 检测结果:强调词=“必须”(概率0.92)。

- 合成控制:生成语音时在“必须”一词上加重音量和延长时长。

技术挑战:

- 中文无明确重音规则(英文有固定重音模式),需依赖上下文和声学特征推断。

如何用大语言模型(LLM)生成语音描述?

1. 核心任务:从“属性表格”到“自然语言”

想象你有一张表格,记录了一段语音的各类特征:

- 性别:女

- 年龄:30岁

- 语速:快

- 情感:愤怒(强度90%)

- 关键词强调:“必须”

- 背景声:键盘敲击声

现在需要让AI把这些冷冰冰的数据转化为一段生动的描述:

目标输出:“一位30岁女性语速急促,在‘必须’一词上加重语气,背景有密集的键盘声,声音充满强烈怒意。”

这个过程就是LLM的重写任务。

2. 关键技术:如何训练LLM生成优质描述?

2.1 模型选择与微调

- 基础模型:LLaMA 2(开源大语言模型,擅长文本生成)。

- 微调目标:

- 教会模型准确转化属性(不遗漏、不编造)。

- 提升描述多样性(避免千篇一律)。

微调方法:

- 输入:结构化属性表格 + 人工撰写的参考描述。

- 输出:模型学习如何将属性“翻译”成自然语言。

2.2 防错机制:避免“胡说八道”

- 问题:LLM可能生成与输入属性无关的内容(如虚构“背景有雷声”)。

- 解决方案:

- 数据增强:通过以下方法增加训练样本多样性:

- 属性顺序调换:例如先写“背景声”再写“情感”。

- 同义词替换:如将“急促”替换为“飞快”、“紧凑”。

- 多轮翻译:中英文互译扩充语料(如“angry” → “愤怒” → “rage”)。

- 质量过滤:

- 用GPT-4 Turbo自动筛选低质量生成(如删除包含虚构内容的描述)。

- 人工抽检确保准确性。

- 数据增强:通过以下方法增加训练样本多样性:

3. 两种描述版本:适应不同场景

3.1 Description版(纯风格描述)

- 内容:仅包含语音风格属性(不涉及具体说话内容)。

- 示例:

- “女性声音沙哑,语速快且不规律,句尾音调上扬,背景有咖啡机噪音。”

- 适用场景:

- 语音合成控制:用户指定风格(如“生成愤怒的中年男性语音”)。

- 语音风格检索:在数据库中查找具有特定风格的语音片段。

3.2 Instruction版(语音指令)

- 内容:语音文字内容 + 风格描述。

- 示例:

- 文字:“我们必须今天完成。”

- 描述:“声音坚定,在‘必须’一词上重读,语速逐渐加快,背景有电话铃声。”

- 适用场景:

- 可控语音合成:确保合成语音的重音位置与文本匹配。

- 多模态训练:同时学习语音内容与风格的关联(如“愤怒语气下,‘完成’一词发音更短促”)。

4. 为什么要设计两种版本?

4.1 统一控制风格与内容

- 传统问题:语音合成模型将内容和风格分开处理,导致控制不协调。

- 例如:生成“愤怒的语音”时,可能整体提高音量,但无法在特定词汇上加重。

- Instruction版优势:

- 将内容与风格绑定,模型能学习动态调整(如仅在“必须”一词上加重,其余部分保持正常)。

4.2 支持细粒度与全局控制

- 细粒度控制:

- 指令示例:“前半句轻柔,在‘梦想’一词拉长音调,后半句加速,充满激情。”

- 全局控制:

- 指令示例:“整体语气冷静,关键词发音清晰,背景安静。”

4.3 扩展至多模态任务

- 未来潜力:

- 指令可包含场景声效描述(如“雨声、脚步声”),训练模型生成复合场景的语音。

- 支持跨模态生成:输入文字+风格指令,输出语音+对应场景视频(如虚拟主播)。

5. 实际案例:如何用LLM提升语音合成?

5.1 传统方法 vs. 本文方法

- 传统标签控制:

- 输入标签:情感=生气,语速=快 → 输出语音:全程大吼,机械感强。

- 本文自然语言控制:

- 输入描述:“前半句压低声音,后半句语速加快,伴随急促呼吸声” → 输出语音:自然且有层次感。

5.2 教育领域应用

- 语言教学:

- 学生朗读句子 → 系统生成反馈:“‘重要’一词应加重,句末音调需上扬,模仿疑问语气。”

- AI教师根据描述自动调整示范语音。

6. 总结:LLM如何改变语音技术?

- 从“填空题”到“小作文”:

- 传统方法像填模板(“性别=女,情感=生气”),而LLM生成自由文本,捕捉真实细节。

- 降低人工成本:

- 自动生成200万条描述的成本远低于人工标注(节省数百万美元)。

- 推动技术边界:

- 让语音合成从“能听会说”升级为“能理解会表达”,实现更人性化的人机交互。

未来想象:

- AI配音师:导演输入“反派角色,低沉嗓音,每句话结尾带冷笑” → AI生成符合要求的语音。

- 情绪化客服:通过实时分析用户语音风格(如焦虑),调整应答语气(如放缓语速、降低音调)。

通过赋予AI“用文字描述声音”的能力,我们正在打开语音技术的全新可能性。

DataSet

详细讲解:SpeechCraft数据集的构建、验证与分析

细粒度重音数据集:如何让AI学会“强调”某个词?

技术选择:FastSpeech 2

- 为什么选它?

FastSpeech 2是一种高效的语音合成模型,能解耦控制语音特征(如音高、音量、时长),适合精细调整。- 解耦控制:就像调节音响的独立旋钮(低音、高音、音量),可单独调整某个词的音高或延长其发音。

重音生成方法

-

关键词提取:

- 从语音转录文本中提取关键词(如“必须”、“重要”)。

- 示例:句子“我们必须今天完成” → 关键词=“必须”。

-

声学特征调整:

- 音量增强:提高关键词的能量(Energy)。

- 音高变化:升高或降低基频(Pitch)以突出强调。

- 延长时长:拉长关键词的发音时间(Duration)。

- 组合优化:实验发现,同时调整音量+音高+时长的效果最接近人类重音(如“必须”一词音量+20%,音高+10%,时长+15%)。

-

生成重音语音:

- 输入原句和调整参数 → FastSpeech 2生成带强调的语音片段。

- 数据规模:

- 中文AISHELL-3生成6.3万条,英文LibriTTS-R生成7.5万条。

应用场景:

- 语音教学:学生可对比原句与重音版本,学习强调技巧。

- 语音助手:用户输入“强调‘立即’一词” → 助手生成更紧迫的提醒语音。

4.3 验证标注系统:如何确保质量?

步骤1:属性预测器的准确性验证

-

说话人信息(性别、年龄):

- 模型:基于Wav2vec 2.0的微调模型。

- 结果:

- 性别分类准确率97.72%(接近完美)。

- 年龄分类准确率87.7%(误差约±5岁)。

-

情感识别:

- 英文:Emotion2vec模型在内部数据集准确率84%(优于同类模型)。

- 中文:SECap生成描述后,用ChatGPT总结情感类别,准确率70.45%(12类情感)。

步骤2:LLM生成描述的评估

- 对比基线:GPT-3.5 Turbo、TextrolSpeech模板生成。

- 评估指标:

- 保真度:描述是否完整保留原始属性(如不漏掉“背景键盘声”)。

- 多样性:用词是否丰富,避免重复模板。

- 结果:

- 微调后的LLaMA 2错误率最低(见表3),且句子更长,包含更多细节(见图3)。

- 示例:

- TextrolSpeech:“女性,生气,快语速。”

- LLaMA 2生成:“年轻女性声音急促,句尾音调尖锐,背景有摔门声,愤怒强度达90%。”

步骤3:重音生成效果验证

- 测试集准确率:

- 中文AISHELL-3重音数据:88.55%。

- 英文LibriTTS-R重音数据:85.60%。

- 人工评估:邀请听众判断重音位置是否自然,结果显示与真实人类重音模式高度吻合。

4.4 数据分析:SpeechCraft里有什么?

数据概览

- 规模:超200万条语音片段,中英文各约100万条。

- 标注类型:

- Description版:纯风格描述(如“声音沙哑,语速快”)。

- Instruction版:语音内容+风格描述(如文字“快走!”+描述“语气急促,命令式口吻”)。

分布特征

-

性别与年龄(见图4):

- 性别:基本平衡(男51%,女49%),但年轻女性样本略多。

- 年龄:集中在青少年、青年、中年(占比85%),反映现实活跃人群。

-

情感分布:

- 高频情感:开心(30%)、悲伤(25%)、生气(20%)。

- 低频情感:惊讶(5,626条)、厌恶(4,038条)、恐惧(3,223条)。

- 现实映射:低频情感占比低,符合真实场景中较少极端情绪的特点(如日常生活中恐惧场景较少)。

数据不平衡的影响

- 挑战:模型可能对低频情感(如恐惧)识别能力较弱。

- 解决方案:

- 数据增强:通过重采样或合成增加低频情感样本。

- 迁移学习:用高频情感数据预训练,微调低频任务。

总结:SpeechCraft的意义与未来

- 技术价值:通过自动化标注与重音生成,填补了语音风格数据的空白。

- 应用潜力:

- 教育:帮助学生模仿不同语音风格(如演讲中的情感递进)。

- 医疗:通过分析语音情感波动辅助心理健康诊断。

- 娱乐:AI生成带特定风格的配音(如“反派角色:低沉嗓音+关键词重读”)。

- 未来方向:

- 扩展方言、小语种支持。

- 结合多模态数据(如视频中的面部表情)提升描述丰富性。

SpeechCraft不仅是一个数据集,更是推动语音技术从“功能实现”迈向“情感表达”的关键基石。