多模态 RAG 应用:解锁智能问答的新维度

在当今这个信息爆炸的时代,我们每天都需要处理海量的数据,这些数据以多种形式存在,包括文本、图像、音频和视频等。随着人工智能技术的飞速发展,尤其是大型语言模型(LLM)的广泛应用,我们越来越依赖于这些智能系统来理解和回应我们的查询。然而,传统的LLM在处理单一模态数据(如纯文本)时表现尚可,但在面对多模态数据时,其能力就显得捉襟见肘了。为了解决这个问题,多模态RAG(Retrieval Augmented Generation)应用应运而生,它为我们提供了一种全新的方式来处理和回应包含多种数据类型的查询。

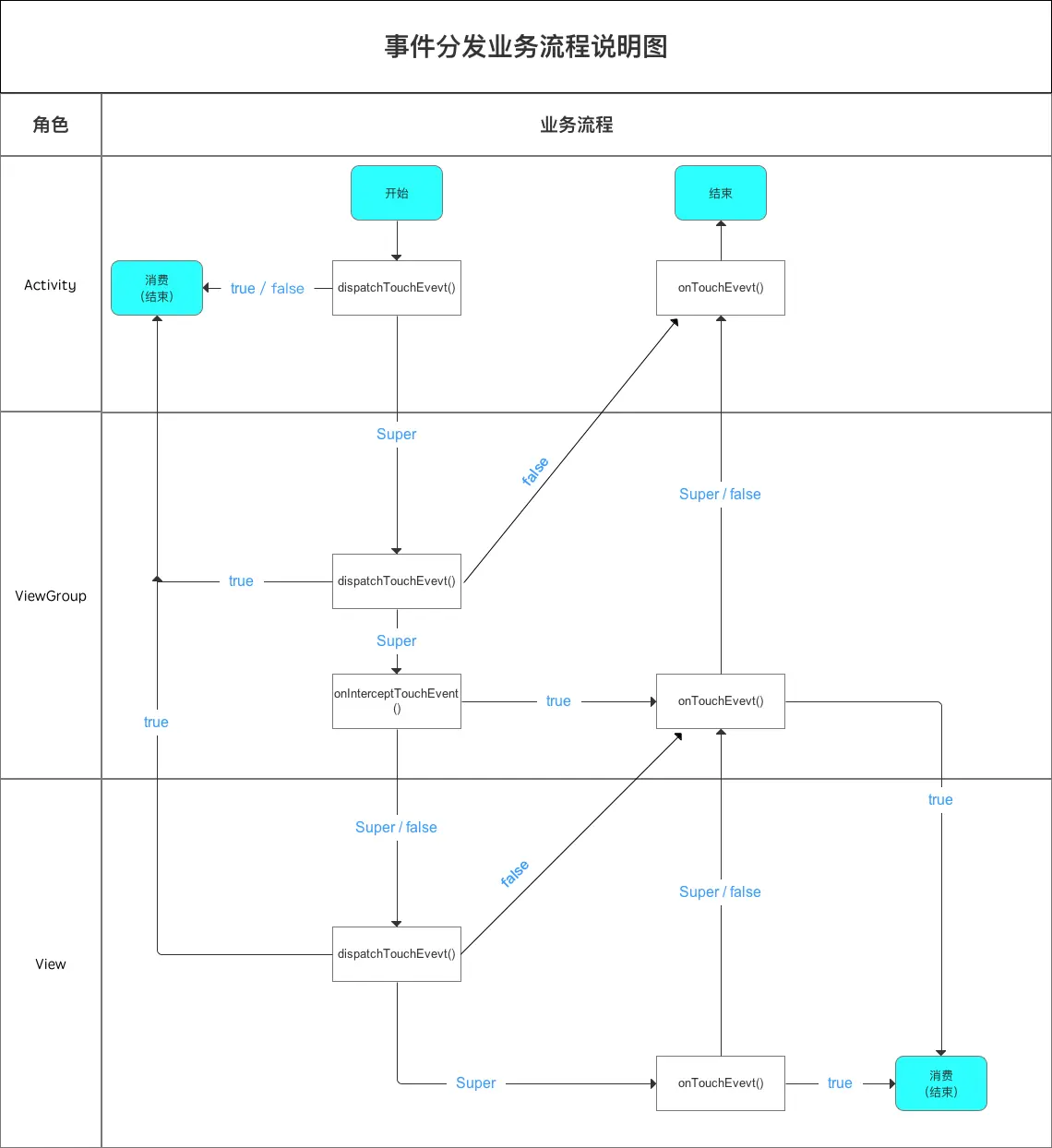

RAG,即检索增强生成模型,通过在用户查询的同时提供相关上下文,显著提高了LLM的响应质量。这一方法的核心在于,它能够从庞大的数据集中快速检索出与查询最相关的上下文信息,并将这些信息作为输入传递给LLM,从而生成更加准确和有价值的回答。然而,现实世界中的信息往往不仅仅局限于文本形式。很多时候,最相关的上下文信息可能以图像、表格或视频等其他模态存在。这就需要我们探索和发展多模态RAG应用,以应对这种复杂的信息环境。

作为大禹智库的向量数据库高级研究员,同时也是《向量数据库指南》的作者,我深知多模态RAG应用的重要性和挑战性。在我的研究和实践中,我发现多模态RAG不仅要求我们能够有效地处理和转换不同模态的数据,还需要我们能够选择合适的LLM和Embedding模型来支持这种多模态的信息处理。