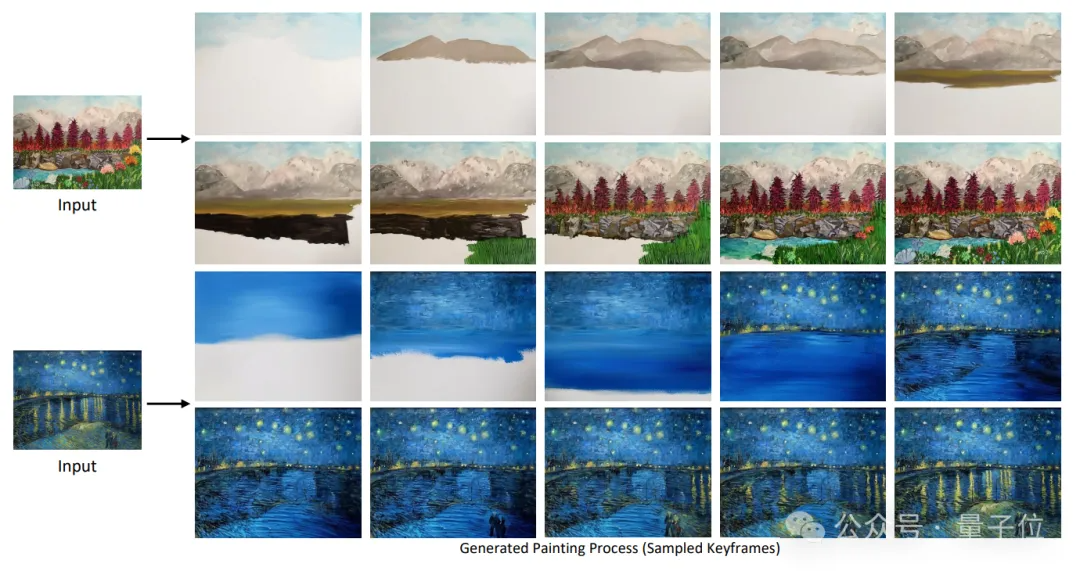

1 AI逆向绘画火了!一键重绘梵高《星空》,来自华盛顿大学

量子位|阅读原文

这项魔法来自华盛顿大学,项目名为Inverse Painting,相关论文已入选SIGGRAPH Asia 2024,其中两位作者还是东北大学(Bowei Chen )和上海科技大学(Yifan Wang)的校友。从原图→绘画过程延时视频,Inverse Painting采用基于扩散的逆绘画方法。通过指令生成和画布渲染来完成创作。

2 解密诺贝尔物理学奖为啥颁给AI?Hinton和Ilya 12年前对话,竟引发物理诺奖AI风暴!

新智元|阅读原文

诺贝尔物理学奖公布第二天,争议依然未平息。诺奖官号都被愤怒的网友冲了:AI不是物理学!

MIT博士生Ziming Liu直言:「Physics (Science) for AI」是一个被严重低估的领域。规模化可以实现一对多的效果,但唯有科学才能带来从无到有的突破。

1995年反向传播算法引发的热潮被统计机器学习盖去了。2012年9月,一篇题为「用深度卷积神经网络进行ImageNet图像分类」的论文,让此前沉寂多年的AI领域热度骤起。AlexNet摧枯拉朽般的大胜,让研究人员惊叹于大型卷积深度神经网络架构的神奇威力,这篇论文也成为深度学习和人工智能自「AI寒冬」后重新成为热门领域的重要里程碑。

自此,人们开始相信:大数据、算力、深度模型,是走向通用人工智能的关键三要素。而深度模型也从最早的卷积神经网络,迭代为递归神经网络、Transformer、扩散模型,直至今天的GPT。

3 英伟达最新 AI 峰会 —— 加速计算与 AI 的变革力量

有新Newin|阅读原文

Pette 认为我们正处于新工业革命的黎明,并对现场的政策制定者、媒体、开发者和企业家们表示,英伟达设计系统时不仅考虑性能,也兼顾了能源效率。据悉,英伟达 Blackwell 平台在 AI 计算领域实现了突破性的能源效率提升,在过去十年中将训练 GPT-4 等模型的能耗降低了多达 2000 倍。此外,英伟达加速计算还将 AI 模型生成输出(即 token )的能源消耗减少了 10 万倍,这突显了在全球范围内快速采用 AI 的背景下,加速计算对可持续性的价值。他还表示,这些 AI 工厂生产的是产品,这些产品是 token,而 token 代表的是智能,智能即金钱,这将颠覆地球上的每一个行业。

4 清华微软最新力作:用物理学革新Transformer注意力,「大海捞针」精度暴涨30%!

新智元|阅读原文

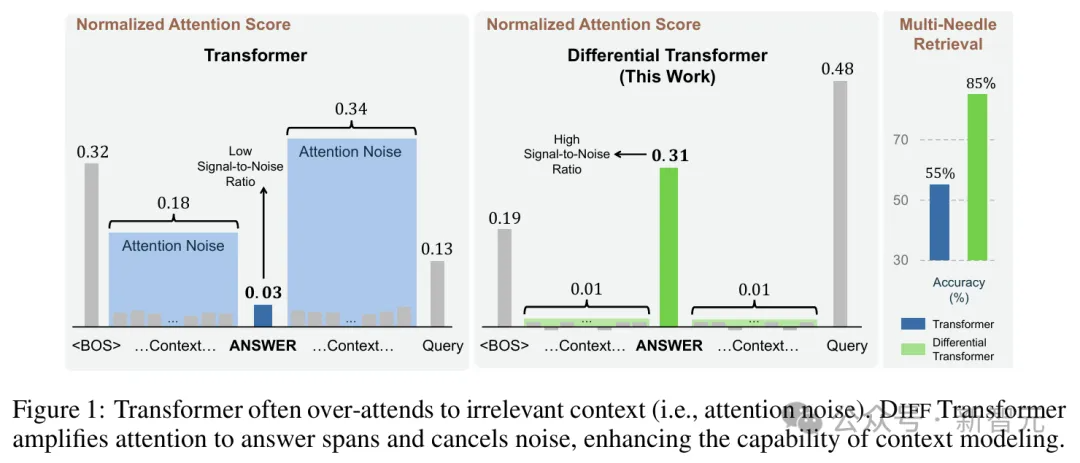

随着诺贝尔物理学奖颁给了「机器学习之父」Geoffrey Hinton,另一个借鉴物理学概念的模型架构也横空出世——微软清华团队的最新架构Differential Transformer,从注意力模块入手,实现了Transformer的核心能力提升。微软研究院和清华大学的研究人员共同提出了一种新的模型架构——Differential Transformer,不仅保留了原始Transformer中的可扩展性,也能让模型更加关注上下文中与任务相关的关键信息。

对此,你怎么看?

详情查看参与互动赢蚂蚁周边

支付宝开放平台-开发者社区

「AGI 之路」 内容库

欢迎你的投稿!戳我进群

支付宝/钉钉扫码加入支付宝开发者钉组织,可了解支付宝开放能力最新动态,订阅文档更新消息,和同城同行业交流业务,与支付宝产研沟通交流。