论文 DAF-Net: A Dual-Branch Feature Decomposition Fusion Network with Domain Adaptive for Infrared and Visible Image Fusion 提出了一种新的红外和可见光图像融合方法。该方法旨在结合红外图像和可见光图像的互补信息,以提供更全面的场景理解。红外图像在低光和复杂环境中擅长捕捉热辐射,而可见光图像则保留了丰富的细节和颜色。然而,红外与可见光图像在成像原理、分辨率和光谱响应上的显著差异,给融合过程中保留关键信息带来了挑战。为了解决这些问题,本文提出了一种双分支特征分解融合网络(DAF-Net),并引入了域自适应技术,以实现不同模态间的特征对齐。

I. 引言

红外和可见光图像融合旨在结合红外和可见光两种模态的互补信息,以实现更全面的环境感知。红外图像在夜间监控和目标检测等低光环境下表现优异,而可见光图像保留了丰富的细节和色彩。这两种模态的融合能够弥补各自的局限性,从而提供更完整的环境理解。然而,由于成像原理、分辨率和光谱响应的差异,保持关键信息的一致性成为一个主要挑战。

现有的图像融合方法大致分为三类:

-

传统方法:如像素级或特征级融合方法,这些方法通过简单的规则进行融合,计算效率高,易于实现,但无法充分利用红外和可见光图像的互补信息,导致融合效果有限。

-

变换域方法:如小波变换和拉普拉斯金字塔技术,这些方法通过将图像分解为不同的频率成分来保留细节,但在重建过程中可能丢失关键的模态特定特征,难以同时保留全局结构和细节纹理。

-

基于深度学习的方法:近年来,深度学习方法取得了显著进展,如卷积神经网络(CNN)和生成对抗网络(GAN)。这些方法能够通过学习模态间的非线性关系,生成视觉质量更高的融合图像。然而,深度学习方法通常需要大量标注数据,这在数据稀缺时成为限制因素。此外,在保持全局结构和细节纹理方面仍然存在挑战。

II. 方法

为了更好地对齐红外和可见光图像的潜在特征空间,本文提出了一种域自适应的双分支特征分解融合网络(DAF-Net)。该方法通过引入多核最大均值差异(MK-MMD)来减少红外和可见光图像之间的分布差异,从而提高融合图像的质量。DAF-Net的基础编码器基于Restormer网络,负责捕捉全局结构信息;细节编码器基于可逆神经网络(INN),负责提取细节纹理信息。MK-MMD仅在基础编码器中应用,以确保全局特征的一致性,避免局部细节的过度对齐和模态特定信息的丢失。该结构使得DAF-Net能够在全局结构和细节保留之间取得平衡。

所提出的DAF-Net框架

A. 网络架构

DAF-Net由一个编码器-解码器分支和一个基于混合核函数的域自适应层组成。为了在每个训练阶段优化网络参数,本文引入了一个包含域自适应损失的新损失函数。

-

编码器-解码器分支:编码器由三个部分组成:基于Transformer的共享特征层、使用Restormer块的基础编码器和使用INN块的细节编码器。基础编码器捕捉全局结构信息,细节编码器提取细节纹理信息。

编码分支的训练过程,其中在红外图像和可见光图像的基础编码器之间存在一个域自适应层

-

域自适应层:域自适应层通过计算MK-MMD来减少红外和可见光图像特征的分布差异,实现跨模态特征转移。该层在基础编码器的最后三层卷积层中应用,以对齐全局特征,而细节编码器不使用MK-MMD,以保留局部细节。

B. 两阶段训练

为了应对红外和可见光图像融合中缺乏真实标签的问题,本文采用了两阶段学习方案来训练DAF-Net。

-

阶段一:编码器-解码器分支训练:在这一阶段,输入成对的红外和可见光图像,编码器提取全局结构和细节特征,重构原始红外和可见光图像。

-

阶段二:融合层训练:在这一阶段,输入已训练好的编码器的特征,融合层进行结构和细节特征的融合,最终生成融合图像。

融合层训练的过程

C. 损失函数

DAF-Net的总损失函数是编码器-解码器损失和融合层损失的加权和。编码器-解码器阶段的重构损失包括均方误差(MSE)损失、结构相似性指数(SSIM)损失和梯度损失。为了捕捉跨模态关系,还引入了相关性损失和InfoNCE损失。融合层的损失函数由强度损失、最大梯度损失和相关性损失组成。

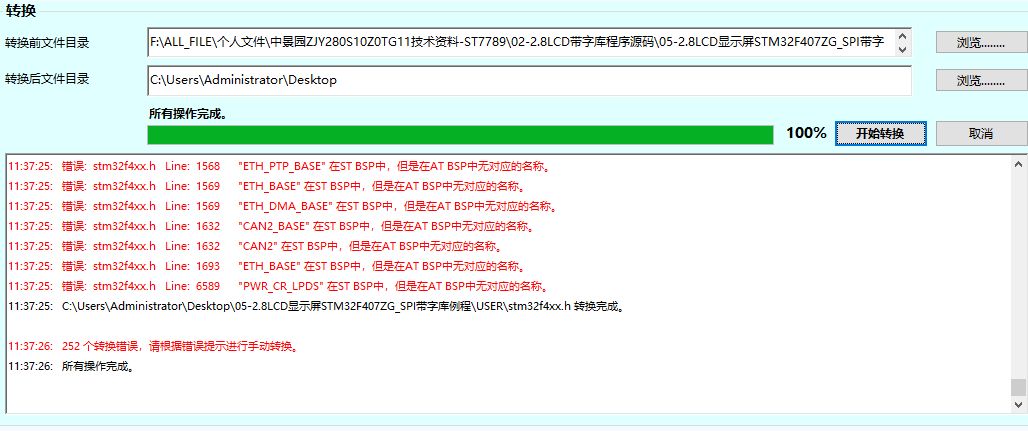

III. 实验与结果

A. 实验设置

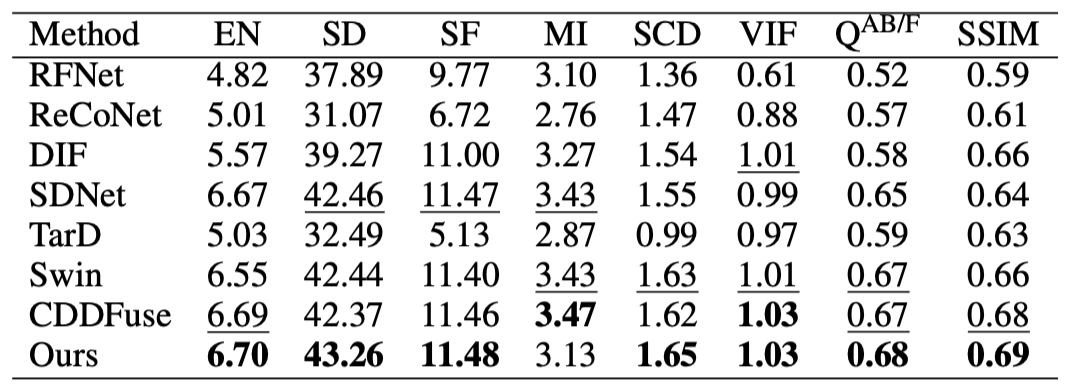

实验在三个数据集上进行:MSRS、RoadScene和TNO。部分MSRS数据集用于训练,其余部分和TNO、RoadScene数据集用于评估。采用的评价指标包括互信息(MI)、视觉信息保真度(VIF)、熵(EN)、标准差(SD)、空间频率(SF)、边缘信息QAB/F和结构相似性指数(SSIM)。

B. 实现细节

实验在配备两块NVIDIA A100 GPU的系统上进行。训练样本被随机裁剪为128×128的图像块,模型在40个epoch上以无监督方式训练,批量大小为4。优化器采用Adam,初始学习率为10⁻⁴,每10个epoch减半。

C. 定性结果

与现有方法相比,DAF-Net在融合过程中有效保留了红外图像的热辐射信息和可见光图像的细节。实验结果表明,DAF-Net在暗区域增强了物体的可见性,有效区分了前景目标和背景。

红外-可见光图像融合任务结果对比

D. 定量结果

通过在TNO和MSRS数据集上的实验,定量结果表明DAF-Net在大多数指标上均优于其他方法,在视觉质量和融合性能上表现出色。

数据集:TNO 红外-可见光图像融合

数据集:MSRS 红外-可见光图像融合

IV. 结论

本文提出的DAF-Net通过在基础编码器中引入MK-MMD实现全局特征对齐,同时保留了模态特定的细节特征。实验表明,DAF-Net在多个数据集上均取得了优异的融合性能和视觉质量。

相关信息

-

代码: https://github.com/xujian000/daf-net

-

论文: https://arxiv.org/abs/2409.11642v1