一、text-generation-webui 简介

text-generation-webui 是一个流行的用于文本生成的 Gradio Web UI。支持 transformers、GPTQ、AWQ、EXL2、llama.cpp (GGUF)、Llama 模型。

它的特点如下,

- 3 种界面模式:default (two columns), notebook, chat

- 支持多个模型后端:Transformers、llama.cpp(通过 llama-cpp-python)、ExLlama、ExLlamaV2、AutoGPTQ、AutoAWQ、GPTQ-for-LLaMa、CTransformers、QuIP#。

- 下拉菜单可在不同模型之间快速切换。

- 大量扩展(内置和用户贡献),包括用于真实语音输出的 Coqui TTS、用于语音输入的 Whisper STT、翻译、多模式管道、向量数据库、Stable Diffusion 集成等等。

- 与自定义角色聊天。

- 适用于指令跟踪模型的精确聊天模板,包括 Llama-2-chat、Alpaca、Vicuna、Mistral。

- LoRA:使用您自己的数据训练新的 LoRA,动态加载/卸载 LoRA 以进行生成。

- Transformers 库集成:通过 bitsandbytes 以 4 位或 8 位精度加载模型,将 llama.cpp 与 Transformers 采样器( llamacpp_HF 加载器)结合使用,使用 PyTorch 以 32 位精度进行 CPU 推理。

- 具有 OpenAI 兼容的 Chat 和 Completions API 服务器 。

二、模型搭建流程

1. 容器镜像一键使用

镜像环境: RXT3090 nvidia/cuda/12.4.1-cudnn-runtime-ubuntu20.04

(1)进入算家云“租用实例”页面,点击“应用社区”,选择text-generation-webui

(2)选择 3090 卡或 其他性能优于 3090 的显卡,点击“立即创建”即可创建实例

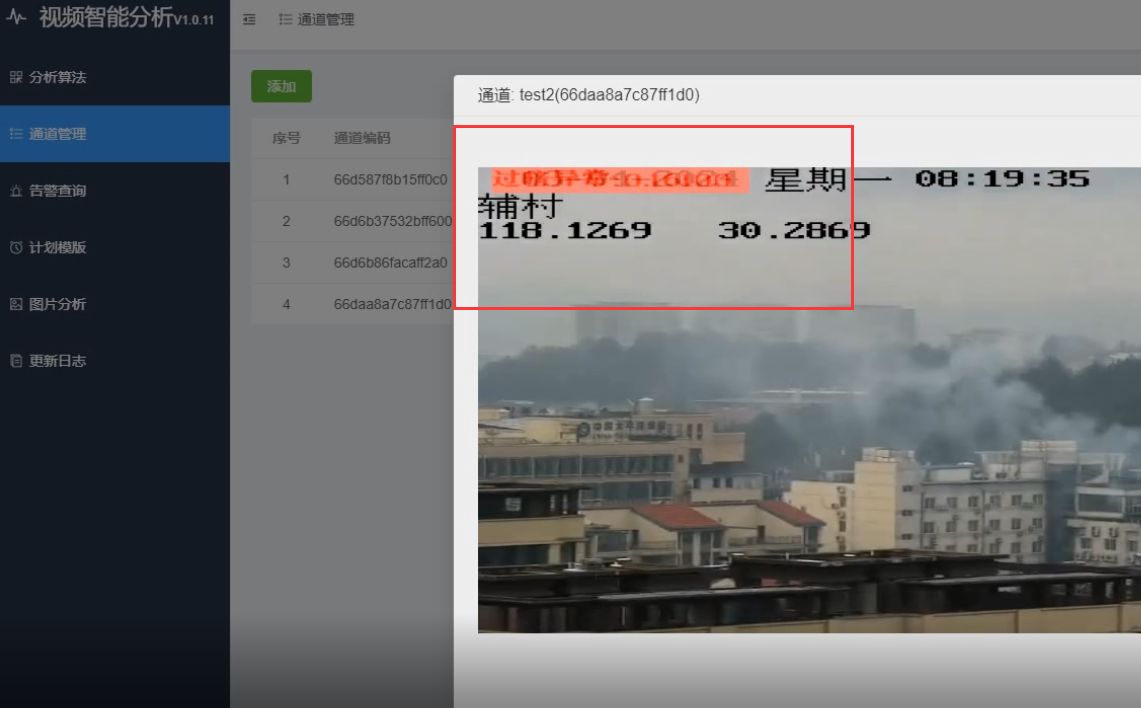

2.进入创建的实例

在“项目实例”页面点击对应实例的“Web SSH”进入终端操作

以下命令均在该页面进行:

conda activate text

cd /text-generation-webui/models

git lfs install

git clone https://www.modelscope.cn/Xorbits/vicuna-7b-v1.3.git

启动运行模型

cd /

cd text-generation-webui

python server.py --model vicuna-7b-v1.3 --listen --listen-port 8080

3.开启外部访问获取访问链接

返回“项目实例”列表,选择并点击对应实例的“开放端口”操作。

有两种访问方式可以选择:本地私密访问和对外开放端口

(1)本地私密访问:选择 ssh 工具访问,登录之后填写各选项,点击“开启代理”

(2)对外开放端口:请按照下图操作

三、网页演示

运行成功后获取访问链接,即可进入 webUI 界面使用

以上就是在算家云搭建text-generation-webui的流程,具体使用方式可进入算家云应用社区查看该模型的使用说明。

点击应用社区,进入算家云,选择模型,一键开启 AI 之旅!

![[uni-app]小兔鲜-03多端打包上线](https://img-blog.csdnimg.cn/img_convert/43bf8725b2de568f36237677bfd42951.png)

![[数据库实验四]存储过程及函数](https://i-blog.csdnimg.cn/direct/d484ee7ecc584896a3af139fbaf0c3d7.png)