以最新的官方文档为准:https://internvl.readthedocs.io/en/latest/get_started/installation.html

一、环境配置

a. 下载InternVL完整的repo(无权重,空间占的不大)

git clone https://github.com/OpenGVLab/InternVL.gitb. 配置相关环境

cd InternVL

pip install -r requirements.txt这一步大概率会下载到不匹配的torch和torchvision,自己按照cuda和显卡、py版本来。

我这边A100用的torch2.0.1+cuda118、torchvision0.15.2+cu118

pip install flash-attn==2.3.6 --no-build-isolation

c. 下载InternVL-2B的repo(4G+ 包含权重和代码和example)

mkdir pretrained

cd pretrained/

# pip install -U huggingface_hub

# Download OpenGVLab/InternVL2-2B

huggingface-cli download --resume-download --local-dir-use-symlinks False OpenGVLab/InternVL2-2B --local-dir InternVL2-2B

如果hf-cli不会用or安装失败 可以自行去hugging face搜索InternVL-2B安装或者上hf-mirror.com镜像站安装,这里不做阐述。有问题可以评论。

然后再InternVL大目录下应该是这样的:(我这里只下载了2B)

d. 安装InternVL-2B的相关环境

正常只需要安装这个transformers库

pip install transformers==4.37.2

二、准备demo

利用这个脚本测试,注意修改path = 'OpenGVLab/InternVL2-8B'为InternVL-2B的路径。

这个脚本最好放在InternVL-2B目录下,这样输入的图像都在相对路径./examples中,否则也需要相应修改。

import numpy as np

import torch

import torchvision.transforms as T

from decord import VideoReader, cpu

from PIL import Image

from torchvision.transforms.functional import InterpolationMode

from transformers import AutoModel, AutoTokenizer

IMAGENET_MEAN = (0.485, 0.456, 0.406)

IMAGENET_STD = (0.229, 0.224, 0.225)

def build_transform(input_size):

MEAN, STD = IMAGENET_MEAN, IMAGENET_STD

transform = T.Compose([

T.Lambda(lambda img: img.convert('RGB') if img.mode != 'RGB' else img),

T.Resize((input_size, input_size), interpolation=InterpolationMode.BICUBIC),

T.ToTensor(),

T.Normalize(mean=MEAN, std=STD)

])

return transform

def find_closest_aspect_ratio(aspect_ratio, target_ratios, width, height, image_size):

best_ratio_diff = float('inf')

best_ratio = (1, 1)

area = width * height

for ratio in target_ratios:

target_aspect_ratio = ratio[0] / ratio[1]

ratio_diff = abs(aspect_ratio - target_aspect_ratio)

if ratio_diff < best_ratio_diff:

best_ratio_diff = ratio_diff

best_ratio = ratio

elif ratio_diff == best_ratio_diff:

if area > 0.5 * image_size * image_size * ratio[0] * ratio[1]:

best_ratio = ratio

return best_ratio

def dynamic_preprocess(image, min_num=1, max_num=12, image_size=448, use_thumbnail=False):

orig_width, orig_height = image.size

aspect_ratio = orig_width / orig_height

# calculate the existing image aspect ratio

target_ratios = set(

(i, j) for n in range(min_num, max_num + 1) for i in range(1, n + 1) for j in range(1, n + 1) if

i * j <= max_num and i * j >= min_num)

target_ratios = sorted(target_ratios, key=lambda x: x[0] * x[1])

# find the closest aspect ratio to the target

target_aspect_ratio = find_closest_aspect_ratio(

aspect_ratio, target_ratios, orig_width, orig_height, image_size)

# calculate the target width and height

target_width = image_size * target_aspect_ratio[0]

target_height = image_size * target_aspect_ratio[1]

blocks = target_aspect_ratio[0] * target_aspect_ratio[1]

# resize the image

resized_img = image.resize((target_width, target_height))

processed_images = []

for i in range(blocks):

box = (

(i % (target_width // image_size)) * image_size,

(i // (target_width // image_size)) * image_size,

((i % (target_width // image_size)) + 1) * image_size,

((i // (target_width // image_size)) + 1) * image_size

)

# split the image

split_img = resized_img.crop(box)

processed_images.append(split_img)

assert len(processed_images) == blocks

if use_thumbnail and len(processed_images) != 1:

thumbnail_img = image.resize((image_size, image_size))

processed_images.append(thumbnail_img)

return processed_images

def load_image(image_file, input_size=448, max_num=12):

image = Image.open(image_file).convert('RGB')

transform = build_transform(input_size=input_size)

images = dynamic_preprocess(image, image_size=input_size, use_thumbnail=True, max_num=max_num)

pixel_values = [transform(image) for image in images]

pixel_values = torch.stack(pixel_values)

return pixel_values

# If you have an 80G A100 GPU, you can put the entire model on a single GPU.

# Otherwise, you need to load a model using multiple GPUs, please refer to the `Multiple GPUs` section.

path = 'OpenGVLab/InternVL2-8B'

model = AutoModel.from_pretrained(

path,

torch_dtype=torch.bfloat16,

low_cpu_mem_usage=True,

use_flash_attn=True,

trust_remote_code=True).eval().cuda()

tokenizer = AutoTokenizer.from_pretrained(path, trust_remote_code=True, use_fast=False)

# set the max number of tiles in `max_num`

pixel_values = load_image('./examples/image1.jpg', max_num=12).to(torch.bfloat16).cuda()

generation_config = dict(max_new_tokens=1024, do_sample=False)

# pure-text conversation (纯文本对话)

question = 'Hello, who are you?'

response, history = model.chat(tokenizer, None, question, generation_config, history=None, return_history=True)

print(f'User: {question}\nAssistant: {response}')

question = 'Can you tell me a story?'

response, history = model.chat(tokenizer, None, question, generation_config, history=history, return_history=True)

print(f'User: {question}\nAssistant: {response}')

# single-image single-round conversation (单图单轮对话)

question = '<image>\nPlease describe the image shortly.'

response = model.chat(tokenizer, pixel_values, question, generation_config)

print(f'User: {question}\nAssistant: {response}')

# single-image multi-round conversation (单图多轮对话)

question = '<image>\nPlease describe the image in detail.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config, history=None, return_history=True)

print(f'User: {question}\nAssistant: {response}')

question = 'Please write a poem according to the image.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config, history=history, return_history=True)

print(f'User: {question}\nAssistant: {response}')

# multi-image multi-round conversation, combined images (多图多轮对话,拼接图像)

pixel_values1 = load_image('./examples/image1.jpg', max_num=12).to(torch.bfloat16).cuda()

pixel_values2 = load_image('./examples/image2.jpg', max_num=12).to(torch.bfloat16).cuda()

pixel_values = torch.cat((pixel_values1, pixel_values2), dim=0)

question = '<image>\nDescribe the two images in detail.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

history=None, return_history=True)

print(f'User: {question}\nAssistant: {response}')

question = 'What are the similarities and differences between these two images.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

history=history, return_history=True)

print(f'User: {question}\nAssistant: {response}')

# multi-image multi-round conversation, separate images (多图多轮对话,独立图像)

pixel_values1 = load_image('./examples/image1.jpg', max_num=12).to(torch.bfloat16).cuda()

pixel_values2 = load_image('./examples/image2.jpg', max_num=12).to(torch.bfloat16).cuda()

pixel_values = torch.cat((pixel_values1, pixel_values2), dim=0)

num_patches_list = [pixel_values1.size(0), pixel_values2.size(0)]

question = 'Image-1: <image>\nImage-2: <image>\nDescribe the two images in detail.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

num_patches_list=num_patches_list,

history=None, return_history=True)

print(f'User: {question}\nAssistant: {response}')

question = 'What are the similarities and differences between these two images.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

num_patches_list=num_patches_list,

history=history, return_history=True)

print(f'User: {question}\nAssistant: {response}')

# batch inference, single image per sample (单图批处理)

pixel_values1 = load_image('./examples/image1.jpg', max_num=12).to(torch.bfloat16).cuda()

pixel_values2 = load_image('./examples/image2.jpg', max_num=12).to(torch.bfloat16).cuda()

num_patches_list = [pixel_values1.size(0), pixel_values2.size(0)]

pixel_values = torch.cat((pixel_values1, pixel_values2), dim=0)

questions = ['<image>\nDescribe the image in detail.'] * len(num_patches_list)

responses = model.batch_chat(tokenizer, pixel_values,

num_patches_list=num_patches_list,

questions=questions,

generation_config=generation_config)

for question, response in zip(questions, responses):

print(f'User: {question}\nAssistant: {response}')

# video multi-round conversation (视频多轮对话)

def get_index(bound, fps, max_frame, first_idx=0, num_segments=32):

if bound:

start, end = bound[0], bound[1]

else:

start, end = -100000, 100000

start_idx = max(first_idx, round(start * fps))

end_idx = min(round(end * fps), max_frame)

seg_size = float(end_idx - start_idx) / num_segments

frame_indices = np.array([

int(start_idx + (seg_size / 2) + np.round(seg_size * idx))

for idx in range(num_segments)

])

return frame_indices

def load_video(video_path, bound=None, input_size=448, max_num=1, num_segments=32):

vr = VideoReader(video_path, ctx=cpu(0), num_threads=1)

max_frame = len(vr) - 1

fps = float(vr.get_avg_fps())

pixel_values_list, num_patches_list = [], []

transform = build_transform(input_size=input_size)

frame_indices = get_index(bound, fps, max_frame, first_idx=0, num_segments=num_segments)

for frame_index in frame_indices:

img = Image.fromarray(vr[frame_index].asnumpy()).convert('RGB')

img = dynamic_preprocess(img, image_size=input_size, use_thumbnail=True, max_num=max_num)

pixel_values = [transform(tile) for tile in img]

pixel_values = torch.stack(pixel_values)

num_patches_list.append(pixel_values.shape[0])

pixel_values_list.append(pixel_values)

pixel_values = torch.cat(pixel_values_list)

return pixel_values, num_patches_list

video_path = './examples/red-panda.mp4'

pixel_values, num_patches_list = load_video(video_path, num_segments=8, max_num=1)

pixel_values = pixel_values.to(torch.bfloat16).cuda()

video_prefix = ''.join([f'Frame{i+1}: <image>\n' for i in range(len(num_patches_list))])

question = video_prefix + 'What is the red panda doing?'

# Frame1: <image>\nFrame2: <image>\n...\nFrame8: <image>\n{question}

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

num_patches_list=num_patches_list, history=None, return_history=True)

print(f'User: {question}\nAssistant: {response}')

question = 'Describe this video in detail. Don\'t repeat.'

response, history = model.chat(tokenizer, pixel_values, question, generation_config,

num_patches_list=num_patches_list, history=history, return_history=True)

print(f'User: {question}\nAssistant: {response}')这个demo有纯文本对话、输入单图单轮对话、输入单图多轮对话、输入多图多轮对话、输入视频对话等等。

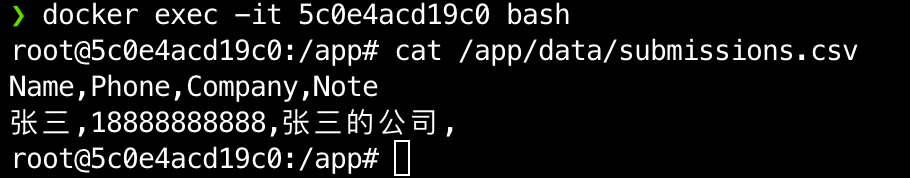

正常运行后的效果:

显存占用20G不到。

三、finetune

提前准备好一些finetune的数据集,可以下载coco_caption数据集用。

## 到internvl_chat目录下

cd /InternVL/internvl_chat

## 官方给出了3个finetune的脚本参考 其中full finetune需要更多的资源和时间

## lora需要的资源和时间少 但是效果一般差一点

# Using 8 GPUs, fine-tune the full LLM, cost about 30G per GPU

GPUS=8 PER_DEVICE_BATCH_SIZE=1 sh shell/internvl2.0/2nd_finetune/internvl2_2b_internlm2_1_8b_dynamic_res_2nd_finetune_full.sh

# Using 2 GPUs, fine-tune the LoRA, cost about 27G per GPU

GPUS=2 PER_DEVICE_BATCH_SIZE=1 sh shell/internvl2.0/2nd_finetune/internvl2_2b_internlm2_1_8b_dynamic_res_2nd_finetune_lora.sh

# Using 8 GPUs, fine-tune the LoRA, cost about 27G per GPU

GPUS=8 PER_DEVICE_BATCH_SIZE=1 sh shell/internvl2.0/2nd_finetune/internvl2_2b_internlm2_1_8b_dynamic_res_2nd_finetune_lora.sh记得修改.sh脚本里的一些路径。

todo

![[UVM]5.config机制 report 消息管理](https://i-blog.csdnimg.cn/direct/18c4a277c93c400986f1b7a82a081cb3.png)