Probabilistic Vision-Language Representation for Weakly Supervised Temporal Action Localization 论文阅读

- Abstract

- 1 Introduction

- 2 RELATEDWORK

- 2.1 Weakly Supervised Temporal Action Localization

- 2.2 Vision Language Pre-training

- 2.3 Probabilistic Representation

- 3 METHOD

- 3.1 Base Approach

- 3.2 Probabilistic Class Activation Sequence

- 3.3 Distribution Contrastive Learning

- 3.4 Total Objectives

- 4 EXPERIMENTS

- 5 Conclusion and future works

文章信息:

发表于:2024MM

原文链接:https://arxiv.org/abs/2408.05955

源码:https://github.com/sejong-rcv/PVLR

Abstract

弱监督时序动作定位(WTAL)旨在仅使用视频级别注释来检测未修剪视频中的动作实例。由于许多现有工作基于动作分类标签来优化WTAL模型,它们面临着任务差异问题(即“通过分类进行定位”)。为了解决这一问题,近期的研究尝试通过视觉-语言预训练(VLP)利用动作类别名称作为辅助语义知识。然而,现有研究仍存在不足之处。以前的方法主要侧重于利用语言模型中的文本信息,但忽略了在联合空间中动态人类动作与VLP知识的对齐。此外,先前研究中使用的确定性表示在捕捉精细粒度的人类动作方面存在困难。为了解决这些问题,我们提出了一种新颖的框架,该框架在概率嵌入空间中实现了人类动作知识与VLP知识的对齐。此外,我们还提出了基于统计相似性的内部和跨分布对比学习,以增强概率嵌入空间。广泛的实验和消融研究表明,我们的方法在所有先前的最先进方法中表现显著优异。

1 Introduction

YouTube和Netflix等多媒体服务的发展,激发了计算机视觉领域对长视频分析日益增长的兴趣。时序动作定位(TAL)是指在一个冗长且未经修剪的视频中,精确确定人类活动发生的时间间隔的问题,这对于视频理解来说具有根本性的重要意义[15, 30, 31]。

全监督的时序动作定位(TAL)[3, 4, 26, 27, 47, 56, 57]通过使用丰富的帧级注释来处理这项任务。尽管它取得了成功,但使用密集的帧级注释来训练TAL模型存在挑战,因为注释成本高且通用性有限。为了应对这些挑战,弱监督时序动作定位(WTAL)[9, 11, 18, 21, 24, 33, 44]受到了广泛关注,它仅需要视频级别的类别标签。在仅有视频级别类别监督的场景下,现有的WTAL方法通过主要选择用于视频级别分类的区分性片段(snippets)来解决定位问题。然而,这些基于分类的方法存在固有的任务差异问题,即“通过分类进行定位”的框架。为了通过“通过定位进行定位”的框架来解决WTAL问题,许多研究[12, 25, 42, 61]已经关注于片段级别的伪标签方法。然而,这些伪标签受到视频级别注释的限制,因此本质上包含噪声提议,并且无法达到所需的准确性。

最近,一些方法[17, 24]通过利用动作类别文本信息来解决这些问题,它们引入了强大的语义知识而无需增加注释成本。这些方法通过利用类别文本嵌入向量来建立额外的学习线索,而不是仅仅将类别信息作为独热向量(one-hot vectors)来使用。虽然通过额外的语义信息取得了显著改进,但早期研究中仍有一些因素被忽视。首先,Li等人[24]采用的语言模型(如GloVe[38])仅在文本模态上进行预训练,导致与人类动作预训练视觉特征的对齐初始化不足。其次,Chen等人[17]提出了一种替代优化策略,以引入有效的蒸馏框架。然而,这种替代优化方案需要根据数据集手动确定最佳设置。第三,也是最重要的是,我们观察到,先前研究中用于结合文本信息的确定性表示对于人类动作理解来说并不是最优的。

为了证实这一点,我们利用CLIP[39](视觉语言预训练领域的一项杰出研究)进行了零样本分类分析。如图1(a)所示,我们比较了文本提示(即“a frame of [CLS]”的表示)与相应帧的视觉表示之间的相似度响应。分析表明,即使在实际的人类动作没有发生时,只要存在与动作文本类别相关的视觉内容,也会出现高水平的激活。这是因为CLIP被预训练为仅考虑单个图像与其标题之间的一对一匹配。如图1(b)所示的早期研究无法解决这个问题,因为它仅通过一对一匹配依赖确定性表示,这使得难以捕捉细粒度的人类运动。此外,由于缺乏与预训练的人类动作知识直接对齐的考虑,导致对时间动态的建模不足。

为了克服这个问题,我们引入了一个新框架PVLR(Probabilistic Vision Language Representation,用于弱监督时序动作定位的概率视觉语言表示),该框架在概率嵌入空间中集成了视觉语言预训练知识和人类动作知识,如图1©所示。首先,利用预训练的人类动作知识(如Kinetics[2])来初始化一个概率嵌入空间。在这一步中,引入了概率适配器来估计片段级概率分布的参数。随后,我们将大规模的视觉语言预训练知识转移到估计的概率分布中,以学习一个联合概率嵌入空间。为了捕捉动作的时间动态,我们从估计的概率分布中抽取样本以提供不同的视角,进行多对一匹配,然后通过蒙特卡洛估计测量它们与类别文本嵌入的相似度。

此外,为了学习一个独特的嵌入空间,我们提出了一种分布对比学习策略来捕捉分布之间的统计相似性。我们通过学习视频内内容(动作或背景)的相似性来增强类内紧凑性,并通过利用跨视频的动作类别信息来最大化类间可分性。为了增强类内紧凑性,我们从前人工作中的片段挖掘[55]中获得灵感,以区分相关内容中相似的片段分布。对于类间可分性,我们基于高斯混合模型(GMM)构建了视频级概率分布,并使不同动作类之间的混合分布可分离。据我们所知,这是首次尝试研究用于弱监督时序动作定位的多模态概率表示。

我们的主要贡献总结如下:

(1)我们引入了一个新框架,该框架在概率空间中对齐视觉语言预训练知识和动作知识,以充分考虑时间动态进行细粒度运动建模。

(2)我们提出了一种基于统计距离的分布内和分布间对比策略,以构建独特的概率嵌入空间。

(3)我们进行了广泛的实验和消融研究,以证明概率嵌入和所提出方法的重要性,在两个公共基准数据集THUMOS14和ActivityNet v1.3上展示了优越的性能。

图1:(a) CLIP 使用图像文本对进行的确定性预训练无法使其具备对细粒度人体运动变化的必要理解。(b) 早期的研究主要集中在基于确定性表示的语言模型和视觉输入之间的直接映射。© 所提出的框架利用概率嵌入并对齐视觉语言预训练(VLP)知识。

2 RELATEDWORK

2.1 Weakly Supervised Temporal Action Localization

弱监督时序动作定位(WTAL)的提出是为了缓解时序动作定位中繁琐的标注过程,它仅通过视频级别的标签进行训练。在研究的早期阶段,提出了基于多示例学习(MIL)的方法[10, 14, 21, 22, 33, 37, 45],这些方法将视频视为多个动作和背景实例的集合。张等人[55]引入了一种片段对比损失,通过片段挖掘和对比学习来优化特征空间中模糊实例的表示。随后,一些方法[12, 25, 42, 61]生成了片段级别的伪标签,作为定位-通过-定位框架来明确指导模型。然而,基于视频级别监督生成的伪标签往往不准确且含有噪声,这使得达到理想的性能变得具有挑战性。

最近,为了解决WTAL中时间标注根本缺失的问题,出现了利用动作类别名称语义信息的方法[17, 24]。李等人[24]设计了一个新颖的框架,该框架具有一个区分性目标,旨在通过文本信息扩大类间差异,并具有一个生成性目标,旨在增强类内一致性。陈等人[17]提出了一种新颖的蒸馏与协作框架,该框架具有互补的基于分类的预训练(CBP)和视觉-语言预训练(VLP)分支。虽然这些工作在没有额外标注成本的情况下表现出了令人瞩目的性能,但仍有进一步发展的潜力。在我们的框架中,我们在现有文献中尚未探索的概率空间中整合了VLP知识和人类动作知识,从而实现了对人类动作的多样化理解。

2.2 Vision Language Pre-training

视觉语言预训练(VLP)通过具有一致上下文信息的大规模图像-文本对数据集学习联合表示。一个代表性工作是CLIP[39],它将包含一致上下文信息的图像-文本对分别映射到视觉和文本编码器中,通过对齐的表示学习联合嵌入空间。CLIP在许多图像理解任务中取得了巨大成功,包括图像分类[6, 34]、语义分割[20, 40]、图像生成[7, 43]和视觉问答[35]。在CLIP在图像领域取得成功的基础上,一些研究工作[29-31, 52]已经出现,旨在在视频领域利用CLIP的视觉语言表示。我们的工作也有助于将VLP知识扩展到未修剪视频和人类动作理解领域的研究。

2.3 Probabilistic Representation

概率表示在嵌入非对称关系、量化不确定性、增加鲁棒性等方面显示出强大的潜力。概率嵌入的主要思想是将输入映射到嵌入空间中的概率分布。为了实现这一点,所需的分布由深度神经网络估计,并通过最大化其似然性进行优化。PCME[5]通过不确定性估计在联合嵌入空间中建模多对一关系,并引入了一种软跨模态对比损失。ProViCo[36]提出了一种自监督视频表示学习,该学习通过高斯混合模型将对比学习与概率嵌入相结合。ProbVLM[48]利用了一个概率适配器,该适配器通过事后方式在模态间和模态内对齐来估计视觉-语言预训练模型嵌入的概率分布,而无需大量数据集或密集计算。本研究的目的是将预训练的视觉-语言模型的知识转移到概率嵌入空间中,以明确增强对人类动作的理解。

3 METHOD

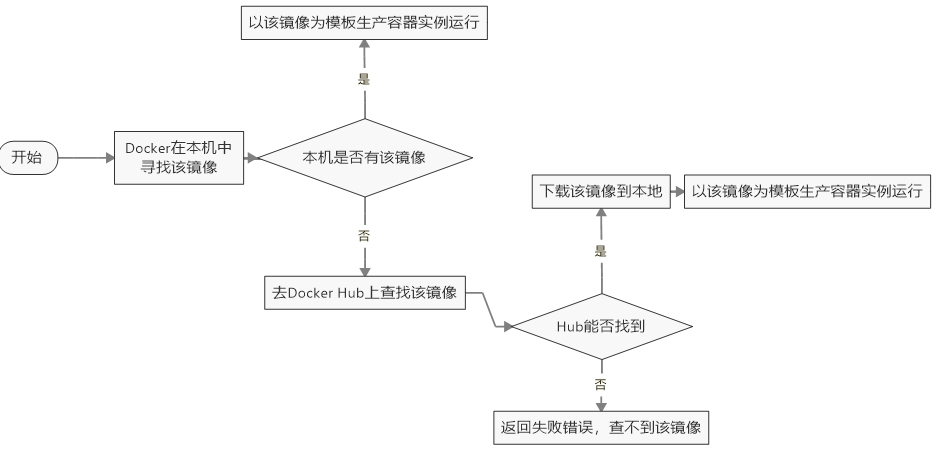

图2:提出的PVLR概览。(a) 概率类别激活序列:对于概率嵌入,我们增加了概率适配器以促进对单个片段的概率分布进行估计。(b) 利用视觉语言预训练(VLP)知识:我们估计概率分布,并用与动作类别相对应的语义文本信息来指导模型。(c ) 分布对比学习:通过从概率分布中训练统计相似性,我们旨在构建具有区分性的嵌入空间。

3.1 Base Approach

3.1.1 Base Head。我们的工作将概率视觉语言表示引入到了一个基本的多实例学习(MIL)方法中。首先,我们在本节中详细介绍MIL方法的基本基础头部。我们将每个视频分割成多帧、非重叠的片段,并采样固定数量 T T T的片段以处理视频长度的变化。采样后,常见的做法是使用预训练的片段特征提取器来提取RGB信息 X R = { x t r } t = 1 T \mathbf{X}^R=\left\{\mathbf{x}_t^r\right\}_{t=1}^T XR={xtr}t=1T和光流信息 X O = { x t o } t = 1 T \mathbf{X}^O=\left\{\mathbf{x}_t^o\right\}_{t=1}^T XO={xto}t=1T的表示。之后,我们将来自每个模态的特征 [ X R ; X O ] ∈ R T × 2 D [\mathbf{X}^R;\mathbf{X}^O]\in\mathbb{R}^{T\times2D} [XR;XO]∈RT×2D拼接起来,并输入到基础头部 f b a s e f_{base} fbase中,生成融合的基础特征 X B ∈ R T × 2 D \mathbf{X}^B\in\mathbb{R}^{T\times2D} XB∈RT×2D,表达式为:

其中, f b a s e f_{base} fbase 主要通过一系列带有ReLU激活函数的时序卷积实现。此外,还生成了一个动作注意力权重 a ∈ R T × 1 \mathbf{a}\in\mathbb{R}^{T\times1} a∈RT×1,用于区分前景和背景区域:

其中, A ( ⋅ ) \mathcal{A}(\cdot) A(⋅) 是一个由几个时序卷积层组成的注意力分支。根据MIL框架,基础特征 X B \mathbf{X}^B XB 被投影到分类头部 f c l s f_{cls} fcls 以生成基础类别激活序列(CAS):

其中 C C C 是动作类别的数量。为了处理未修剪视频中的背景区域,我们添加了一个辅助类别来建模背景。然后,我们聚合片段级别的激活分数以获得视频级别的类别预测 p b a s e = K ( S b a s e ) ∈ R C + 1 \mathbf{p}^{base}=\mathcal{K}(\mathbf{S}^{base})\in\mathbb{R}^{C+1} pbase=K(Sbase)∈RC+1,其中 K ( ⋅ ) \mathcal{K}(\cdot) K(⋅) 表示沿着时间轴进行的前k平均池化。在获得视频级别的类别预测后,我们构建了一个损失函数 L base \mathcal{L}_{\textit{base}} Lbase,使用交叉熵损失如下:

其中,

y

b

a

s

e

=

[

y

1

,

⋯

,

y

C

,

1

]

∈

R

C

+

1

\mathbf{y}^{base}=[y_1,\cdots,y_C,1]\in\mathbb{R}^{C+1}

ybase=[y1,⋯,yC,1]∈RC+1 是带有辅助背景类别的视频级别标签。通过应用注意力权重,可以获得背景抑制的CAS,即

S

s

u

p

p

=

a

⊗

S

b

a

s

e

\mathbf{S}_{supp}=\mathbf{a}\otimes\mathbf{S}^{base}

Ssupp=a⊗Sbase。我们也可以使用背景抑制的视频级别类别分数

p

s

u

p

p

=

K

(

S

s

u

p

p

)

∈

R

C

+

1

\mathbf{p}^{supp}=\mathcal{K}(\mathbf{S}_{supp})\in\mathbb{R}^{C+1}

psupp=K(Ssupp)∈RC+1 构建一个损失函数

L

s

u

p

p

\mathcal{L}_{supp}

Lsupp,如下所示:

其中, y s u p p = [ y 1 , ⋯ , y C , 0 ] ∈ R C + 1 \mathbf{y}^{supp}=[y_1,\cdots,y_C,0]\in\mathbb{R}^{C+1} ysupp=[y1,⋯,yC,0]∈RC+1 是不包含背景类别的视频级别标签。优化 L c l s = L b a s e + L s u p p \mathcal{L}_{cls}=\mathcal{L}_{base}+\mathcal{L}_{supp} Lcls=Lbase+Lsupp 使得模型能够区分出对视频级别动作分类有显著贡献的片段。

我们提出的方法可以应用于任何基于MIL方法的基础头部。我们选择CO2-Net [10]作为基础来推导视频级别的类别预测,因为它简单且代码文档齐全。此外,我们还结合了之前介绍的 L o p p o L_{oppo} Loppo、 L n o r m L_{norm} Lnorm和 L g u i d e L_{guide} Lguide来增强基础头部的优化。由于这些损失是在之前的工作中提出的[14, 21, 22, 32, 37],我们并不声称这些损失是我们的原创。基线方法 L v i d L_{vid} Lvid的总体目标定义为:

3.2 Probabilistic Class Activation Sequence

在本节中,我们将CAS重新表述为概率类激活序列(P-CAS),以便在概率嵌入空间中有效利用视觉语言预训练(VLP)知识[39]。为了实现这一点,我们建模了概率分布 p z ∣ x ( z ∣ θ ) p_{\mathbf{z}|\mathbf{x}}(\mathbf{z}|\theta) pz∣x(z∣θ)并估计参数 θ \theta θ,使用人类动作和VLP知识来优化神经网络。完整框架如图2所示。

3.2.1 概率嵌入。首先,我们通过利用在Kinetics数据集[2]上预训练的人类动作知识来建立一个概率嵌入空间。从基础特征 X B = { x t } t = 1 T ∈ R T × 2 D \mathbf{X}^B=\left\{\mathbf{x}_t\right\}_{t=1}^T\in\mathbb{R}^{T\times2D} XB={xt}t=1T∈RT×2D出发,我们为片段级别的概率分布 p ( z ∣ x t ) p(\mathbf{z}|\mathbf{x}_t) p(z∣xt)建模,将其表示为具有均值向量和对角协方差矩阵的多元高斯分布,以模拟概率嵌入空间:

其中, g μ g_\mu gμ 是一个嵌入层,用于估计均值向量 g μ ( x t ) ∈ R D g_{\mu}(\mathbf{x}_t)\in\mathbb{R}^D gμ(xt)∈RD,而 g Σ g_\Sigma gΣ 是一个嵌入层,用于估计目标高斯分布的协方差矩阵 g Σ ( x t ) ∈ R D g_\Sigma(\mathbf{x}_t)\in\mathbb{R}^D gΣ(xt)∈RD。有了估计的 p ( z ∣ x t ) p(\mathbf{z}|\mathbf{x}_t) p(z∣xt),我们可以根据[19]中的方法采样 K K K 个随机嵌入 z ( k ) ∈ R D \mathbf{z}^{(k)}\in\mathbb{R}^D z(k)∈RD,这些嵌入可以表示估计的分布。

其中, ϵ ( k ) ∈ R D \epsilon^{(k)}\in\mathbb{R}^D ϵ(k)∈RD 是从 D D D 维单位高斯分布中独立同分布采样的。我们的目标是对每个片段从其估计的概率分布中采样 K K K 个嵌入,以便从更多样化的视角捕捉人类动作。此外,对于文本信息,我们将动作类别名称转换为预训练的嵌入。这可以通过冻结CLIP文本转换器 Ψ C ( ⋅ ) \Psi_{C}(\cdot) ΨC(⋅) 并提取嵌入 X C = { x c } c = 1 C + 1 \mathbf{X}^C=\{\mathbf{x}_c\}_{c=1}^{C+1} XC={xc}c=1C+1 来实现:

其中,

L

s

,

L

e

\mathbf{L}_s,\mathbf{L}_e

Ls,Le 是可学习的标记,

t

c

t_c

tc 指的是动作类别,而

Ψ

e

m

b

\Psi_{emb}

Ψemb 是词嵌入层。然后,通过使用估计的概率分布和动作类别表示来确定时间轴上的动作置信度分数来定义P-CAS。具体来说,为了测量估计分布和类别表示之间的置信度分数,我们通过蒙特卡洛估计将P-CAS表述为

S

p

r

o

b

∈

R

T

×

(

C

+

1

)

\mathcal{S}_{prob}\in\mathbb{R}^{T\times(C+1)}

Sprob∈RT×(C+1):

其中,sim(·) 表示余弦相似度,

τ

\tau

τ 是温度参数。此外,为了增强动作类别之间的区分度,我们设计了一个正交损失

L

o

r

t

h

o

\mathcal{L}_{ortho}

Lortho 来确保每个类别表示的唯一性:

其中,I 是单位矩阵,

∥

⋅

∥

F

2

\|\cdot\|_F^2

∥⋅∥F2 是矩阵的Frobenius范数。

3.2.2 VLP知识蒸馏。然而,在估计当前概率分布的过程中,仅利用了VLP中的文本信息,而忽略了人类动作知识与VLP提供的视觉表示之间的对齐。因此,我们旨在将VLP的视觉知识整合到概率分布的估计过程中。

由于CLIP的确定性预训练,估计整个分布可能具有挑战性。然而,大规模预训练表示可以为所需的分布提供一个通用的点估计(例如均值向量)。为了实现这一点,我们的概率嵌入利用CLIP的确定性表示作为目标分布均值 g μ ( x t ) g_\mu(\mathbf{x}_t) gμ(xt)的估计。为了将VLP知识转移到概率嵌入空间中,我们首先从视频中以固定的时间步长采样一组帧 { f t } t = 1 T \{ f_t\} _{t= 1}^T {ft}t=1T,然后冻结CLIP的图像编码器 Ψ I ( ⋅ ) \Psi_{I}(\cdot) ΨI(⋅),并提取嵌入 X I = { Ψ I ( f t ) } t = 1 T ∈ R T × D \mathbf{X}^I=\left\{\Psi_I(f_t)\right\}_{t=1}^T\in\mathbb{R}^{T\times D} XI={ΨI(ft)}t=1T∈RT×D。对于基础片段特征和CLIP图像特征对 ( x t , x t i ) (\mathbf{x}_t,\mathbf{x}_t^i) (xt,xti),蒸馏损失 L k d \mathcal{L}_{kd} Lkd定义为:

我们利用估计的均值 g μ ( x t b ) g_\mu(\mathbf{x}_t^b) gμ(xtb)和CLIP图像表示 x t i \mathbf{x}_t^i xti之间的重新缩放的余弦相似度作为匹配分数。 L k d \mathcal{L}_{kd} Lkd的目标是将估计的均值 g μ ( x t b ) g_\mu(\mathbf{x}_t^b) gμ(xtb)与CLIP嵌入的广义固定点 x t i \mathbf{x}_t^i xti对齐,从而将预训练的CLIP知识转移到所需的概率分布中。

x t i \mathbf{x}_t^i xti中的i代表什么?

3.3 Distribution Contrastive Learning

我们通过将人类动作知识与VLP知识对齐来构建概率嵌入空间。然而,分布相似性的关键因素尚未被探索。与人类动作相对应的分布应该相互之间表现出相似性,同时与背景分布形成对比。为了解决这个问题,我们旨在通过基于统计距离的分布对比学习来增强概率嵌入空间的完整性。

3.3.1 内部分布对比学习。我们首先考虑视频内部分布之间的对比学习。视频内的动作分布应该具有相似性,同时与背景分布保持不同。为了实现这些目标,我们采用了CoLA[55]的片段挖掘算法,该算法使用注意力权重 a ∈ R T × 1 a \in\mathbb{R}^T\times1 a∈RT×1来区分视频内的动作片段和背景片段。我们根据动作性得分将容易区分的样本分类为简单动作(前k个)和简单背景(后k个)。然而,由于边界相邻片段的过渡位置,它们的可靠性较低,使得检测变得困难。为了挖掘困难的动作和背景片段,我们对注意力权重设置阈值(1表示动作,0表示背景):

其中, θ b \theta_b θb 是阈值。

我们采用相同的策略,执行级联膨胀或腐蚀操作,以在动作/背景边界处识别具有挑战性的样本(难以区分)。

其中, ( ⋅ ) − (\cdot)^- (⋅)− 和 ( ⋅ ) + (\cdot)^+ (⋅)+ 分别表示使用较小掩码 m m m 和较大掩码 M \mathcal{M} M 的二值腐蚀和膨胀操作。根据之前的工作[55],我们将内部区域视为困难动作片段集,将外部区域视为困难背景片段集。在这里,我们定义困难动作与简单动作(前k个)具有正相关关系 P a c t \mathcal{P}_{act} Pact,而困难背景与简单背景(后k个)具有正相关关系 P b k g \mathcal{P}_{bkg} Pbkg。在片段挖掘之后,我们利用KL散度作为统计度量来衡量片段分布的相似性。多元高斯分布之间的KL散度定义为:

为了确保嵌入空间内的类内紧凑性,我们提出了一种内部对比损失 L i n t r a \mathcal{L}_{intra} Lintra 来细化片段级别的分布相似性。内部对比损失 L i n t r a \mathcal{L}_{intra} Lintra 的公式为:

其中,

P

\mathcal{P}

P 表示内部分布对比学习中的正样本集,而

(

N

p

,

N

Q

)

(\mathcal{N}_p, \mathcal{N}_Q)

(Np,NQ) 表示两个任意的高斯分布。我们基于KL散度,将匹配概率

p

(

N

)

p(N)

p(N) 定义为Jensen-Shannon散度(JSD)

J

S

D

(

N

P

,

N

Q

)

JSD(\mathcal{N}_P, \mathcal{N}_Q)

JSD(NP,NQ)。

3.3.2 分布间对比学习。我们进一步引入了利用动作类别标签的分布间对比学习,以确保类间可分性。在这里,我们将整个视频分布 p ( z ∣ V ) p(\mathbf{z}|V) p(z∣V) 表示为一个高斯混合模型(GMM),以衡量视频级别的相似性。

为了估计 p ( z ∣ V ) p(\mathbf{z}|V) p(z∣V),我们使用注意力权重 a ∈ R T a \in \mathbb{R}^T a∈RT 作为混合系数,根据动作得分来适当地组合分布。给定视频级别的类别标签,我们定义一个自相似度矩阵 H ∈ R N × N \mathbf{H} \in \mathbb{R}^{N \times N} H∈RN×N(相同类别为1,不同类别为0)来表征视频之间的关系。类似于内部对比学习,我们在小批量中的 N N N 个视频之间,通过混合模型计算匹配概率 p ( N ) p(N) p(N),并通过与自相似度图进行比较来增强视频间的表示。最后,我们定义了一个外部对比损失 L i n t e r \mathcal{L}_{inter} Linter,其公式为:

其中

L

B

C

E

\mathcal{L}_{BCE}

LBCE是二元交叉熵损失。除了与视觉语言预训练(VLP)知识和概率嵌入空间对齐之外,我们提出的对比学习框架还对概率表示施加了约束,以确保类内紧凑性和类间可分性。

3.4 Total Objectives

考虑到前面提到的所有目标,整个框架的总目标L被定义为: L t o t a l \mathcal{L}_{total} Ltotal

其中, α \alpha α、 β \beta β 和 γ \gamma γ 是用于平衡这些损失项的超参数。我们保持与 L v i d \mathcal{L}_{vid} Lvid 相关的参数不变,并仅对 α \alpha α、 β \beta β 和 γ \gamma γ 进行网格搜索。在测试期间,我们使用与先前研究[10,24]相同的策略来为输入视频提取候选提案。最后,我们应用软非极大值抑制来消除重叠的提案。

4 EXPERIMENTS

5 Conclusion and future works

在这项工作中,我们提出了一种新的框架,该框架利用大规模预训练的视觉-语言模型来解决弱监督时序动作定位(WTAL)问题。我们的动机源于视觉-语言预训练(VLP)确定性表示的不足,以及在理解人类动作时缺乏联合对齐的考虑。为了解决这些问题,我们引入了一个与人类动作和VLP知识对齐的概率嵌入框架,并通过分布对比学习进行了增强。我们的方法在两个主要数据集上显著优于以前的方法,证明了在VLP表示中采用概率嵌入的有效性。然而,对于仅由动作类别名称表示的文本数据,概率嵌入的探索尚未进行。在未来的工作中,我们将探索利用最近备受推崇的大型语言模型(LLM)为每个动作类别生成属性,并将其与概率嵌入相结合。