llama 大模型介绍

我们介绍 LLaMA,这是一个基础语言模型的集合,参数范围从 7B 到 65B。我们在数万亿个 Token 上训练我们的模型,并表明可以专门使用公开可用的数据集来训练最先进的模型,而无需诉诸专有的和无法访问的数据集。特别是,LLaMA-13B 在大多数基准测试中都优于 GPT-3 (175B),

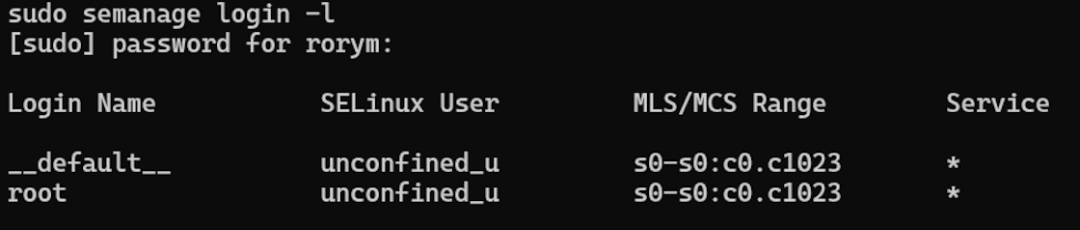

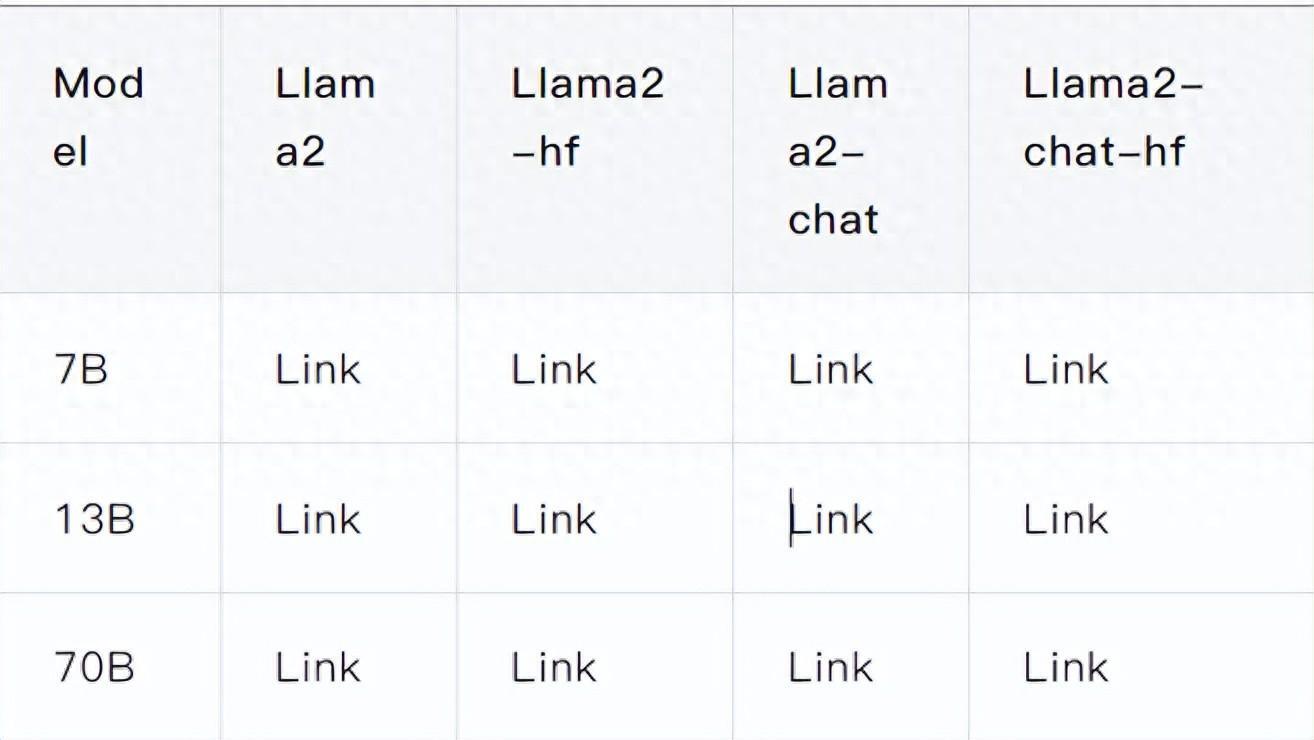

llama2 大模型介绍

我们开发并发布了 Llama 2,这是一组经过预训练和微调的大型语言模型 (LLM),其参数规模从 70 亿到 700 亿不等。我们经过微调的大语言模型(称为 Llama 2-Chat)针对对话用例进行了优化。我们的模型在我们测试的大多数基准上都优于开源聊天模型,并且根据我们对有用性和安全性的人工评估,可能是闭源模型的合适替代品

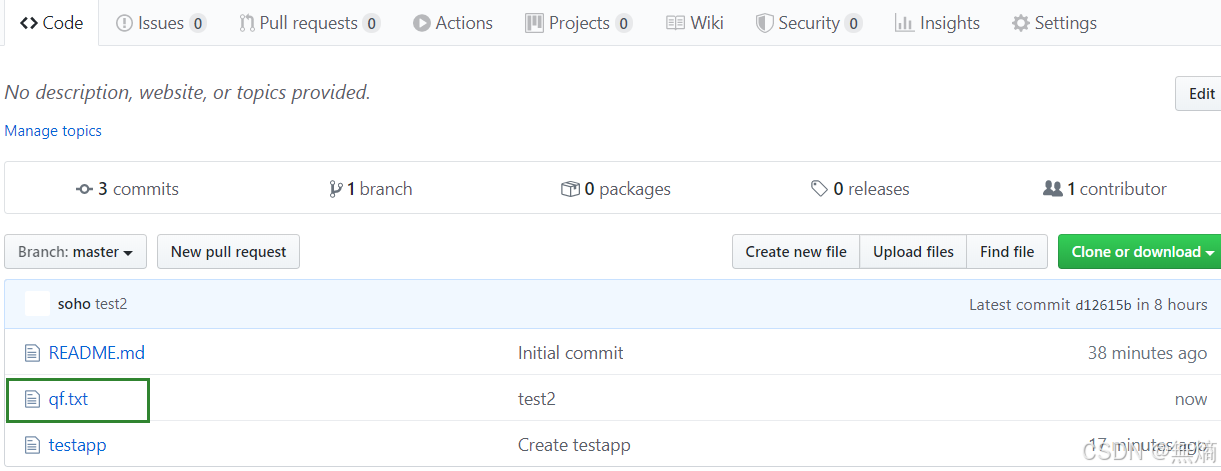

llama 大语言模型提供的主要模型列表

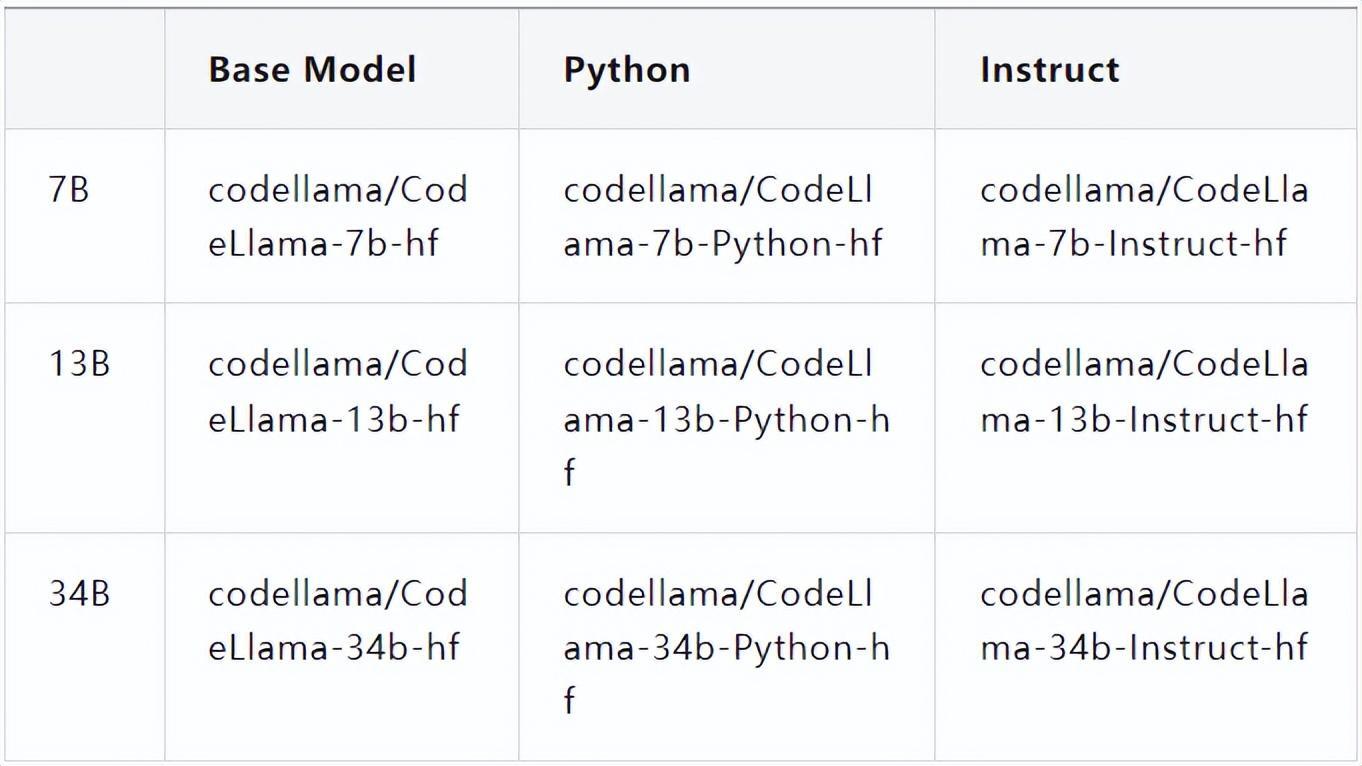

Code Llama 模型

Code Llama 是一个基于 Llama 2 的大型代码语言模型系列,在开放模型、填充功能、对大输入上下文的支持以及编程任务的零样本指令跟踪能力中提供最先进的性能。我们提供多种风格来覆盖广泛的应用程序:基础模型 (Code Llama)、Python 专业化 (Code Llama - Python) 和指令跟随模型 (Code Llama - Instruct),每个模型都有 7B、13B 和 34B 参数。所有模型均在 16k 个标记序列上进行训练,并在最多 100k 个标记的输入上显示出改进。7B 和 13B Code Llama 和 Code Llama - 指令变体支持基于周围内容的填充。Code Llama 是通过使用更高的代码采样对 Llama 2 进行微调而开发的。与 Llama 2 一样,我们对模型的微调版本应用了大量的安全缓解措施。有关模型训练、架构和参数、评估、负责任的人工智能和安全性的详细信息,请参阅我们的研究论文。Llama 材料(包括 Code Llama)的代码生成功能生成的输出可能受第三方许可的约束,包括但不限于开源许可。

Code Llama 提供的主要模型列表

申请模型

申请地址https://ai.meta.com/resources/models-and-libraries/llama-down...

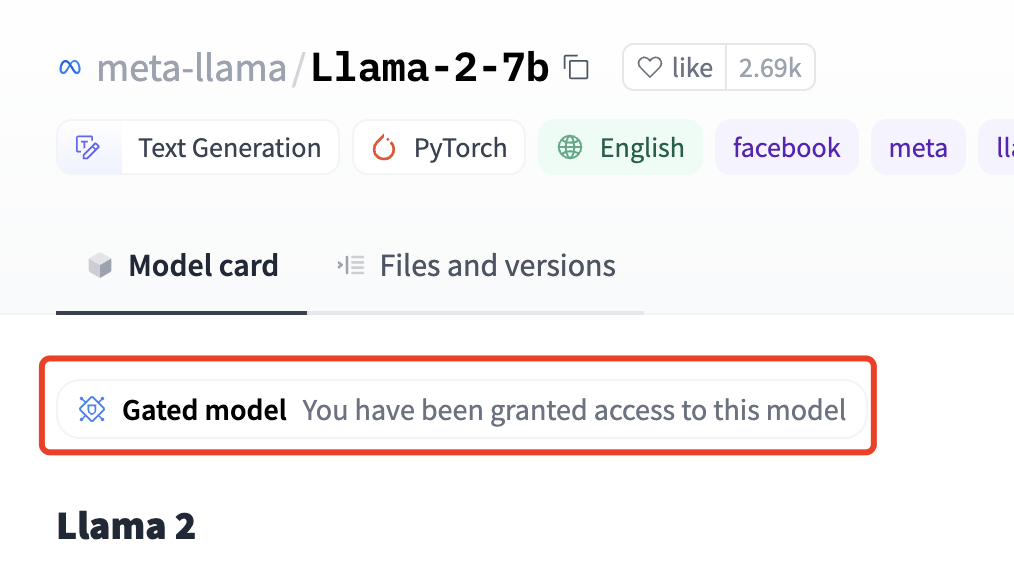

申请通过后,在 hugging face 上如果邮箱一致,会提示已经授权

使用模型

-

使用官方的 Api

-

使用第三方封装 Api llama.cpp-python ollama

-

使用 langchain

-

使用 hugging face 的 transformers

llama

https://github.com/facebookresearch/llama

torchrun --nproc_per_node 1 example_text_completion.py \--ckpt_dir llama-2-7b/ \--tokenizer_path tokenizer.model \--max_seq_len 128 --max_batch_size 4

复制代码

NCCL 错误

RuntimeError: Distributed package doesn't have NCCL built in

windows 和 mac 上基本跑不起来,因为 torchrun 依赖 NCCL

https://pytorch.org/docs/stable/distributed.html

llama.cpp

https://github.com/ggerganov/llama.cpp

Port of Facebook's LLaMA model in C/C++

因为很多同学受限于个人电脑的环境,没法运行完整的 llama 模型。llama.cpp 提供了一个非常好的移植版本,可以降低电脑的硬件要求,方便个人电脑运行与测试。

下载

git clone https://github.com/ggerganov/llama.cpp.gitcd llama.cpp

复制代码

make

模型转换

通过对模型进行转化,可以降低资源消耗。

# obtain the original LLaMA model weights and place them in ./modelsls ./models65B 30B 13B 7B tokenizer_checklist.chk tokenizer.model# [Optional] for models using BPE tokenizersls ./models65B 30B 13B 7B vocab.json# install Python dependenciespython3 -m pip install -r requirements.txt# convert the 7B model to ggml FP16 formatpython3 convert.py models/7B/# [Optional] for models using BPE tokenizerspython convert.py models/7B/ --vocabtype bpe# quantize the model to 4-bits (using q4_0 method)./quantize ./models/7B/ggml-model-f16.gguf ./models/7B/ggml-model-q4_0.gguf q4_0# update the gguf filetype to current if older version is unsupported by another application./quantize ./models/7B/ggml-model-q4_0.gguf ./models/7B/ggml-model-q4_0-v2.gguf COPY# run the inference./main -m ./models/7B/ggml-model-q4_0.gguf -n 128

复制代码

此步可以省略,直接下载别人转换好的量化模型即可。

https://huggingface.co/TheBloke/Llama-2-7b-Chat-GGUF

运行

命令行交互模式

./main -m ./models/llama-2-7b.Q4_0.gguf -i -n 256 --color复制代码

开启 server 模式,访问 http://127.0.0.1:8080/

./server -m ./models/llama-2-7b.Q4_0.gguf复制代码

llama-cpp-python

https://github.com/abetlen/llama-cpp-python

pip install llama-cpp-python复制代码

mac m1 上构建的时候需要加上特殊的参数

CMAKE_ARGS="-DLLAMA_METAL=on -DCMAKE_OSX_ARCHITECTURES=arm64" FORCE_CMAKE=1 pip install -U llama-cpp-python --no-cache-dir --force-reinstall复制代码

启动 Api 模式

pip install llama-cpp-python[server]python -m llama_cpp.server --model models/llama-2-7b.Q4_0.ggufpython -m llama_cpp.server --model models/llama-2-7b.Q4_0.gguf --n_gpu_layers 1

复制代码

访问 http://localhost:8000/docs 可以看到 api 的文档,与 openai 兼容。

ollama

-

官网 https://ollama.ai/

-

github https://github.com/jmorganca/ollama

-

docker https://ollama.ai/blog/ollama-is-now-available-as-an-official...

(base) hogwarts: ~ seveniruby$ ollama serve codellama:7b2023/10/08 02:31:04 images.go:987: total blobs: 62023/10/08 02:31:04 images.go:994: total unused blobs removed: 02023/10/08 02:31:04 routes.go:535: Listening on 127.0.0.1:11434

基于 langchain 使用 llama

使用 langchain 调用

def test_llama_cpp_local():"""使用本地模型:return:"""llm = Llama(model_path="/Users/seveniruby/projects/llama.cpp/models/llama-2-7b.Q4_0.gguf")output = llm("Q: 法国的首都在哪里\n A: ", echo=True, max_tokens=6, temperature=0)debug(json.dumps(output, indent=2, ensure_ascii=False))

复制代码

输出

{"id": "cmpl-6d3e491e-716f-4e6c-b167-4f52e3f9786f","object": "text_completion","created": 1696709780,"model": "/Users/seveniruby/projects/llama.cpp/models/llama-2-7b.Q4_0.gguf","choices": [{"text": "Q: 法国的首都在哪里\n A: 巴黎。\n","index": 0,"logprobs": null,"finish_reason": "length"}],"usage": {"prompt_tokens": 18,"completion_tokens": 6,"total_tokens": 24}}

复制代码

使用 langchain 结合 api 服务

def test_langchain_llm():llm = OpenAI(openai_api_key=None,openai_api_base='http://127.0.0.1:8000/v1',stop=["Q:", "\n"])debug(llm)prompt = "Q: 中国的首都在哪里?A: "output = llm(prompt)debug(output)

复制代码

基于 langchain 与 hugging face

def test_pipeline():pipe = pipeline("text-generation",model="meta-llama/Llama-2-7b-hf",torch_dtype=torch.float16,device='mps', # 按需改成你的cuda或者cpurevision='main',)debug(pipe)debug(pipe('法国的首都在哪里'))

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓