为了提高视觉变压器的精度和泛化能力,近年来出现了基于Poolingbased Vision Transformer (PiT)、卷积视觉变压器(CvT)、CrossFormer、CrossViT、NesT、MaxViT和分离式视觉变压器(SepViT)等新模型。

它们被用于BreakHis和IDC数据集上的图像分类,用于数字乳腺癌组织病理学。在BreakHis上训练之后,在IDC数据集上进行微调,以测试他们的泛化能力。MaxViT被发现是最好的基于Transformer的分类器,在BreakHis上达到91.57%的测试准确率,在IDC上达到91.8%,在BreakHis上预训练然后在IDC上微调时达到92.12%。然而,与现有作品相比,所选择的模型都没有表现出显着改善的性能。因此,突出了表现最好的模型的共同特征,并对进一步提高模型的精度和泛化能力提出了结构性建议。

1. 引言

组织病理学是医学诊断的一个重要分支,涉及组织疾病的研究和发现。组织病理学家在显微镜下观察组织样本的许多特性,如细胞密度、大小、细胞核和组织颜色。由此,他们可以了解组织是否患病,如果患病,患病程度如何。在乳腺癌组织病理学中,需要检测的组织样本取自患者的乳房,用于诊断患者是否患有乳腺癌。诊断还可以揭示病人可能患的癌症的阶段和类型。

当模型被训练来明确区分代表健康和癌变乳腺组织样本的图像时,这个过程被称为数字乳腺癌组织病理学。然而,为该任务选择最佳分类器的问题仍然存在。

Vision Transformers(ViTs)的发明[4],它显示出在使用更少的计算资源的同时提供更高分类精度的潜力。因此,ViT模型可能被证明是解决数字乳腺癌组织病理学中智能图像分类问题的方法。

2. 文献综述

CNN模型仍然是处理计算机视觉任务的首选。它们被广泛用于各种应用,如蒙面识别[13]、行人检测[14]、植物病害分类[15]、道路物体检测[16]等。AlexNet, ResNet和VGG-16架构似乎是最受欢迎的,并且很少显示出低于95%的准确性。这种普及延伸到医疗计算机视觉任务。通过CT、MRI和x线扫描,CNN模型已被用于几种疾病的计算机辅助诊断(CAD)。在LUNA16数据集中,使用SGD优化器的AlexNet在肺癌检测方面相对表现最好[17]。使用MRI图像识别脑肿瘤的CNN架构也是如此[18]。另一项针对脑肿瘤分类的研究发现,ResNet50是该任务的最佳模型[19]。CNN模型在四个相关数据集上进行了尝试和测试,发现即使对于阿尔茨海默病的诊断也是可靠的[20]。这些模型在针对特定任务进行微调时也显示出性能的提高[21]。

虽然CNN模型表现出良好的性能和效率,但没有一种架构可以最有效地适用于所有医疗计算机视觉任务。此外,训练模型时使用的预处理技术、优化器和其他参数会显著影响性能。因此,寻找最佳模式的工作仍在继续。受Transformer结构在语言处理任务中的成功启发,视觉转换器(Vision transformer, ViT)[4]被创造出来。通过对该模型的实验表明,尽管ViT对任何类型的图像数据都具有良好的分类精度,但它缺乏归纳偏差。为此,一些作品提出了混合变压器和CNN架构,以便将两者的优点结合到一个模型中。其他基于ViT的模型则提出了改进的注意机制来提高其泛化能力。

这些模型大多是在大型数据集(如ImageNet-21k)上进行训练和测试的,这些数据集不关注特定类型的图像数据。因此,这项工作冒险在更小的、专门的数据集上测试它们的性能。它们的泛化能力是通过微调阶段来测试的。

3. 实验方法

3.1 数据集

选择BreakHis和IDC两个乳腺癌组织病理学数据集。来自这些数据集的图像在用于训练和测试所选模型之前进行数据增强,作为后续方法的一部分。应用数据增强的实验阶段如图3所示,所使用的确切技术将在第4节中介绍。

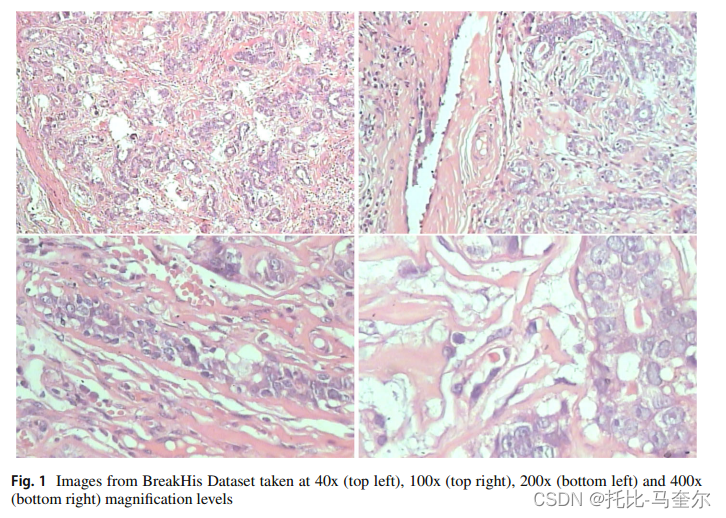

3.1.1 BreakHis数据集

BreakHis数据集由7909张乳腺肿瘤组织图像组成,以四种不同的放大倍数:40倍、100倍、200倍和400倍[1]。其中良性样本2480个,恶性样本5429个。每张图像的大小为700 x 460像素,3通道(RGB),并提供PNG格式。BreakHis中的图像可以根据特定的肿瘤类型进一步分类。良性肿瘤可分为腺病、纤维腺瘤、叶状瘤、管状腺瘤等类型,恶性肿瘤可分为导管癌、小叶癌、粘液癌、乳头状癌等类型。然而,本研究仅将数据集用于二元分类(即良性或恶性分类)。

3.1.2 IDC数据集

IDC数据集[2,3]采集了162张40x扫描的浸润性导管癌(乳腺恶性肿瘤的一种)整张幻灯片图像,从中提取5