一、下载地址

maxkb:https://maxkb.cn/

ollama: https://ollama.com/download/windows

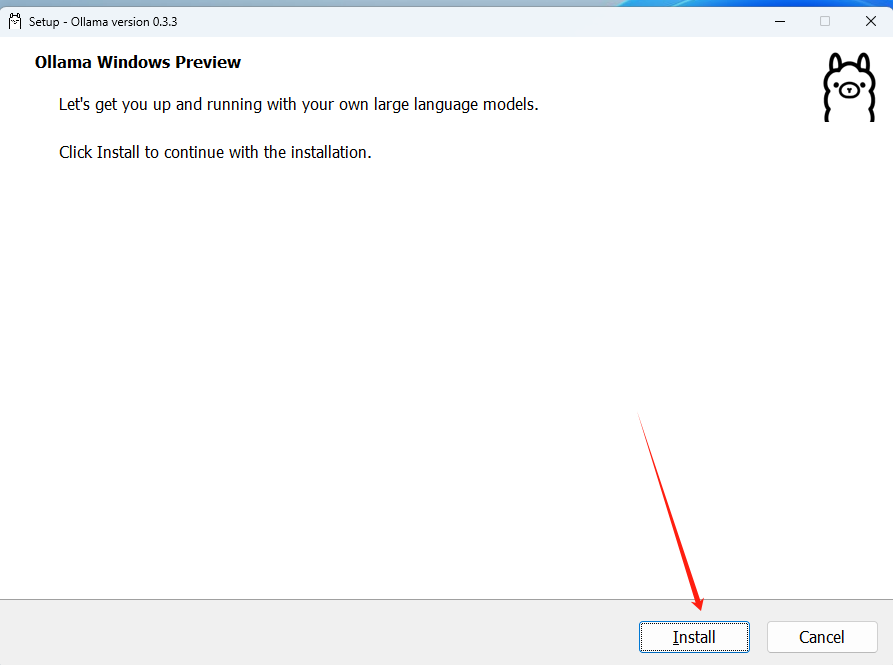

二、安装ollama

2.1 默认安装

直接install就好,默认是安装到C盘里面的。

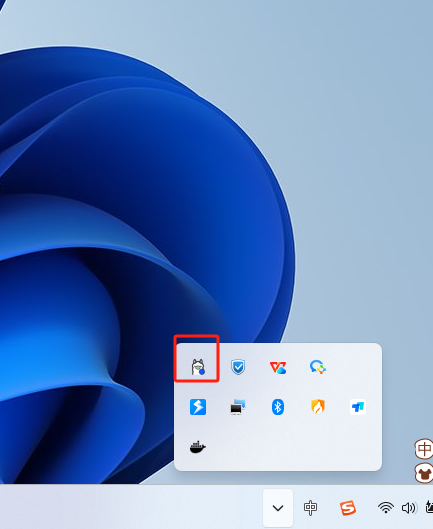

安装好之后会显示在

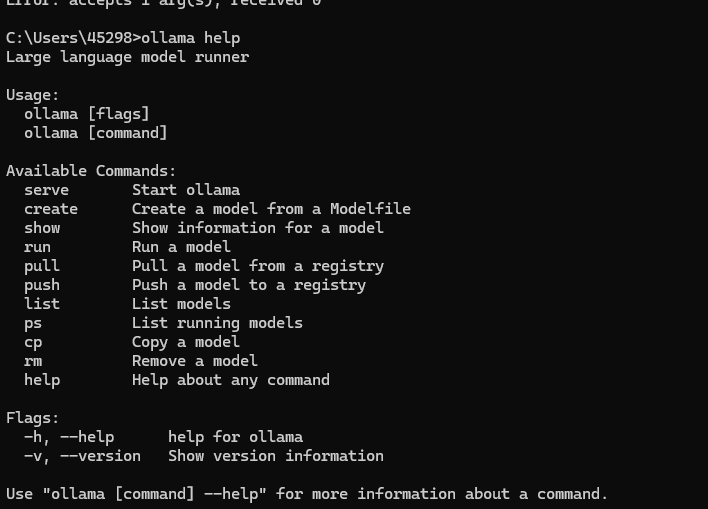

直接打开cmd黑窗口,输入命令即可查看。

2.2 ollama 常用命令

ollama serve 启动ollama

ollama create 从模型文件创建模型

ollama show 显示模型信息

ollama run 运行模型

ollama pull 从注册表中拉取模型

ollama push 将模型推送到注册表

ollama list 列出模型

ollama cp 复制模型

ollama rm 删除模型

ollama help 获取有关任何命令的帮助信息

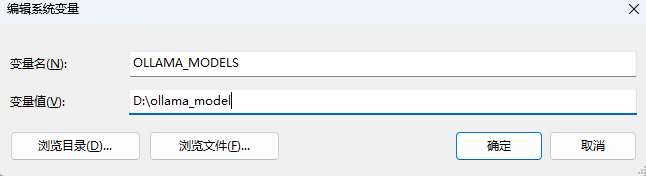

2.3 设置模型位置

默认安装的是C盘里面,可以设置模型的安装位置。OLLAMA_MODELS

设置好路径之后,一定要重新启动重启,才能生效。

2.4 设置本地IP访问ollama

本地下载好ollam之后,通过 http://localhost:11434/ 是可以直接访问的,但有些小伙伴通过本机ip或者127是访问不到的。这里教大家怎么设置通过本机ip地址去访问。

添加环境变量:

OLLAMA_HOST:11434 (这个端口是可以改的)

重启ollama,然后通过本地ip访问,如下图:

三、部署maxkb

windows部署maxkb也很方便,通过本地虚拟机+docker的方式部署即可。

参考:Windows启用Hyper-V详细安装Centos7教程

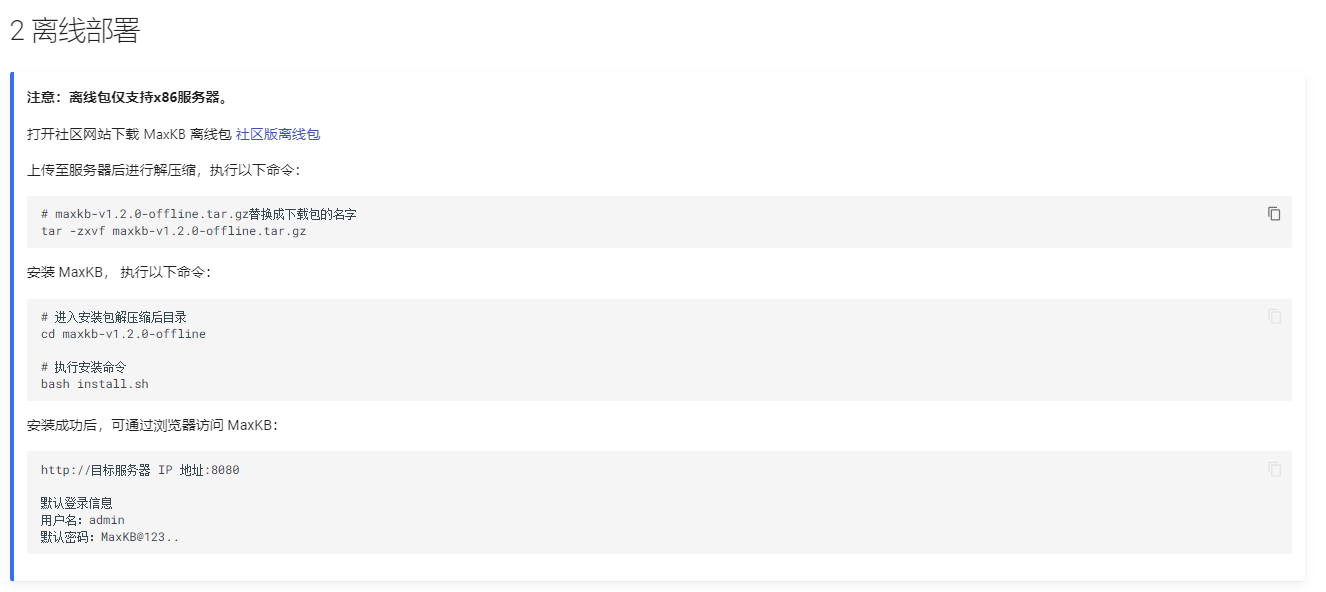

虚拟机部署好之后,我们直接通过安装包安装即可。

参考官网下载离线包:下载安装包

安装过程当中如果有问题,检查一下自己防火墙是否关闭。

四、对接ollama模型

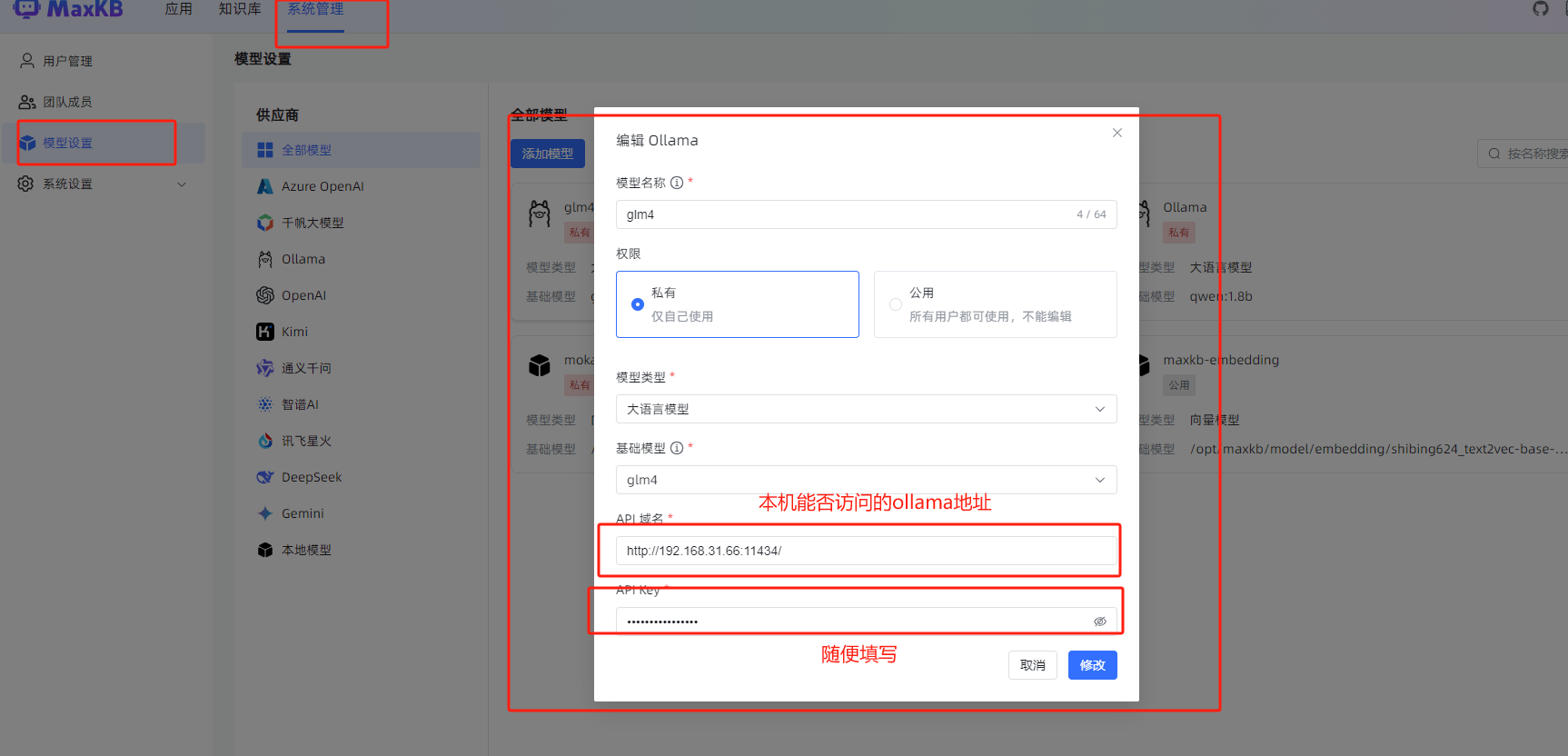

登录进maxkb之后,【系统管理】->【模型设置】->【添加模型】选择ollama,参考一下配置即可,

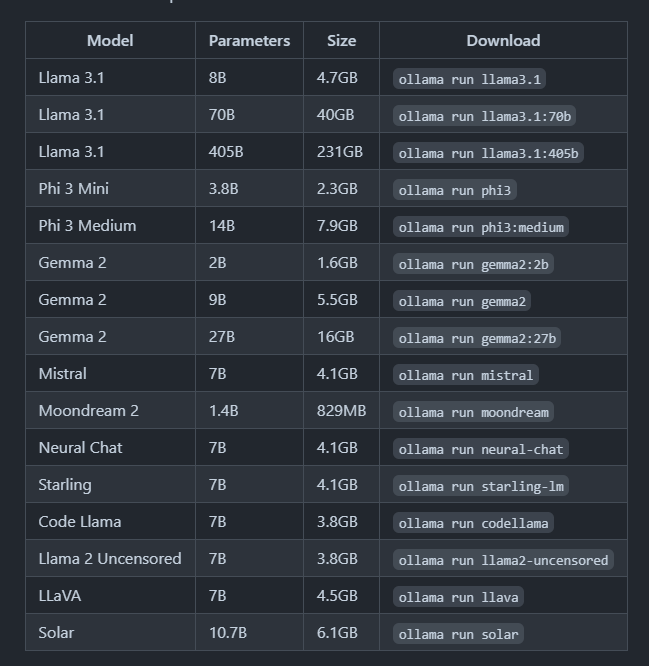

选择自己适合的模型。

注意:

1、 如果基础模型里面没有自己需要的,直接手动输入,然后回车即可。

2、 选择好模型之后,点击保存,会自动下载。下载速度,取决于自己网速。

模型参考:

五、创建应用

我们直接新建一个“简单配置”的应用。然后选择我们添加的模型,即可调试。

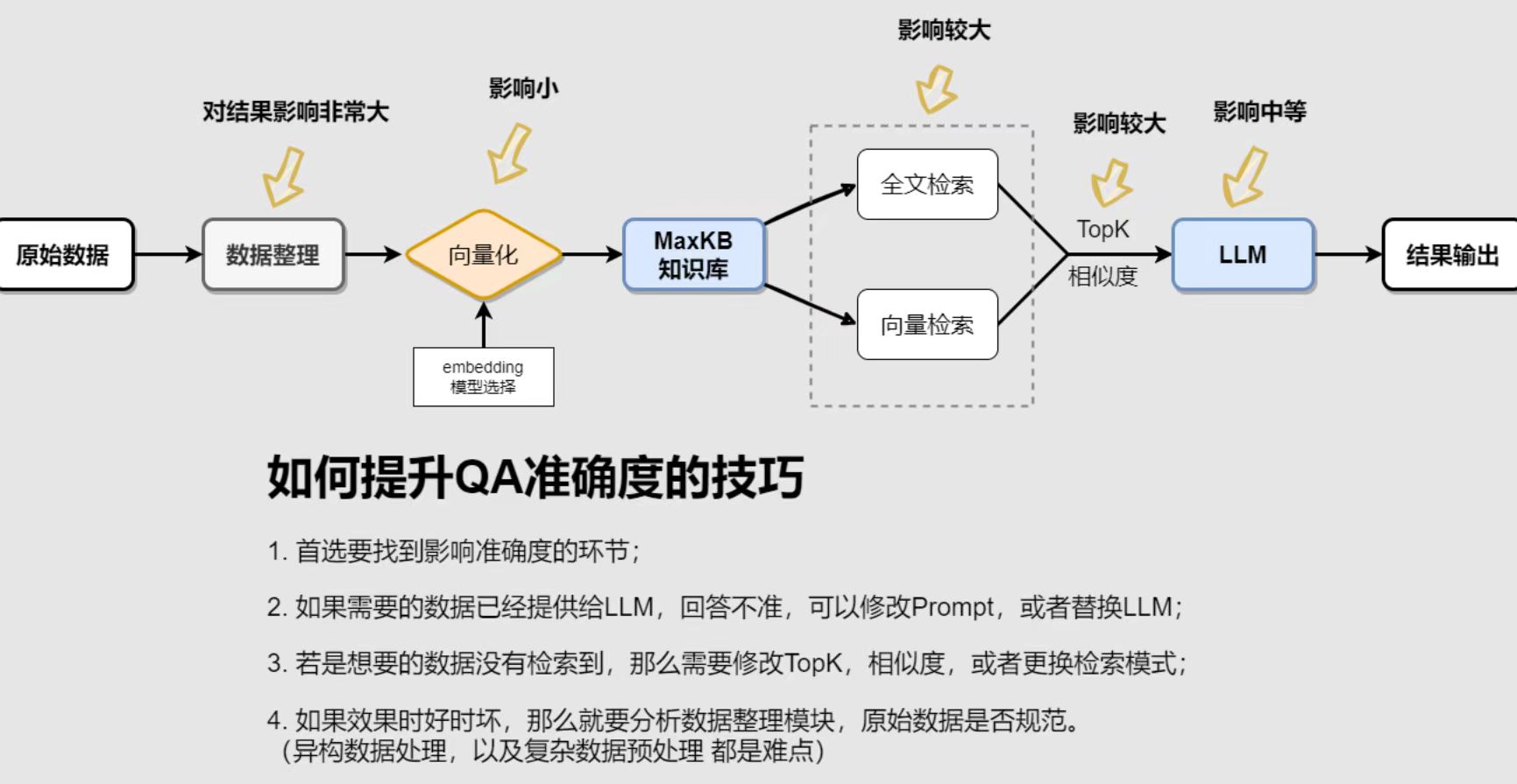

以上是一个部署简单应用的示例。具体如何更加精准的获取知识库当中的内容,这里给大家放一张简单的调优图作为参考。