1. 引言

最近在部署Qwen模型时,文档上有提到强烈建议用vLLM来部署模型,按照公开的性能测试数据,用vLLM部署Qwen模型的文本推理速度要比transformers部署快3~4倍。带着这个好奇就开始安装尝试,但试下来这个安装过程并没有那么顺利,便有了此文来记录整个环境搭建的过程。

vLLM是伯克利大学LMSYS组织开源的大语言模型高速推理框架,利用了全新的注意力算法「PagedAttention」,有效地管理Attention中的K和V。在吞吐量方面,vLLM的性能比HuggingFace Transformers(HF)高出 24 倍,文本生成推理(TGI)高出3.5倍。

2. vLLM环境要求

vLLM的安装指导说明上对python和cuda有着明确的版本要求,如下面截图所示:

vLLM安装指导地址:https://docs.vllm.ai/en/latest/getting_started/installation.html

首先是python,由于前面在不知情的情况下,已经安装了最新的python3.12版本,那就只能新创建一个3.10的虚拟环境。

conda及虚拟环境的创建请参考:conda环境搭建笔记

其次是cuda,vLLM是拿12.1版本编译的,但本地机器装的cuda为12.0,尝试过向下兼容的方式后无果,最终选择按照官方建议的cuda-12.1来重新安装,这意味着不仅仅是vLLM,机器上已经安装的pytorch、cuda都需要重新安装。

安装说明上有提供cuda-11.8的版本,正好之前pytorch安装时选择的也是cuda-11.8,所以尝试过取巧直接安装11.8,但最终没有成功,报一些cuda.C的一些.so动态库找不到(具体信息未能保留下来),就放弃了。

由于cuda是pytorch和vLLM的基础依赖,首先需要重装cuda。

3. CUDA安装

3.1 下载安装包

下载网址:https://developer.nvidia.com/cuda-toolkit-archive

首先选择自己要安装的版本(12.1):

逐个勾选自己的环境信息,勾选完后下面会自动出现与所选环境匹配的安装指令:

先复制上面的wget指令,下载文件(文件有4G,需要下一段时间)。

3.2 安装

下载完后执行如下命令开始安装。

sudo sh cuda_12.1.0_530.30.02_linux.run

安装程序正式开始复制文件之前,可能会有两个小插曲(具体与本地环境有关):旧环境兼容性检测和GPU是否在使用的检查。

3.2.1 旧环境兼容性检测

刚启动安装时会执行对本地旧环境的兼容性检测,如果发现本地机器的nvidia驱动与要安装的cuda版本不一致,安装程序会强烈建议你将已经存在的nvidia驱动卸载(命令如下面所示)。

apt-get remove --purge nvidia-driver-530

apt-get autoremove

需要注意的是此命令的用途,它会将机器上已经存在的nvidia驱动删除,个人猜测目的可能是为了保持cuda与的nvidia驱动的版本一致。

这里尝试过不卸载,但没有成功,cuda与nvidia版本不一致可能会导致驱动无法工作,运行nvidia-smi命令报如下截图中错误,最后还是乖乖按照指示进行了删除操作。

3.2.2 GPU是否在使用的检查

安装程序会检测GPU是否在使用中,如果在使用中,会提示退出所有GPU之后才能继续安装。

如果此时nvidia-smi命令可用,可以从命令输出结果中看到哪个进程在使用GPU:

查到被占用的GPU序号(上面截图中是0),则可以用如下命令来释放GPU:

sudo nvidia-smi --gpu-reset -i 0

GPU 00000000:3E:00.0 was successfully reset.

All done.

上面的方法是基于nvidia-smi存在的情况下,但是如果前面已经卸载了nvidia驱动程序(nvidia-smi命令也会被删除),那用什么方法查看GPU的状态呢?

用fuser命令能够列出哪些进程在使用GPU,然后使用kill命令将这些进程结束就行。

# 查找所有使用GPU的进程

sudo fuser -v /dev/nvidia*

sudo kill -9 <PID>

3.2.3 主流程安装

之后会提示你去勾选要安装的功能清单,用默认就好。

安装过程中,如果前面卸载了nvidia驱动程序,此时会自动安装与cuda版本配套的nvidia驱动程序,而cuda则会被安装到/usr/local/cuda-12.1目录下,安装完后的磁盘位置如下图所示:

3.3 配置环境变量

将cuda的库和命令添加到环境变量中。

echo 'export PATH=/usr/local/cuda-12.1/bin:$PATH' >> ~/.bashrc

echo 'export LD_LIBRARY_PATH=/usr/local/cuda-12.1/lib64:$LD_LIBRARY_PATH' >> ~/.bashrc

source ~/.bashrc

验证cuda安装结果:

nvcc --version

nvcc: NVIDIA (R) Cuda compiler driver

Copyright (c) 2005-2023 NVIDIA Corporation

Built on Tue_Feb__7_19:32:13_PST_2023

Cuda compilation tools, release 12.1, V12.1.66

Build cuda_12.1.r12.1/compiler.32415258_0

验证nvidia驱动程序安装结果:

可以看到,这里显示的cuda version和上面nvcc命令显示的版本是一致的。

4. 重装pytorch

之前pytorch是基于cuda-11.8安装的,当上面cuda版本变更后,需要重新选择能适配cuda-12.1的pytorch版本重新安装。

注:pytorch一定要先于vllm来安装,因为vllm安装时会检测本地机器的cuda和pytorch是否满足版本要求,如果没有匹配的依赖,vllm是无法安装的。

具体过程这里就不细列,详情见: conda&pytorch环境搭建笔记

5. vllm

5.1 安装vllm

前面的cuda和pytorch都使用官方建议的版本后,安装vllm的命令就和正常库的安装命令一样,但是由于下载的软件包很多,这个过程也会比较长。

pip install vllm

安装完成后如下图所示:

验证vllm的安装结果:

!pip show vllm

WARNING: Ignoring invalid distribution -orch (/data2/anaconda3/envs/python3_10/lib/python3.10/site-packages)

Name: vllm

Version: 0.5.3.post1

Summary: A high-throughput and memory-efficient inference and serving engine for LLMs

Home-page: https://github.com/vllm-project/vllm

Author: vLLM Team

Author-email:

License: Apache 2.0

Location: /data2/anaconda3/envs/python3_10/lib/python3.10/site-packages

Requires: aiohttp, cmake, fastapi, filelock, lm-format-enforcer, ninja, numpy, nvidia-ml-py, openai, outlines, pillow, prometheus-client, prometheus-fastapi-instrumentator, psutil, py-cpuinfo, pydantic, pyzmq, ray, requests, sentencepiece, tiktoken, tokenizers, torch, torchvision, tqdm, transformers, typing-extensions, uvicorn, vllm-flash-attn, xformers

Required-by:

5.2 验证vllm功能

在jupyter里贴一段加载模型的代码,尝试将本地下载好的模型Load进来:

from transformers import AutoTokenizer

from vllm import LLM, SamplingParams

model_dir = "/data2/anti_fraud/models/modelscope/hub/Qwen/Qwen2-0___5B-Instruct"

# Initialize the tokenizer

tokenizer = AutoTokenizer.from_pretrained(model_dir)

# max_tokens is for the maximum length for generation.

sampling_params = SamplingParams(temperature=0.7, top_p=0.8, repetition_penalty=1.05, max_tokens=512)

# Input the model name or path. Can be GPTQ or AWQ models.

llm = LLM(model=model_dir)

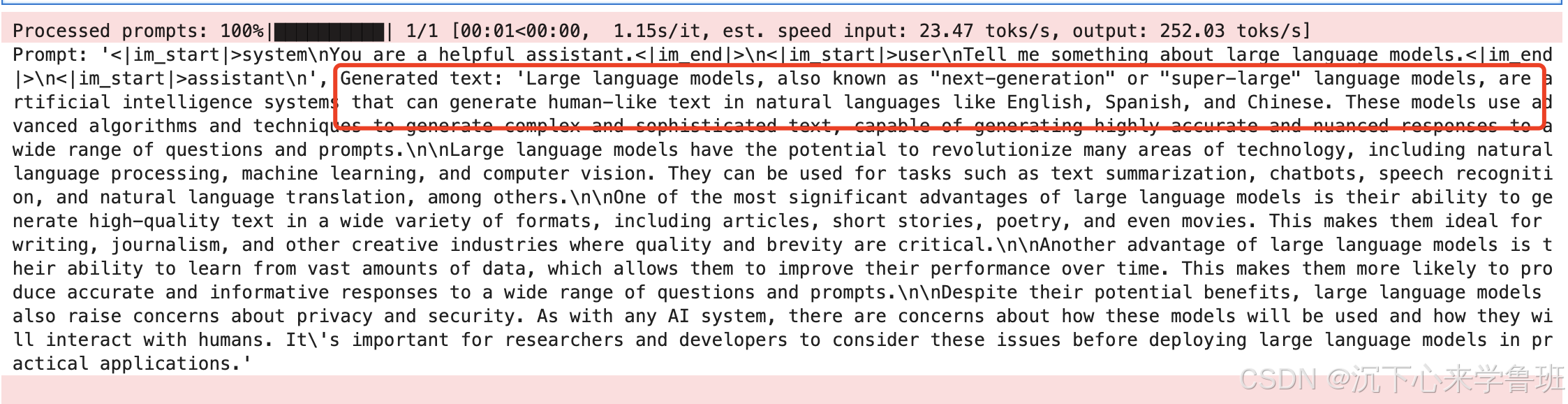

再贴一段代码来测试模型是否能正常推理:

# Prepare your prompts

prompt = "Tell me something about large language models."

messages = [

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": prompt}

]

text = tokenizer.apply_chat_template(

messages,

tokenize=False,

add_generation_prompt=True

)

# generate outputs

outputs = llm.generate([text], sampling_params)

# Print the outputs.

for output in outputs:

prompt = output.prompt

generated_text = output.outputs[0].text

print(f"Prompt: {prompt!r}, Generated text: {generated_text!r}")

生成的文本如下:

参考资料:

- conda&pytorch环境搭建笔记

- cuda-tool 官方下载地址

- vllm部署Qwen说明文档

![【笔记】《冲击弹性波理论与应用》[2-2] 振动信号分析](https://i-blog.csdnimg.cn/direct/e669890d76914764a5b7b1285e3de3db.png)