使用 WeNet 训练 AISHELL-1 模型的详细入门指南

在这篇文章中,我们将通过 WeNet 框架详细介绍如何训练 AISHELL-1 数据集的语音识别模型。我们将逐步解释各个阶段的操作,适合初学者入门。

1. 环境准备

1.1 安装miniconda

- miniconda官网

1. 获取下载链接

2. 在服务器使用wget命令,进行下载

wget https://repo.anaconda.com/miniconda/Miniconda3-latest-Linux-x86_64.sh

3. 给下载文件加上可执行权限

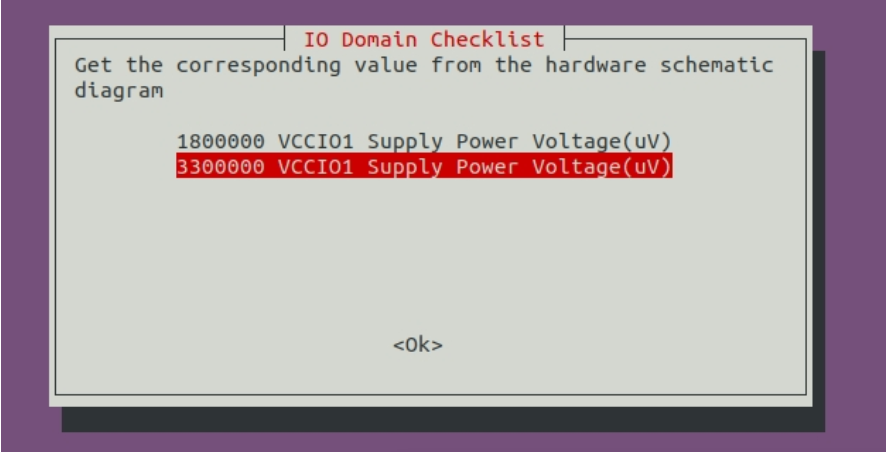

未加执行权限,无高亮,不可安装。

chmod +x Miniconda3-latest-Linux-x86_64.sh

赋予可执行权限,显示高亮

4. 安装 miniconda

./Miniconda3-latest-Linux-x86_64.sh

1.2 创建虚拟环境

conda create -n wenet python=3.10

conda activate wenet

- 坑点:出现conda: command not found报错和无法自动激活base环境问题的解决方案

解决方法:执行以下命令。 (详细解决方法)

source ~/.bashrc

1.3 安装并配置WeNet

- 见GitHub上的wenet详细配置步骤

2. 数据准备

2.1 下载 AISHELL-1 数据集

你可以从 AISHELL 官方网站下载 AISHELL-1 数据集。下载后,解压缩数据集,并确保文件结构如下:

aishell/

├── wav/

│ ├── train/

│ ├── dev/

│ └── test/

└── text/

2.2 设定数据路径

在 example/aishell/s0/run.sh 文件中,修改数据路径变量 $data 指向你解压后的 AISHELL 数据集的绝对路径,例如:

data=/home/username/asr-data/aishell

3. 运行实验

WeNet 提供了一个完整的实验脚本,包含多个阶段。我们建议逐步运行每个阶段,以便理解整个训练过程。

3.1 运行各个阶段

在 example/aishell/s0 目录执行以下命令:

cd example/aishell/s0

bash run.sh --stage -1 --stop_stage -1 # 下载数据

bash run.sh --stage 0 --stop_stage 0 # 准备训练数据

bash run.sh --stage 1 --stop_stage 1 # 提取特征

bash run.sh --stage 2 --stop_stage 2 # 生成标签字典

bash run.sh --stage 3 --stop_stage 3 # 准备 WeNet 数据格式

bash run.sh --stage 4 --stop_stage 4 # 训练神经网络

bash run.sh --stage 5 --stop_stage 5 # 使用训练模型进行识别

bash run.sh --stage 6 --stop_stage 6 # 导出训练模型

你也可以一次性运行整个脚本:

bash run.sh --stage -1 --stop_stage 6

4. 各阶段详细说明

4.1 阶段 -1: 下载数据

此阶段将 AISHELL-1 数据下载到本地路径。下载可能需要几个小时。如果你已经下载过数据,请确保在 run.sh 文件中更改 $data 变量,并从 --stage 0 开始。

4.2 阶段 0: 准备训练数据

在此阶段,local/aishell_data_prep.sh 会将原始 AISHELL-1 数据整理成两个文件:

- wav.scp:每行记录两个用制表符分隔的列:

wav_id和wav_path - text:每行记录两个用制表符分隔的列:

wav_id和text_label

4.3 阶段 1: 提取特征

此阶段将原始 WAV 文件复制到 raw_wav/train/ 目录中,并使用 tools/compute_cmvn_stats.py 提取全局 CMVN(倒谱均值和方差归一化)统计信息,用于对声学特征进行归一化。

4.4 阶段 2: 生成标签字典

此阶段生成一个字典,其中映射标签符号(对于 AISHELL-1 使用字符)和整数索引。例如:

<blank> 0

<unk> 1

一 2

丁 3

...

<sos/eos> 4232

4.5 阶段 3: 准备 WeNet 数据格式

此阶段生成 WeNet 所需的格式文件 data.list。每行以 JSON 格式包含以下字段:

key:话语的键wav:话语的音频文件路径txt:标准化的转录文本

4.6 阶段 4: 训练神经网络

在此阶段,模型将开始训练。你可以使用多 GPU 模式,设置 CUDA_VISIBLE_DEVICES 来指定使用的 GPU 卡。配置文件(如 conf/train_conformer.yaml)可以设置神经网络结构、优化参数等。

你可以使用 TensorBoard 监控训练过程:

tensorboard --logdir tensorboard/$your_exp_name/ --port 12598 --bind_all

4.7 阶段 5: 使用训练模型进行识别

此阶段展示如何使用训练好的模型对一组 WAV 文件进行识别,并提供模型平均功能。你可以选择不同的解码方法,如 CTC 贪婪搜索、CTC 前缀束搜索和注意力解码。

4.8 阶段 6: 导出训练模型

通过运行 wenet/bin/export_jit.py,可以导出训练模型,以便在其他编程语言(如 C++)中进行推理。

5. 总结

通过以上步骤,你可以使用 WeNet 框架成功训练 AISHELL-1 数据集的语音识别模型。本文详细介绍了每个阶段的具体操作和功能,帮助初学者更好地理解整个训练流程。

如果在训练过程中遇到任何问题,请随时参考 WeNet 的文档或搜索相关社区讨论。希望这篇文章能帮助你顺利进行语音识别模型的训练!