Webinar主题:探索LLM大模型的小型化 —— 小模型在NVIDIA Jetson 与 NIM 平台的最佳实践

-

时间:6月25号 晚8点-9点

-

时长:1h

-

活动形式:线上

-

点击链接报名本次在线研讨会:https://www.nvidia.cn/webinars/sessions/?session_id=240625-32973

-

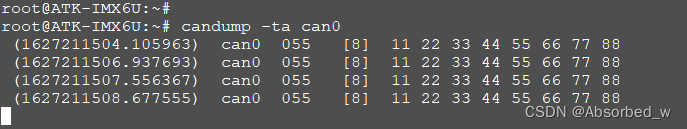

内容描述:

在当前高速发展的人工智能领域,如何高效的部署和优化 SLM(小型的大模型) 成为关键。随着微软 Phi-3 系列模型的发布,让 SLM在 NVIDIA Jetson 边缘计算平台上的部署成为可能。同时 Phi-3 系列模型已在NVIDIA NIM平台提供加速的推理服务。

NVIDIA NIM 是一套用于部署 AI 模型的推理微服务,是一套易于使用的预构建容器工具。帮助企业客户加速在云、数据中心和工作站中部署生成式 AI 模型。让各类生成式 AI 模型的使用更为便捷和高效,为 AI 技术带来了新的突破和无限可能。

通过参加本次在线研讨会,您将了解到如何利用这些先进的模型和平台实现生成式 AI 的最佳实践,推动您的 AI 项目更上一层楼。

通过本次网络研讨会的主题演讲,您可以收获以下内容:

Topic1:Phi3 SLM在Jetson边缘计算设备上的部署 (20 min)

• Phi3 系列模型介绍

• Phi3 与 Ollma的结合使用

• Phi3 模型在Jetson边缘计算设备上的部署实战

卢建晖(Kinfey Lo) | 微软高级云技术布道师

专注在人工智能及大数据领域,具备 15 年以上的电信,教育,金融服务行业经验。是微软 Build / Ignite / Teched 大会讲师,GitHub Copilot Workshop 讲师,Qcon 讲师,现负责生成式人工智能应用架构及 Microsoft Phi-3 小模型在行业中的应用落地工作。

Topic2:Phi3 SLM + NIM实现对话式AI场景中的应用 (15 min)

• NVIDIA NIM 推理微服务平台介绍

• NIM平台使用Phi3对话模型的方法

• 代码实践:Langchain结合NIM实现Phi3对话模型的推理

李奕澎 | NVIDIA 企业开发者社区经理

拥有多年数据分析建模、人工智能自然语言处理开发经验。在对话式人工智能与大模型技术领域有丰富的实战经验与见解。曾开发法律、金融、保险文档中基于实体抽取的智能问答系统,曾主导开发基于 NLP 知识抽取,KG 知识图谱的建立的科研文档智能检索系统。加入NVIDIA 开发者社区以来完成过上百场培训,帮助上万个开发者了解人工智能。

Topic3:Phi3 - Vision在NIM平台上实现多模态应用 (15min)

• Phi3 - Vision简介

• Phi3 - Vision基于NIM的调用方式

• 代码实践:基于NIM接口实现Phi3 - Vision的推理实践

何琨 (Ken He)| NVIDIA 企业级开发者社区经理

拥有多年的GPU 和人工智能开发经验。自2017年加入NVIDIA 开发者社区以来,完成过上百场培训,帮助上万个开发者了解人工智能和 GPU编程开发。

![[深度学习]循环神经网络RNN](https://img-blog.csdnimg.cn/direct/4becb76559ec4d59981a7868e4dcf3fb.png)