文章目录

- 引言

- 一、图数据及其应用场景

- 1.1 图数据的定义和特征

- 1.2 常见的图数据结构

- 1.2.1 社交网络

- 1.2.2 知识图谱

- 1.2.3 分子结构

- 1.2.4 交通网络

- 1.3 图数据在不同领域的应用实例

- 1.3.1 社交网络中的推荐系统

- 1.3.2 知识图谱中的信息检索

- 1.3.3 药物发现中的分子分析

- 1.3.4 智能交通系统中的路径优化

- 二、图神经网络的基础概念

- 2.1 图神经网络的基本构成和原理

- 2.2 GNN与传统神经网络的区别

- 2.3 常见的图神经网络模型

- 2.3.1 图卷积网络(GCN)

- 2.3.2 GraphSAGE

- 2.3.3 图注意力网络(GAT)

- 2.4 信息传递和聚合机制

- 三、图神经网络的关键技术

- 3.1 节点表示学习

- 3.2 图卷积运算

- 3.3 信息传递机制

- 3.4 聚合和更新操作

- 3.5 实际示例:节点分类任务

- 总结

引言

随着机器学习技术的迅猛发展,越来越多的数据类型得到了广泛的研究和应用。其中,图数据由于其能够表示复杂关系和结构的特点,逐渐成为研究的热点。然而,传统的机器学习和神经网络方法在处理图数据时往往力不从心,因为它们主要针对的是结构化数据(如表格数据)或序列数据(如文本和时间序列)。因此,如何高效地处理和分析图数据成为了一个重要的研究课题。

图数据在实际生活中无处不在,例如社交网络中的用户关系、知识图谱中的实体和关系、分子结构中的原子和键、以及交通网络中的道路和交叉口等。这些数据类型不仅复杂多样,而且包含丰富的上下文信息和隐含关系,传统的方法难以充分挖掘其潜在价值。

在这种背景下,图神经网络(Graph Neural Networks, GNN)应运而生。GNN通过引入图结构的特性,有效地解决了传统方法在处理图数据时的诸多限制。它能够捕捉图中节点和边之间的复杂关系,实现高效的节点表示学习和图结构信息的综合利用,从而在多个领域中展现出强大的应用潜力。

本篇文章将深入探讨图神经网络的基本概念、关键技术和实际应用案例,分析其优势与挑战,并展望其未来的发展趋势。通过本文,读者将全面了解图神经网络如何在处理复杂图数据方面发挥关键作用,以及这一技术在未来可能带来的创新和变革。

一、图数据及其应用场景

1.1 图数据的定义和特征

图数据是一种复杂的数据结构,由节点(vertices)和边(edges)组成,用于表示对象及其相互关系。节点代表数据中的实体,边则表示实体之间的关系。图数据的特征包括:

- 多样性:图数据可以表示各种类型的关系,如一对一、一对多、多对多等。

- 不规则性:图的结构不固定,节点和边的数量及连接方式可变。

- 高维性:每个节点和边可以包含丰富的属性信息,如节点的特征向量和边的权重等。

1.2 常见的图数据结构

1.2.1 社交网络

社交网络中的图数据由用户(节点)和用户之间的关系(边)组成,用户的属性可以包括年龄、性别、兴趣爱好等,关系则可以表示好友关系、关注关系等。

1.2.2 知识图谱

知识图谱是一种语义网络,用图结构表示实体及其关系。节点代表实体,如人物、地点、事件等,边表示实体之间的语义关系,如“位于”、“属于”、“相关”等。

1.2.3 分子结构

在化学和生物学中,分子可以表示为图结构,其中节点代表原子,边代表化学键。通过这种图结构,可以分析分子的性质、反应机制等。

1.2.4 交通网络

交通网络由道路和交叉口组成,交叉口作为节点,道路作为边。交通网络图数据可以用于路径规划、交通流量预测等。

1.3 图数据在不同领域的应用实例

1.3.1 社交网络中的推荐系统

通过分析社交网络中的用户关系和行为,可以为用户提供个性化的内容推荐,如好友推荐、商品推荐等。

1.3.2 知识图谱中的信息检索

利用知识图谱,可以实现更加精准的信息检索和问答系统。例如,通过语义理解和关系推理,回答复杂的问题或提供相关的信息。

1.3.3 药物发现中的分子分析

通过图神经网络对分子结构进行分析,可以加速药物发现过程,预测新分子的药效和毒性,提高研发效率。

1.3.4 智能交通系统中的路径优化

利用交通网络图数据,可以优化路径规划,减少交通拥堵,提升交通系统的整体效率。

二、图神经网络的基础概念

2.1 图神经网络的基本构成和原理

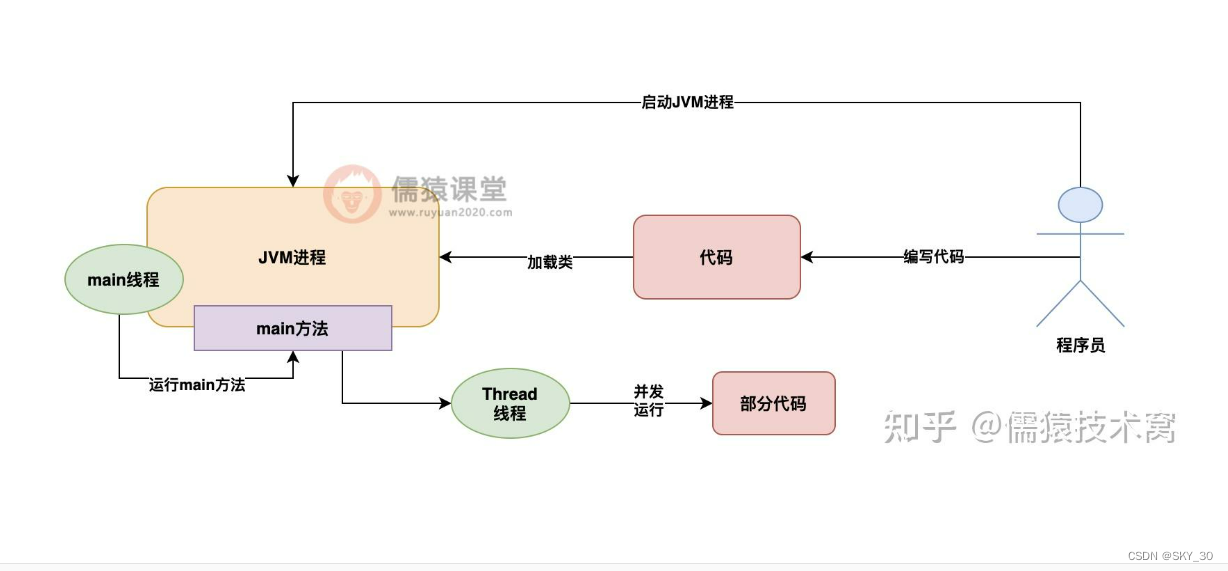

图神经网络(Graph Neural Networks, GNN)是一类专门用于处理图数据的神经网络模型。它们通过迭代地传递和聚合节点及其邻居的特征信息,从而学习节点和图的表示。GNN的基本构成包括:

- 节点特征(Node Features):每个节点都有一个特征向量,表示节点的属性信息。

- 边特征(Edge Features):每条边也可以有一个特征向量,表示边的属性信息。

- 聚合函数(Aggregation Function):用于从节点的邻居节点中收集信息。

- 更新函数(Update Function):用于更新节点的特征向量。

2.2 GNN与传统神经网络的区别

与传统的神经网络不同,GNN直接利用图结构进行计算,能够捕捉节点及其邻居之间的复杂关系。主要区别包括:

- 数据结构:传统神经网络处理的是固定结构的数据(如向量或矩阵),而GNN处理的是不规则的图数据。

- 信息传递:GNN通过节点之间的边进行信息传递,传统神经网络则通过层与层之间的连接进行信息传递。

- 节点间的依赖性:GNN能够自然地处理节点之间的依赖关系,而传统神经网络需要通过额外的处理步骤来显式建模这些关系。

2.3 常见的图神经网络模型

2.3.1 图卷积网络(GCN)

图卷积网络(Graph Convolutional Network, GCN)是一种常用的GNN模型,它通过对图进行卷积操作,逐层聚合邻居节点的特征信息。GCN的基本操作如下:

- 邻居聚合:每个节点收集其邻居节点的特征。

- 特征变换:对聚合后的特征进行线性变换。

- 非线性激活:应用非线性激活函数(如ReLU)。

示例代码:

import torch

import torch.nn.functional as F

from torch_geometric.nn import GCNConv

class GCN(torch.nn.Module):

def __init__(self, in_channels, out_channels):

super(GCN, self).__init__()

self.conv1 = GCNConv(in_channels, 16)

self.conv2 = GCNConv(16, out_channels)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.relu(x)

x = self.conv2(x, edge_index)

return F.log_softmax(x, dim=1)

2.3.2 GraphSAGE

GraphSAGE(Graph Sample and Aggregation)是一种可以在大规模图数据上进行训练的GNN模型。它通过采样固定数量的邻居节点来进行特征聚合,从而降低计算复杂度。GraphSAGE的聚合方法包括平均聚合、LSTM聚合和池化聚合。

示例代码:

from torch_geometric.nn import SAGEConv

class GraphSAGE(torch.nn.Module):

def __init__(self, in_channels, out_channels):

super(GraphSAGE, self).__init__()

self.conv1 = SAGEConv(in_channels, 16)

self.conv2 = SAGEConv(16, out_channels)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.relu(x)

x = self.conv2(x, edge_index)

return F.log_softmax(x, dim=1)

2.3.3 图注意力网络(GAT)

图注意力网络(Graph Attention Network, GAT)引入了注意力机制,通过计算节点与其邻居节点之间的注意力权重,来进行加权特征聚合。GAT的核心在于:

- 计算注意力系数:通过节点特征计算节点之间的相似度。

- 加权聚合:根据注意力系数对邻居节点特征进行加权求和。

示例代码:

from torch_geometric.nn import GATConv

class GAT(torch.nn.Module):

def __init__(self, in_channels, out_channels):

super(GAT, self).__init__()

self.conv1 = GATConv(in_channels, 8, heads=8)

self.conv2 = GATConv(8 * 8, out_channels, heads=1, concat=False)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.elu(x)

x = self.conv2(x, edge_index)

return F.log_softmax(x, dim=1)

2.4 信息传递和聚合机制

GNN通过信息传递和聚合机制,实现节点特征的更新和图结构信息的整合。主要步骤包括:

- 消息传递(Message Passing):节点将自身的特征信息发送给其邻居节点。

- 特征聚合(Feature Aggregation):节点接收来自邻居节点的特征信息并进行聚合。

- 特征更新(Feature Update):根据聚合后的特征信息,更新节点的特征向量。

三、图神经网络的关键技术

3.1 节点表示学习

节点表示学习是图神经网络的核心任务之一,旨在学习节点的嵌入向量,使其能够捕捉节点的结构和属性信息。这些嵌入向量可以用于下游任务,如节点分类、链接预测和图分类等。

示例代码(使用PyTorch Geometric中的GCN):

import torch

import torch.nn.functional as F

from torch_geometric.nn import GCNConv

class GCN(torch.nn.Module):

def __init__(self, in_channels, hidden_channels, out_channels):

super(GCN, self).__init__()

self.conv1 = GCNConv(in_channels, hidden_channels)

self.conv2 = GCNConv(hidden_channels, out_channels)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.relu(x)

x = self.conv2(x, edge_index)

return x # 返回节点嵌入向量

# 使用示例

model = GCN(in_channels=34, hidden_channels=16, out_channels=2)

3.2 图卷积运算

图卷积运算是图神经网络的基本操作,通过对图中的节点及其邻居进行卷积操作,实现信息的聚合与传递。常见的图卷积方法包括基于谱的图卷积和基于空间的图卷积。

示例代码(GCN的图卷积运算):

import torch

from torch_geometric.nn import GCNConv

class GCN(torch.nn.Module):

def __init__(self, in_channels, out_channels):

super(GCN, self).__init__()

self.conv1 = GCNConv(in_channels, out_channels)

def forward(self, x, edge_index):

x = self.conv1(x, edge_index)

return x

# 使用示例

model = GCN(in_channels=34, out_channels=16)

3.3 信息传递机制

信息传递机制是指图神经网络中节点之间通过边进行特征信息传递和聚合的过程。该机制包括消息传递和节点更新两个步骤。

示例代码(GraphSAGE的信息传递机制):

import torch

import torch.nn.functional as F

from torch_geometric.nn import SAGEConv

class GraphSAGE(torch.nn.Module):

def __init__(self, in_channels, hidden_channels, out_channels):

super(GraphSAGE, self).__init__()

self.conv1 = SAGEConv(in_channels, hidden_channels)

self.conv2 = SAGEConv(hidden_channels, out_channels)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.relu(x)

x = self.conv2(x, edge_index)

return x

# 使用示例

model = GraphSAGE(in_channels=34, hidden_channels=16, out_channels=2)

3.4 聚合和更新操作

聚合和更新操作是图神经网络中节点特征向量的聚合和更新过程。聚合操作从邻居节点收集特征,更新操作则使用聚合后的特征更新节点的特征向量。

示例代码(GAT的聚合和更新操作):

import torch

import torch.nn.functional as F

from torch_geometric.nn import GATConv

class GAT(torch.nn.Module):

def __init__(self, in_channels, hidden_channels, out_channels):

super(GAT, self).__init__()

self.conv1 = GATConv(in_channels, hidden_channels, heads=8, concat=True)

self.conv2 = GATConv(hidden_channels * 8, out_channels, heads=1, concat=True)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.elu(x)

x = self.conv2(x, edge_index)

return x

# 使用示例

model = GAT(in_channels=34, hidden_channels=8, out_channels=2)

3.5 实际示例:节点分类任务

示例代码(完整的节点分类任务流程):

import torch

import torch.nn.functional as F

from torch_geometric.nn import GCNConv

from torch_geometric.datasets import Planetoid

import torch_geometric.transforms as T

# 加载Cora数据集

dataset = Planetoid(root='/tmp/Cora', name='Cora', transform=T.NormalizeFeatures())

class GCN(torch.nn.Module):

def __init__(self, in_channels, hidden_channels, out_channels):

super(GCN, self).__init__()

self.conv1 = GCNConv(in_channels, hidden_channels)

self.conv2 = GCNConv(hidden_channels, out_channels)

def forward(self, data):

x, edge_index = data.x, data.edge_index

x = self.conv1(x, edge_index)

x = F.relu(x)

x = self.conv2(x, edge_index)

return F.log_softmax(x, dim=1)

# 模型初始化

model = GCN(in_channels=dataset.num_node_features, hidden_channels=16, out_channels=dataset.num_classes)

data = dataset[0]

optimizer = torch.optim.Adam(model.parameters(), lr=0.01, weight_decay=5e-4)

# 训练循环

def train():

model.train()

optimizer.zero_grad()

out = model(data)

loss = F.nll_loss(out[data.train_mask], data.y[data.train_mask])

loss.backward()

optimizer.step()

return loss.item()

# 测试函数

def test():

model.eval()

logits, accs = model(data), []

for _, mask in data('train_mask', 'val_mask', 'test_mask'):

pred = logits[mask].max(1)[1]

acc = pred.eq(data.y[mask]).sum().item() / mask.sum().item()

accs.append(acc)

return accs

for epoch in range(200):

loss = train()

train_acc, val_acc, test_acc = test()

print(f'Epoch: {epoch}, Loss: {loss:.4f}, Train Acc: {train_acc:.4f}, Val Acc: {val_acc:.4f}, Test Acc: {test_acc:.4f}')

总结

图神经网络(GNN)作为一种专门处理图数据的机器学习方法,因其在捕捉复杂关系和结构化数据方面的强大能力,正受到越来越多的关注和应用。本文主要探讨了以下几个方面:

1. 图数据及其应用场景

图数据通过节点和边表示实体及其关系,具有多样性、不规则性和高维性等特征。常见的图数据结构包括:

- 社交网络:节点表示用户,边表示用户之间的关系。主要用于用户关系分析和个性化推荐。

- 知识图谱:节点表示实体,边表示实体之间的语义关系。主要用于信息检索和问答系统。

- 分子结构:节点表示原子,边表示化学键。主要用于药物发现和分子分析。

- 交通网络:节点表示交叉口,边表示道路。主要用于路径规划和交通优化。

2. 图神经网络的基础概念

图神经网络通过迭代地传递和聚合节点及其邻居的特征信息,来学习节点和图的表示。其基本构成包括:

- 节点特征和边特征:表示节点和边的属性信息。

- 聚合函数和更新函数:用于特征的聚合和更新。

常见的GNN模型有:

- 图卷积网络(GCN):通过卷积操作聚合邻居节点的特征。

- GraphSAGE:通过采样邻居节点进行特征聚合。

- 图注意力网络(GAT):引入注意力机制进行加权特征聚合。

3. 图神经网络的关键技术

关键技术包括:

- 节点表示学习:通过学习节点的嵌入向量,捕捉节点的结构和属性信息。

- 图卷积运算:对图中的节点及其邻居进行卷积操作,实现信息的聚合与传递。

- 信息传递机制:包括消息传递和节点更新两个步骤,实现节点特征的传播和更新。

- 聚合和更新操作:从邻居节点收集特征并更新节点的特征向量。

通过图神经网络的这些关键技术,可以有效地应用于各种图数据相关的任务,如节点分类、链接预测和图分类等,显著提升了模型的性能和应用的广泛性。

总之,图神经网络为处理复杂的图数据提供了强大的工具,广泛应用于社交网络、知识图谱、化学分子和交通网络等领域,展现出了巨大的潜力和价值。