在自然语言处理(NLP)和信息检索领域,TF-IDF(Term Frequency-Inverse Document Frequency)算法是一种被广泛使用且极其重要的技术。它通过衡量单词在文档集中的重要性来帮助理解和处理文本数据。本文将详细探讨TF-IDF算法的原理、实现、应用及其在实际场景中的表现,并分析其优缺点以及未来发展方向。

一、TF-IDF算法的基本原理

TF-IDF算法由词频(Term Frequency, TF)和逆文档频率(Inverse Document Frequency, IDF)两部分组成。它们共同作用,衡量一个词在一组文档中的重要性。

-

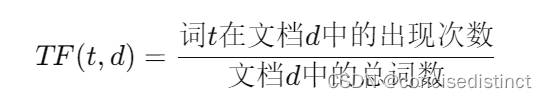

词频(TF) 词频表示一个词在文档中出现的频率。对于一个给定的词 ttt 和文档 ddd,其词频可以表示为:

词频的计算相对简单,通过统计每个词在文档中出现的次数即可。

-

逆文档频率(IDF) 逆文档频率衡量的是一个词在所有文档中出现的稀有程度。对于一个给定的词 ttt,其逆文档频率可以表示为:

其中,N 是文档总数,分母加1是为了防止分母为零的情况。IDF的作用是降低那些在大多数文档中都出现的常见词的权重。

-

TF-IDF值 TF-IDF值是词频和逆文档频率的乘积,用来表示一个词在文档中的重要性:

通过这种方式,TF-IDF可以有效地提高稀有但重要的词的权重,而降低那些常见词的权重。

二、TF-IDF算法的应用

TF-IDF算法在文本分析和信息检索中有广泛的应用,包括以下几个方面:

-

信息检索 TF-IDF是搜索引擎中常用的技术,用于计算查询词与文档之间的相关性。通过计算每个词的TF-IDF值,可以判断哪些文档与查询词最相关。

-

文本分类 在文本分类任务中,TF-IDF可以用作特征提取的方法。将每个文档表示为TF-IDF特征向量,然后使用机器学习算法进行分类。

-

关键词提取 TF-IDF可以用于自动提取文档的关键词,通过计算每个词的TF-IDF值,选出值最高的词作为关键词。

-

相似度计算 在文本相似度计算中,TF-IDF特征向量可以用于计算文档之间的余弦相似度,从而衡量文档之间的相似性。