Attention机制源于对序列建模中长期依赖关系的有效捕获需求,其理论基础在于让模型动态分配权重以聚焦于输入序列中与当前任务相关的关键部分。核心架构包括Query-Key-Value三元组计算、Softmax归一化的注意力得分、加权求和生成上下文向量,以及扩展至多头注意力以并行捕获不同子空间特征。广泛应用在机器翻译、文本摘要、问答系统、语音识别、推荐系统等,显著提升模型性能。

一、Attention机制的理论基础

1、信息瓶颈理论

注意力机制的理论基础之一是信息瓶颈理论(Information Bottleneck Principle),它描述了有效信息传递过程中应尽可能压缩无关信息,同时保留与目标变量相关的最重要信息。注意力机制通过动态分配计算资源,聚焦于输入数据中与当前任务最相关的部分,实现对信息的有效筛选和压缩。

2.、前馈神经网络的局限性

传统前馈神经网络(如全连接网络)对输入序列的处理通常是线性的、固定权重的,难以捕捉长期依赖关系和非局部特征的重要性。注意力机制作为对这种局限性的补充,允许模型在处理序列数据时,根据上下文灵活调整对每个位置的重视程度,从而更好地捕获非线性和非局部信息。

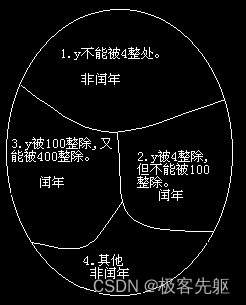

3、联合概率分布建模

在机器翻译等任务中,注意力机制被用来建模源语句与目标语句之间的联合概率分布。通过引入注意力得分,模型可以在生成目标词时动态地“聚焦”于源语句的不同部分,这有助于更准确地对齐源目标词汇,进而提升翻译质量。

二、Attention机制的核心架构

1、自注意力(Self-Attention)

注意力机制的核心架构主要围绕自注意力(Self-Attention)展开,它是Transformer模型中最关键的组成部分。自注意力允许一个序列中的每个元素(如单词、像素或时间步长的特征)不仅考虑自身的表示,还能直接与其序列中的所有其他元素进行交互,从而动态地捕获全局依赖关系。以下是自注意力机制的详细步骤:

第一步、查询、键、值的计算

对于输入序列 ( X = {x_1, x_2, …, x_n} ),其中 ( x_i ) 是第 ( i ) 个位置的向量表示,模型首先通过三个不同的线性变换(通常由可学习的权重矩阵实现)分别计算查询(Query)、键(Key)、值(Value)向量:

[ Q = XW_Q ]

[ K = XW_K ]

[ V = XW_V ]

其中,( W_Q, W_K, W_V ) 分别是查询、键、值的权重矩阵,它们将输入向量 ( x_i ) 映射到相应的查询向量 ( q_i )、键向量 ( k_i ) 和值向量 ( v_i )。这样,对于序列中的每个位置,我们得到了一组对应的查询、键、值三元组。

第二步、注意力分数计算

接下来,计算每个查询向量 ( q_i ) 与所有键向量 ( k_j ) 的匹配程度,形成注意力分数矩阵:

[ A = \text{softmax}\left(\frac{QK^T}{\sqrt{d_k}}\right) ]

其中,( d_k ) 是键向量的维度,通常取值为模型的一个超参数,分母中的 ( \sqrt{d_k} ) 是为了归一化分数,防止因向量维度过大导致的数值不稳定。矩阵乘法 ( QK^T ) 会产生一个 ( n \times n ) 的分数矩阵 ( A ),其中 ( A_{ij} ) 表示位置 ( i ) 对位置 ( j ) 的注意力分数。

第三步、注意力权重计算

对注意力分数矩阵 ( A ) 中的每一行(对应于一个查询向量)应用softmax函数进行归一化,得到注意力权重向量:

[ \alpha_i = \text{softmax}(A_i) ]

这里 ( \alpha_i ) 是一个归一化的注意力权重向量,其元素 ( \alpha_{ij} ) 表示在计算位置 ( i ) 的上下文向量时,对位置 ( j ) 的信息的重视程度。softmax函数确保了所有权重之和为1,使得权重分布成为一个有效的概率分布。

第四步、上下文向量计算

最后,使用注意力权重向量 ( \alpha_i ) 与对应的值向量集 ( V ) 进行加权求和,得到每个位置的上下文向量 ( c_i ):

[ c_i = \sum_{j=1}^{n} \alpha_{ij}v_j ]

上下文向量 ( c_i ) 融合了整个序列的信息,但权重 ( \alpha_{ij} ) 强调了对位置 ( j ) 的信息的使用程度。每个位置的上下文向量 ( c_i ) 就是该位置经过自注意力机制处理后的输出。

2、多头注意力(Multi-Head Attention)

为了捕捉输入序列的不同子空间特征和复杂关系,自注意力通常被扩展为多头注意力。每个“头”(head)独立执行一次自注意力计算,使用不同的线性变换参数(即不同的 ( W_Q, W_K, W_V )),从而从不同视角关注输入。具体来说:

- 对于每一个注意力头 ( h )(共 ( H ) 个头),分别计算查询、键、值向量:

[ Q_h = XW_{Q,h} ]

[ K_h = XW_{K,h} ]

[ V_h = XW_{V,h} ]

- 对每个头执行自注意力计算,得到 ( h ) 个不同的上下文向量集 ( C_h ):

[ C_h = \text{Attention}(Q_h, K_h, V_h) ]

- 将所有头的输出拼接(Concatenate)起来,并通过一个额外的线性层(称为合并层,有时带有残差连接和层归一化)整合成单一的输出向量:

[ Z = \text{Concat}(C_1, C_2, …, C_H)W_O ]

其中 ( W_O ) 是合并层的权重矩阵。

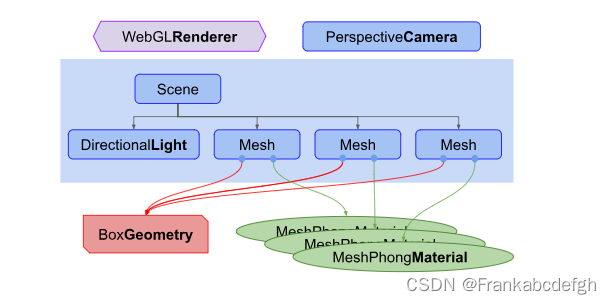

自注意力机制的核心架构通过查询-键-值三元组的计算、注意力分数的确定、注意力权重的归一化以及上下文向量的生成,实现了对输入序列中每个位置信息的动态关注。多头注意力则通过并行执行多个自注意力头,增强了模型捕捉多种依赖关系的能力。这些机制共同构成了现代Transformer模型中至关重要的注意力层,广泛应用于自然语言处理、计算机视觉、语音识别与合成等多种领域。

三、Attention机制应用领域

1、自然语言处理(NLP):

- 机器翻译(Machine Translation, MT):注意力机制显著提高了翻译系统的性能,特别是在长距离依赖和词汇对齐方面,如Google在2016年部署的基于神经网络的机器翻译系统,错误率降低了60%。

- 文本生成(Text Generation):如摘要生成、对话系统中,注意力机制帮助模型在生成每个词时聚焦于输入文本的相关部分。

- 问答(Question Answering, QA):在阅读理解任务中,注意力机制帮助模型定位文档中与问题最相关的信息片段。

- 命名实体识别(Named Entity Recognition, NER):注意力有助于捕捉上下文中对识别实体有关键影响的词语。

2、计算机视觉(Computer Vision, CV)

- 图像分类与识别:注意力机制可以引导模型关注图像中的关键区域,忽略无关背景噪声。

- 目标检测:通过注意力机制强化对感兴趣物体的特征提取。

- 图像生成:如在GANs中,注意力帮助生成器更好地聚焦于图像的不同部分,提升细节生成质量。

3、语音识别与合成

- 语音识别:注意力机制帮助模型在解码阶段动态对齐声学特征与文本序列,提高识别精度。

- 语音合成:在文本到语音(TTS)任务中,注意力确保模型在生成音频波形时能准确跟随文本输入。

4、其他领域

- 推荐系统:注意力机制用于用户行为序列建模,突出用户兴趣焦点。

- 生物信息学:在蛋白质结构预测、基因序列分析中,注意力有助于聚焦于决定性特征。

- 强化学习:注意力有助于智能体在复杂环境中选择关注的关键状态特征。

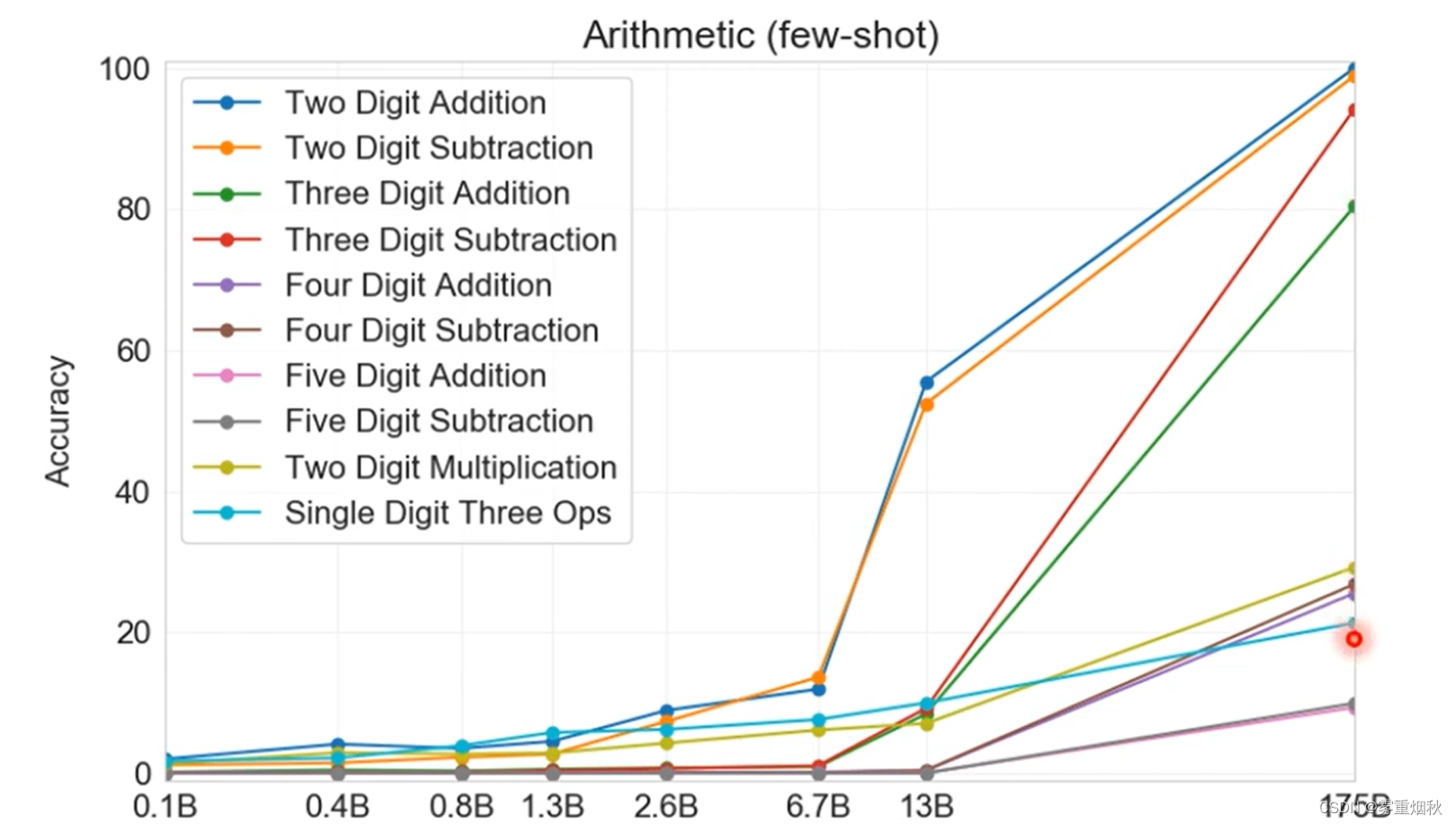

四、Attention机制最新研究动态

最新研究动态包括:Transformer-XL等模型探索更长历史依赖;BERT等预训练模型利用自注意力进行无监督学习;Reformer等引入稀疏注意力和局部敏感哈希降低计算复杂度;因果/非因果Attention在时间序列分析中的作用研究;跨模态Attention在图像-文本等多模态任务中的应用深化;以及对Attention可解释性和鲁棒性的持续探究。

1、Lightning Attention与TransNormerLLM

最近一支科研团队提出了新一代注意力机制“Lightning Attention”,并设计了新的网络架构TransNormerLLM(TNL)。据称,该机制在计算效率和效果上显著超越Transformer,已在大语言模型上得到验证。Lightning Attention可能通过创新的计算方法、优化的数据流动或更高效的内存使用等方式提升了性能。

2、注意力机制的多样化与集成

研究者持续探索多种互补的注意力机制,并尝试将其整合到单一网络中,以应对复杂任务。这些方法可能包括但不限于:软注意力、硬注意力、空间注意力、通道注意力、自回归注意力、因果注意力、跨模态注意力等,它们在特定任务或数据类型中展现出独特优势。

3、注意力机制的轻量化与加速

随着对实时性和硬件效率需求的增长,研究者致力于开发更轻量级、更快的注意力计算方法。这包括使用近似计算、稀疏注意力、局部注意力、二阶注意力、线性复杂度注意力等策略,以降低计算成本而不显著牺牲性能。

4、注意力机制的可解释性与公平性

随着对AI模型透明度和公平性的要求提高,注意力机制也被用于提升模型解释性,通过可视化注意力权重揭示模型决策过程。同时,研究也关注如何避免注意力偏见,确保模型在处理敏感数据时公平对待不同群体。

综上所述,注意力机制的理论基础植根于信息处理原则和神经网络的局限性克服,其核心架构围绕自注意力和多头注意力展开,广泛应用于NLP、CV、语音技术等领域,并在最新研究中展现出计算效率提升、机制多样性集成、轻量化加速以及可解释性与公平性追求等前沿趋势。