本文翻译整理自:Enhancing RAG-based application accuracy by constructing and leveraging knowledge graphs

https://blog.langchain.dev/enhancing-rag-based-applications-accuracy-by-constructing-and-leveraging-knowledge-graphs/

code : https://github.com/tomasonjo/blogs/blob/master/llm/enhancing_rag_with_graph.ipynb?ref=blog.langchain.dev

文章目录

- 一、使用 Neo4j 和 LangChain 在 RAG 应用程序中构建和检索知识图谱信息的实用指南

- 二、创建知识图谱

- Neo4j 环境设置

- 三、数据摄取

- 四、RAG 的混合检索

- 非结构化数据检索器

- 图检索器

- 最后的retriever

- 五、定义RAG链

- 六、总结

一、使用 Neo4j 和 LangChain 在 RAG 应用程序中构建和检索知识图谱信息的实用指南

编者注:以下是 Tomaz Bratanic 的博客文章,他专注于 Neo4j的 Graph ML 和 GenAI 研究。Neo4j 是一家图形数据库和分析公司,帮助组织深入、轻松、快速地发现数十亿数据连接中隐藏的关系和模式。

图检索增强生成(Graph RAG)正在蓬勃发展,并成为传统矢量搜索检索方法的强大补充。这种方法利用图数据库的结构化性质,将数据组织为节点和关系,以增强检索信息的深度和上下文。

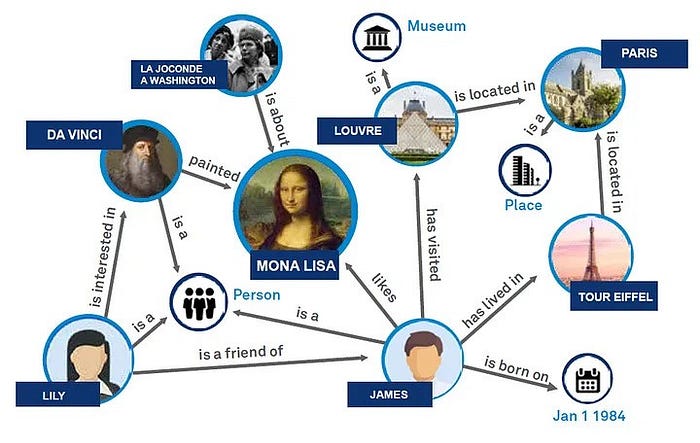

知识图示例。

图表非常擅长以结构化方式表示和存储异构且互连的信息,轻松捕获不同数据类型之间的复杂关系和属性。

相比之下,向量数据库通常难以处理此类结构化信息,因为它们的优势在于通过高维向量处理非结构化数据。在 RAG 应用程序中,您可以将结构化图形数据与通过非结构化文本进行矢量搜索相结合,以实现两全其美,这正是我们在本博文中要做的。

二、创建知识图谱

知识图很棒,但如何创建一个呢?

构建知识图通常是利用基于图的数据表示的力量中最具挑战性的步骤。它涉及收集和构建数据,这需要对域和图建模有深入的了解。为了简化这个过程,我们一直在尝试LLM。

LLM凭借对语言和上下文的深刻理解,可以自动化知识图谱创建过程的重要部分。通过分析文本数据,这些模型可以识别实体,理解它们之间的关系,并建议如何最好地在图形结构中表示它们。

作为这些实验的结果,我们在 LangChain 中添加了第一个版本的图构建模块,我们将在这篇博文中进行演示。

该代码可在 GitHub上获取。

Neo4j 环境设置

您需要按照本博客文章中的示例设置 Neo4j 实例。

最简单的方法是在Neo4j Aura上启动一个免费实例 ,它提供 Neo4j 数据库的云实例。

或者,您还可以通过下载Neo4j Desktop 应用程序并创建本地数据库实例来设置 Neo4j 数据库的本地实例 。

os.environ["OPENAI_API_KEY"] = "sk-"

os.environ["NEO4J_URI"] = "bolt://localhost:7687"

os.environ["NEO4J_USERNAME"] = "neo4j"

os.environ["NEO4J_PASSWORD"] = "password"

graph = Neo4jGraph()

此外,您必须提供 OpenAI 密钥,因为我们将在本博文中使用他们的模型。

三、数据摄取

在本演示中,我们将使用 伊丽莎白一世的 维基百科页面。我们可以利用 LangChain 加载器 无缝地从维基百科获取和分割文档。

# Read the wikipedia article

raw_documents = WikipediaLoader(query="Elizabeth I").load()

# Define chunking strategy

text_splitter = TokenTextSplitter(chunk_size=512, chunk_overlap=24)

documents = text_splitter.split_documents(raw_documents[:3])

现在是时候根据检索到的文档构建图表了。为此,我们实现了一个 LLMGraphTransformer模块,可以显着简化在图数据库中构建和存储知识图。

llm=ChatOpenAI(temperature=0, model_name="gpt-4-0125-preview")

llm_transformer = LLMGraphTransformer(llm=llm)

# Extract graph data

graph_documents = llm_transformer.convert_to_graph_documents(documents)

# Store to neo4j

graph.add_graph_documents(

graph_documents,

baseEntityLabel=True,

include_source=True

)

您可以定义知识图谱生成链使用哪个LLM。

目前,我们仅支持 OpenAI 和 Mistral 的函数调用模型。然而,我们计划在未来扩大LLM的选择范围。在此示例中,我们使用最新的 GPT-4。

请注意,生成的图表的质量很大程度上取决于您使用的模型。从理论上讲,你总是想使用最有能力的。

LLM 图形转换器返回图形文档,可以通过该 add_graph_documents 方法将其导入 Neo4j。

该 baseEntityLabel 参数 __Entity__ 为每个节点分配一个附加标签,从而增强索引和查询性能。

该 include_source 参数将节点链接到其原始文档,从而促进数据可追溯性和上下文理解。

您可以在 Neo4j 浏览器中检查生成的图表。

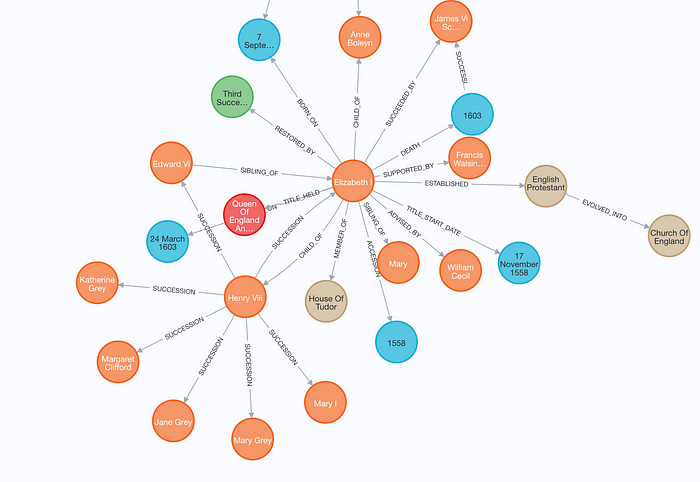

生成的图表的一部分

请注意,为了清楚起见,该图像仅代表生成的图表的一部分。

四、RAG 的混合检索

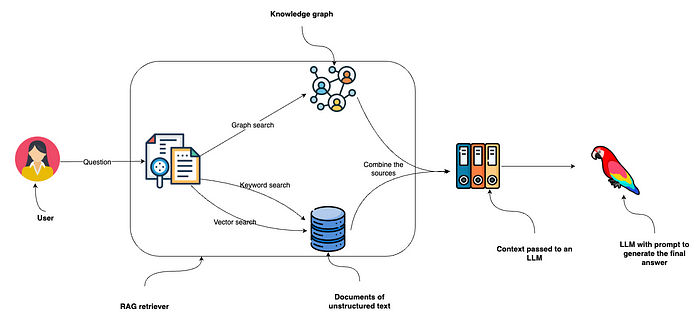

图生成后,我们将使用混合检索方法,将向量和关键字索引与 RAG 应用程序的图检索相结合。

结合混合(向量+关键字)和图检索方法。图片由作者提供。

该图说明了检索过程,从用户提出问题开始,然后将问题定向到 RAG 检索器。

该检索器采用关键字和向量搜索来搜索非结构化文本数据,并将其与从知识图谱中收集的信息相结合。

由于 Neo4j 同时具有关键字索引和向量索引,因此您可以使用单个数据库系统实现所有三个检索选项。从这些来源收集的数据将输入LLM以生成并提供最终答案。

非结构化数据检索器

您可以使用该 Neo4jVector.from_existing_graph 方法将关键字和向量检索添加到文档中。

此方法为混合搜索方法配置关键字和向量搜索索引,以标记为 的节点为目标 Document。

此外,如果文本嵌入值缺失,它还会计算它们。

vector_index = Neo4jVector.from_existing_graph(

OpenAIEmbeddings(),

search_type="hybrid",

node_label="Document",

text_node_properties=["text"],

embedding_node_property="embedding"

)

然后可以用该方法调用向量索引 similarity_search 。

图检索器

另一方面,配置图检索更加复杂,但提供了更多自由。

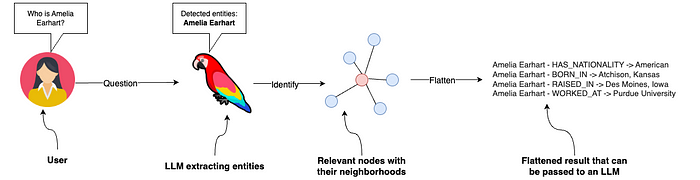

在这个例子中,我们将使用全文索引来识别相关节点,然后返回它们的直接邻居。

图形检索器。图片由作者提供。

图形检索器。图片由作者提供。

图检索器首先识别输入中的相关实体。为简单起见,我们指示 LLM 识别人员、组织和位置。为此,我们将使用 LCEL 和新添加的方法 with_structured_output 来实现这一点。

# Extract entities from text

class Entities(BaseModel):

"""Identifying information about entities."""

names: List[str] = Field(

...,

description="All the person, organization, or business entities

that " "appear in the text",

)

prompt = ChatPromptTemplate.from_messages(

[

(

"system",

"You are extracting organization and person entities from the

text.",

),

(

"human",

"Use the given format to extract information from the

following"

"input: {question}",

),

]

)

entity_chain = prompt | llm.with_structured_output(Entities)

让我们测试一下:

entity_chain.invoke({"question": "Where was Amelia Earhart born?"}).names

# ['Amelia Earhart']

太好了,现在我们可以检测问题中的实体,让我们使用全文索引将它们映射到知识图谱。首先,我们需要定义一个全文索引和一个函数,该函数将生成允许一些拼写错误的全文查询,这里我们不会详细介绍。

graph.query(

"CREATE FULLTEXT INDEX entity IF NOT EXISTS FOR (e:__Entity__) ON EACH [e.id]")

def generate_full_text_query(input: str) -> str:

"""

Generate a full-text search query for a given input string.

This function constructs a query string suitable for a full-text

search. It processes the input string by splitting it into words and

appending a similarity threshold (~2 changed characters) to each

word, then combines them using the AND operator. Useful for mapping

entities from user questions to database values, and allows for some

misspelings.

"""

full_text_query = ""

words = [el for el in remove_lucene_chars(input).split() if el]

for word in words[:-1]:

full_text_query += f" {word}~2 AND"

full_text_query += f" {words[-1]}~2"

return full_text_query.strip()

现在让我们把它们放在一起。

# Fulltext index query

def structured_retriever(question: str) -> str:

"""

Collects the neighborhood of entities mentioned

in the question

"""

result = ""

entities = entity_chain.invoke({"question": question})

for entity in entities.names:

response = graph.query(

"""CALL db.index.fulltext.queryNodes('entity', $query,

{limit:2})

YIELD node,score

CALL {

MATCH (node)-[r:!MENTIONS]->(neighbor)

RETURN node.id + ' - ' + type(r) + ' -> ' + neighbor.id AS

output

UNION

MATCH (node)<-[r:!MENTIONS]-(neighbor)

RETURN neighbor.id + ' - ' + type(r) + ' -> ' + node.id AS

output

}

RETURN output LIMIT 50

""",

{"query": generate_full_text_query(entity)},

)

result += "\n".join([el['output'] for el in response])

return result

该 structured_retriever 函数首先检测用户问题中的实体。接下来,它迭代检测到的实体并使用 Cypher 模板来检索相关节点的邻域。我们来测试一下吧!

print(structured_retriever("Who is Elizabeth I?"))

# Elizabeth I - BORN_ON -> 7 September 1533

# Elizabeth I - DIED_ON -> 24 March 1603

# Elizabeth I - TITLE_HELD_FROM -> Queen Of England And Ireland

# Elizabeth I - TITLE_HELD_UNTIL -> 17 November 1558

# Elizabeth I - MEMBER_OF -> House Of Tudor

# Elizabeth I - CHILD_OF -> Henry Viii

# and more...

最后的retriever

正如我们在开始时提到的,我们将结合非结构化和图形检索器来创建将传递给 LLM 的最终上下文。

def retriever(question: str):

print(f"Search query: {question}")

structured_data = structured_retriever(question)

unstructured_data = [el.page_content for el in vector_index.similarity_search(question)]

final_data = f"""Structured data:

{structured_data}

Unstructured data:

{"#Document ". join(unstructured_data)}

"""

return final_data

当我们处理 Python 时,我们可以使用 f 字符串简单地连接输出。

五、定义RAG链

我们已经成功实现了 RAG 的检索组件。接下来,我们将引入一个提示,利用集成混合检索器提供的上下文来生成响应,从而完成 RAG 链的实现。

template = """Answer the question based only on the following context:

{context}

Question: {question}

"""

prompt = ChatPromptTemplate.from_template(template)

chain = (

RunnableParallel(

{

"context": _search_query | retriever,

"question": RunnablePassthrough(),

}

)

| prompt

| llm

| StrOutputParser()

)

最后,我们可以继续测试我们的混合 RAG 实施。

chain.invoke({"question": "Which house did Elizabeth I belong to?"})

# Search query: Which house did Elizabeth I belong to?

# 'Elizabeth I belonged to the House of Tudor.'

我还集成了查询重写功能,使 RAG 链能够适应允许后续问题的对话设置。鉴于我们使用向量和关键字搜索方法,我们必须重写后续问题以优化我们的搜索过程。

chain.invoke(

{

"question": "When was she born?",

"chat_history": [("Which house did Elizabeth I belong to?",

"House Of Tudor")],

}

)

# Search query: When was Elizabeth I born?

# 'Elizabeth I was born on 7 September 1533.'

您可以观察到它 When was she born? 首先被重写为 When was Elizabeth I born? .然后使用重写的查询来检索相关上下文并回答问题。

六、总结

随着 的引入 LLMGraphTransformer,生成知识图的过程现在应该更加流畅且更容易访问,让任何希望利用知识图提供的深度和上下文来增强基于 RAG 的应用程序的人变得更加容易。这只是一个开始,我们计划了很多改进。

如果您对我们与LLM生成图表有任何见解、建议或疑问,请随时与我们联系。

该代码可在 GitHub上获取。

2024-05-22(三)