目录

引言

一、DNN基本原理

二、DNN核心算法原理

三、DNN具体操作步骤

四、代码演示

引言

在人工智能和机器学习的浪潮中,深度神经网络(Deep Neural Network,简称DNN)已经成为了一种非常重要的工具。DNN模仿人脑神经网络的结构和工作原理,通过层级化的特征学习和权重调节,可以实现复杂任务的高性能解决方案。本文将深入探讨DNN的基本原理、核心算法以及具体操作步骤,并通过代码演示其实现过程。

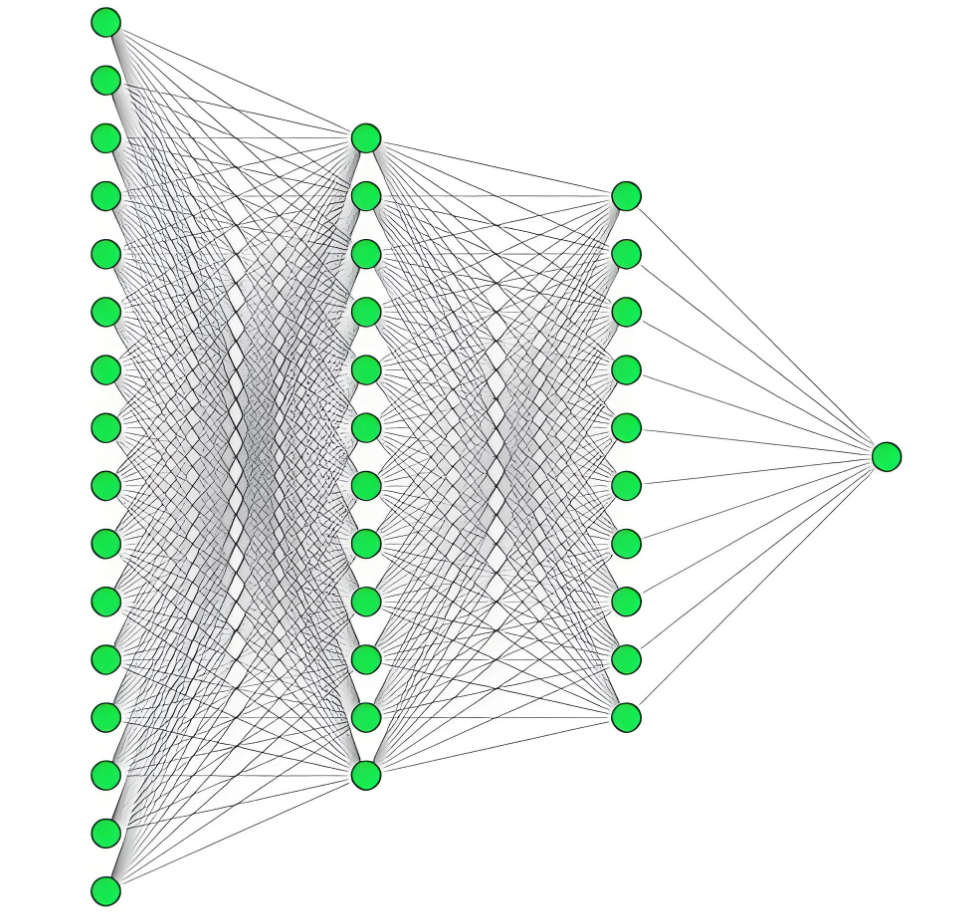

一、DNN基本原理

深度神经网络是一种由多个神经元层组成的机器学习模型。每个神经元层接收上一层的输出作为输入,并通过一系列非线性变换和权重调节来计算输出。DNN通过反向传播算法进行训练,即通过计算预测输出与真实输出之间的误差,并使用梯度下降法更新网络中的权重和偏置值,直到网络达到预定的性能水平。

二、DNN核心算法原理

- 前向传播:在前向传播过程中,数据从输入层开始,逐层向输出层传递。每一层的神经元都会根据上一层的输出和本层的权重、偏置进行计算,得到本层的输出。

- 反向传播:在反向传播过程中,首先计算网络的预测输出与真实输出之间的误差,然后将这个误差逐层反向传播回去,同时更新每一层的权重和偏置。这是DNN训练的关键步骤。

- 优化算法:在反向传播过程中,需要使用优化算法来更新权重和偏置。常用的优化算法有随机梯度下降(SGD)、动量(Momentum)、Adam等。

三、DNN具体操作步骤

- 数据准备:首先需要准备训练数据和测试数据。训练数据用于训练DNN模型,测试数据用于评估模型的性能。

- 模型构建:根据任务需求,构建合适的DNN模型。包括确定网络层数、每层的神经元数量、激活函数等。

- 模型训练:使用训练数据对DNN模型进行训练。通过前向传播和反向传播不断更新网络的权重和偏置,直到达到预定的训练轮数或者满足其他停止条件。

- 模型评估:使用测试数据对训练好的DNN模型进行评估。常用的评估指标有准确率、召回率、F1值等。

- 模型优化:根据评估结果对模型进行优化,如调整网络结构、增加训练数据、改变学习率等。

- 模型应用:将优化后的DNN模型应用于实际问题中,如图像识别、自然语言处理、语音识别等。

四、代码演示

下面是一个简单的DNN分类模型的代码演示,使用Python和PaddlePaddle框架实现:

import paddle

from paddle import nn, optimizer, tensor

# 定义DNN模型

class MyDNN(nn.Layer):

def __init__(self):

super(MyDNN, self).__init__()

self.fc1 = nn.Linear(784, 256) # 输入层到隐藏层1

self.fc2 = nn.Linear(256, 128) # 隐藏层1到隐藏层2

self.fc3 = nn.Linear(128, 10) # 隐藏层2到输出层

def forward(self, x):

x = paddle.tanh(self.fc1(x)) # 隐藏层1使用tanh激活函数

x = paddle.tanh(self.fc2(x)) # 隐藏层2使用tanh激活函数

x = self.fc3(x) # 输出层不使用激活函数,直接输出预测结果

return x

# 加载数据、构建模型、定义损失函数和优化器(略)

# ...

# 训练模型

for epoch in range(epochs):

for batch_id, data in enumerate(train_loader()):

# 获取数据并转换为Paddle Tensor格式(略)

# ...

# 前向传播

logits = model(x)

# 计算损失函数值

loss = criterion(logits, y)

# 反向传播并更新权重和偏置值(略)

# ...

# 打印训练信息(略)

# ...以上代码仅为演示目的,实际使用时需要根据具体任务和数据集进行相应的调整。另外,为了简化演示过程,代码中省略了部分实现细节。在实际应用中,还需要考虑如何加载数据、如何定义合适的损失函数和优化器等问题。同时,为了提高模型的泛化能力,还可以使用正则化、批量归一化等技巧对模型进行优化。此外,还可以使用交叉验证、早停等技术来防止过拟合现象的发生。最后,在实际应用中还需要对模型进行充分的测试和评估以确保其性能达到预期要求。

![[Linux] 入门指令详解](https://img-blog.csdnimg.cn/direct/24569670f013441baa98e8b30ca28d54.png)

![[Linux][网络][高级IO][一][五种IO模型][同步通信][异步通信][非阻塞IO]详细讲解](https://img-blog.csdnimg.cn/direct/66743b19cad84cddbc14379db2873fef.png)