目录

特征降维概念

低方差过滤法

PCA主成分分析

相关系数法

小结

特征降维概念

特征对训练模型时非常重要的;用于训练的数据集包含一些不重要的特征,可能导致模型性能不好、泛化性能不佳;例如:

- 某些特征的取值较为接近,其包含的信息较少

- 希望特征独立存在对预测产生影响,两个特征同增同减非常相关,也会干扰模型的学习

特征降维是指在某些限定条件下,降低特征个数常用的方法:

低方差过滤法、PCA(主成分分析)降维法、相关系数(皮尔逊相关系数、斯皮尔曼相关系数)

低方差过滤法

低方差过滤法:指的是删除方差低于某些阈值的一些特征

- 特征方差小:特征值的波动范围小,包含的信息少,模型很难学习到数据的规律

- 特征方差大:特征值的波动范围大,包含的信息相对丰富,便于模型学习事物规律(异常值除外)

机器学习低方差过滤API:

- sklearn.feature_selection.VarianceThreshold(threshold = 0.0) 实例化对象用于删除所有低方差特征

- variance_obj.fit_transform(X) X:numpy array格式的数据[n_samples,n_features]

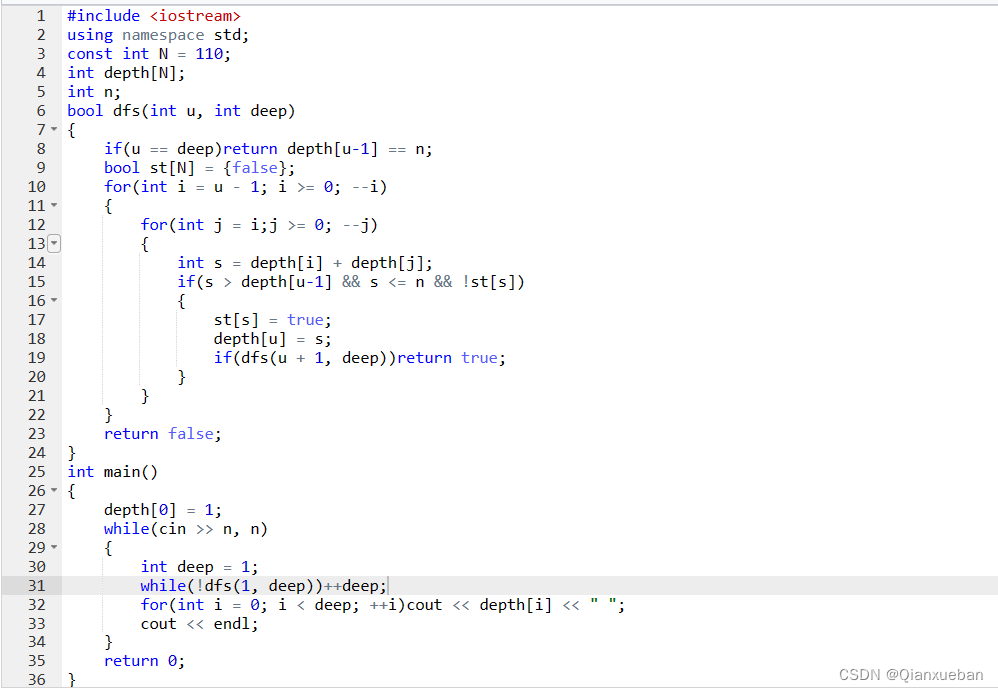

import numpy as np

import pandas as pd

from sklearn.feature_selection import VarianceThreshold

np.set_printoptions(suppress=True)

pd.set_option('display.float_format', lambda x: '%.4f' % x)

def dm01_VarianceThreshold():

mydata = pd.read_csv('./data/factor_returns.csv')

print('mydata-->\n', mydata.columns)

print('mydata-->\n', mydata.shape)

transfer = VarianceThreshold(threshold=0.2)

mydata = transfer.fit_transform(mydata.iloc[:, 1:10]) # /0123456

print(mydata.shape)

print(mydata)- 效果:(200,11) 降到了(200,8)

PCA主成分分析

主成分分析(Principal Component Analysis,PCA)

PCA 通过对数据维数进行压缩,尽可能降低原数据的维数(复杂度)损失少量信息,在此过程中可能会舍弃原有数据、创造新的变量。

通过正交变换将一组可能存在相关性的变量转换为一组线性不相关的变量,转换后的这组变

量叫主成分。

- sklearn.decomposition.PCA(n_components=None) 将数据分解为较低维数空间

- n_components: 小数表示保留百分之多少的信息;整数表示减少到多少特征 例如:由20个特征减少到10个

- 返回值:转换后指定维度的array

非主要成分的数据不是被删除,而是被压缩,在空间几何中被称为投影

from sklearn.decomposition import PCA

def dm02_PCA():

data = [[2, 8, 4, 5],

[6, 3, 0, 8],

[5, 4, 9, 1]]

transfer = PCA(n_components=0.9)

data1 = transfer.fit_transform(data)

print(data1, data1.shape)

transfer2 = PCA(n_components=3)

data2 = transfer2.fit_transform(data)

print(data2, data2.shape)- 主成分分析变换后,数据会发生变化

相关系数法

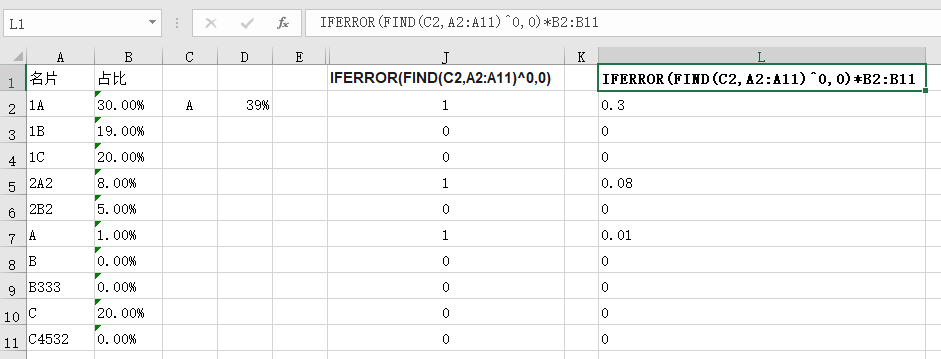

相关系数:反映特征列之间(变量之间)密切相关程度的统计指标。

特征x和目标值y的密切程度,是否同增同减;特征x和特征x之间是否同增同减;

可以把密切相关的2个列,删除掉1列,达到特征降维的效果

- 常见2个相关系数:皮尔逊相关系数、斯皮尔曼相关系数

皮尔逊相关系数

- 反映变量之间相关关系密切程度的统计指标

相关系数的值介于–1与+1之间,当 r>0 时,表示两变量正相关,r<0 时,两变量为负相关,当 |r|=1 时,表示两变量为完全相关,当r=0时,表示两变量间无相关关系。

|r|<0.4为低度相关;0.4≤|r|<0.7为显著性相关;0.7≤|r|<1为高度线性相关

- from scipy.stats import pearsonr

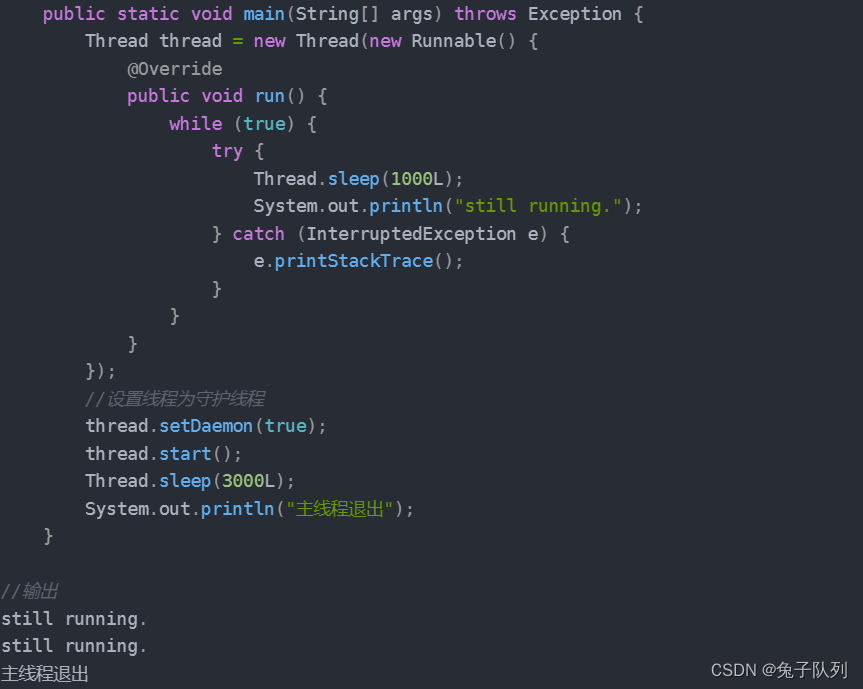

from scipy.stats import pearsonr

def dm03_pearsonr():

x1 = [12.5, 15.3, 23.2, 26.4, 33.5, 34.4, 39.4, 45.2, 55.4, 60.9]

x2 = [21.2, 23.9, 32.9, 34.1, 42.5, 43.2, 49.0, 52.8, 59.4, 63.5]

print('pearsonr(x1, x2)-->', pearsonr(x1, x2))相关系数斯皮尔曼

from scipy.stats import spearmanr

def dm04_spearmanr():

x1 = [12.5, 15.3, 23.2, 26.4, 33.5, 34.4, 39.4, 45.2, 55.4, 60.9]

x2 = [21.2, 23.9, 32.9, 34.1, 42.5, 43.2, 49.0, 52.8, 59.4, 63.5]

print('spearmanr(x1, x2)-->', spearmanr(x1, x2))斯皮尔曼相关系数与之前的皮尔逊相关系数大小性质一样,取值 [-1, 1]之间,斯皮尔曼相关系数比皮尔逊相关系数应用更加广泛。

小结

- 低方差过滤法:按照阈值,把方差比较小的某一列进行剔除,sklearn.feature_selection.VarianceThreshold

- PCA主成分分析:数据压缩,高维数据转换为低维数据,然后产生了新的变量,sklearn.decomposition.PCA

- 皮尔逊相关系数:|r|<0.4为低度相关;0.4≤|r|<0.7为显著性相关;0.7≤|r|<1为高度线性相关,from scipy.stats import pearsonr

- 斯皮尔曼相关系数:通过等级差进行计算,计算相对简单,使用更广,from scipy.stats import spearmanr

![[AIGC] redis 持久化相关的几道面试题](https://img-blog.csdnimg.cn/img_convert/1f84b9f7f26d9ed12b8171a4dd84ada8.png)