构建一个使用Llama-Index、Llama 3和Qdrant的高级重排-RAG系统

尽管大型语言模型(LLMs)有能力生成有意义且语法正确的文本,但它们面临的一个挑战是幻觉。

在LLMs中,幻觉指的是它们倾向于自信地生成错误答案,制造出看似令人信服的虚假信息。这个问题自LLMs问世以来就普遍存在,并经常导致不准确和事实错误的输出。

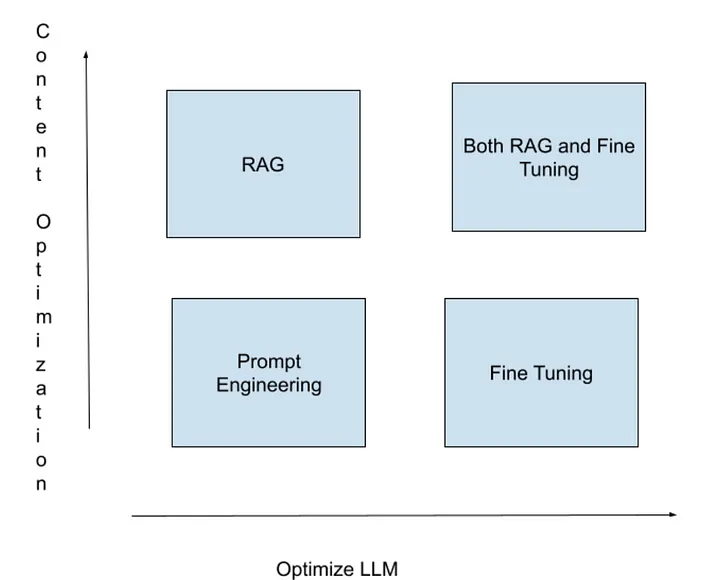

为了解决幻觉问题,事实检查至关重要。一种用于为LLMs原型设计进行事实检查的方法包括三种方法:

- 提示工程

- 检索增强生成(RAG)

- 微调

在这种情况下,我们将利用RAG(检索增强生成)来缓解幻觉。

技术交流

技术要学会分享、交流,不建议闭门造车。一个人可以走的很快、一堆人可以走的更远。

成立了大模型面试和技术交流群,相关源码、资料、技术交流&答疑,均可加我们的交流群获取,群友已超过2000人,添加时最好的备注方式为:来源+兴趣方向,方便找到志同道合的朋友。

方式①、微信搜索公众号:机器学习社区,后台回复:加群

方式②、添加微信号:mlc2040,备注:来自CSDN + 技术交流

什么是 RAG?

RAG = 密集向量检索(R)+上下文学习(AG)

检索:为您的文档中提出的问题查找参考资料。

增强:将参考资料添加到您的提示中。

生成:改进对所提出的问题的回答。

在RAG中,我们通过将文本文档或文档片段的集合编码为称为向量嵌入的数值表示来处理它们。每个向量嵌入对应于一个单独的文档片段,并存储在一个称为向量存储的数据库中。负责将这些片段编码为嵌入的模型称为编码模型或双编码器。这些模型在广泛的数据集上进行了训练,使它们能够为文档片段创建强大的表示形式,即单个向量嵌入。为了避免幻觉,RAG利用了与LLMs的推理能力分开保存的事实知识源。这些知识是外部存储的,可以轻松访问和更新。

有两种类型的知识源:

- 参数化知识:这种知识是在训练过程中获得的,并且隐含地存储在神经网络的权重中。

- 非参数化知识:这种类型的知识存储在外部源中,例如向量数据库。

为什么要在微调之前使用RAG?

- 便宜:无需额外的训练。

- 更容易更新最新信息。

- 更可信赖,因为有事实可核查的参考资料。

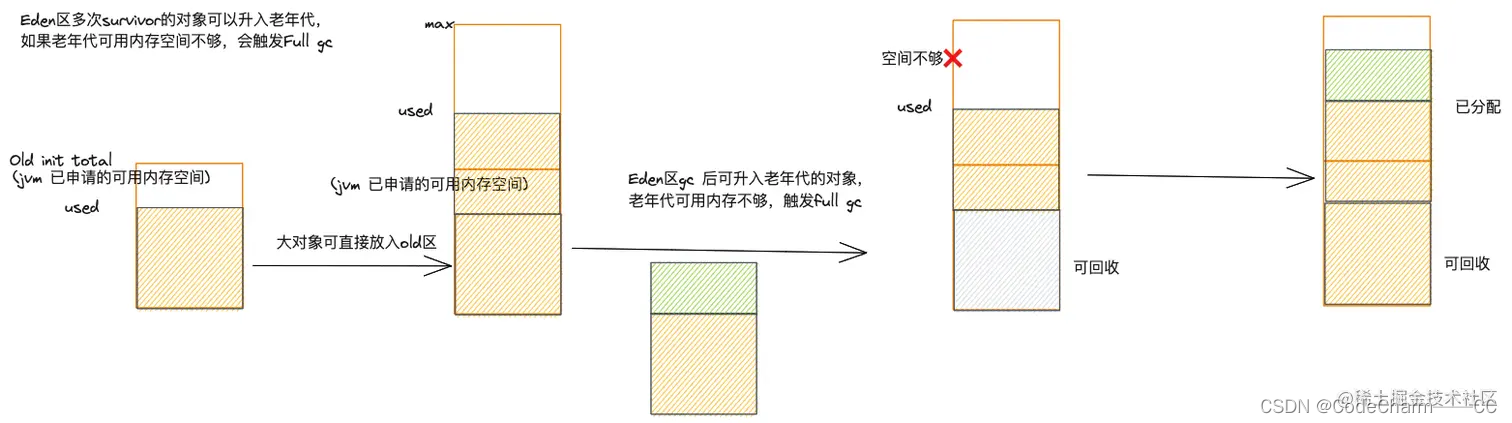

优化工作流程总结了基于以下两个因素可以使用的方法:

内容优化:模型需要知道什么。

LLM优化:模型需要如何行动。

RAG 数据堆栈

📁 加载语言数据

� 处理语言数据

🤖 嵌入语言数据

🗂 将向量加载到数据库中

RAG 涉及的阶段

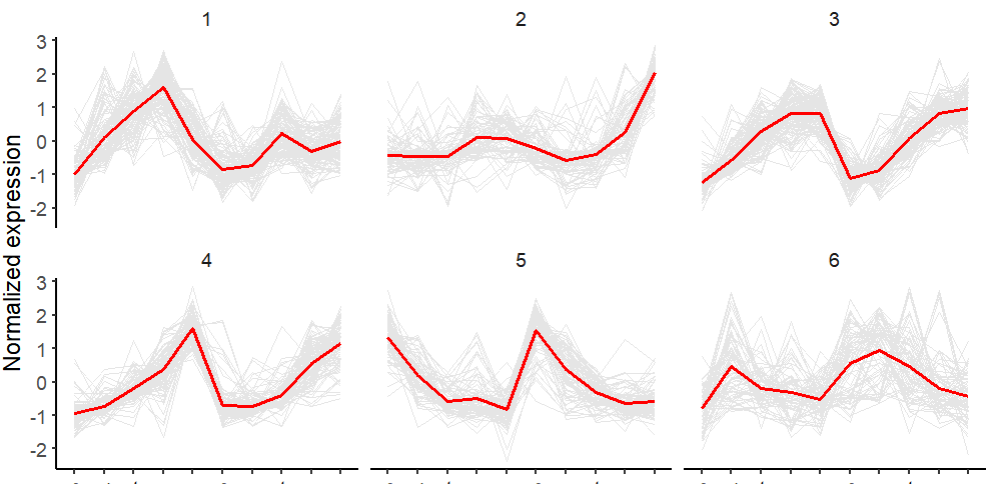

RAG涉及的阶段包括:

-

数据加载:这涉及从各种来源(如文本文件、PDF、网站、数据库或API)检索数据,并将其集成到您的管道中。Llama Hub提供了各种连接器来实现此目的。

-

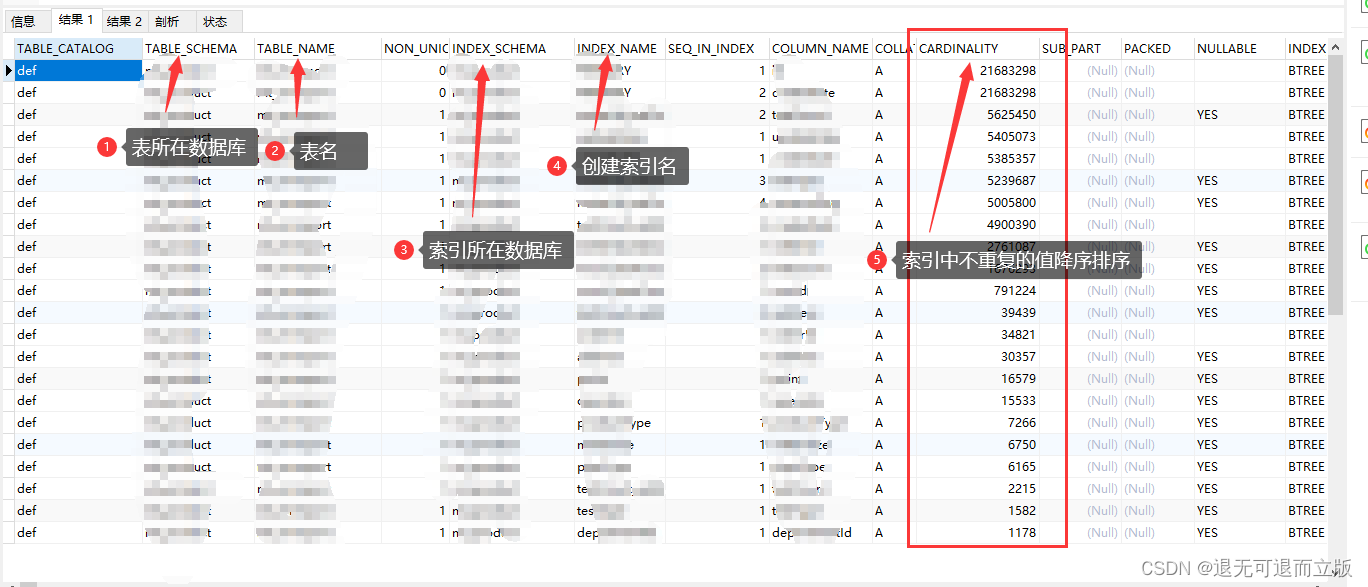

索引:这个阶段侧重于为数据查询创建结构化格式。对于LLMs,索引通常涉及生成向量嵌入,这是数据含义的数值表示,以及其他元数据策略,以便促进准确和上下文相关的数据检索。

-

存储:在索引之后,通常的做法是存储索引和相关元数据,以避免将来需要重复索引。

-

查询:有多种方法可以利用LLMs和Llama-Index数据结构进行查询,包括子查询、多步查询和混合策略,具体取决于所选择的索引策略。

-

评估:这一步对于评估管道的有效性以比较替代策略或在实施更改时至关重要。评估提供了关于查询响应的准确性、保真度和速度的客观指标。

我们的 RAG 堆栈是使用Llama-Index、Qdrant和Llama 3构建的。

什么是 Llama-Index?

Llama-Index作为一个旨在为带有上下文丰富的LLM应用程序开发的框架。上下文增强涉及将LLMs与您的私有或领域特定数据结合使用。

该框架的一些流行应用包括:

- 问答聊天机器人(通常称为RAG系统,简称“检索增强生成”)

- 文档理解和提取

- 能够进行研究和采取行动的自治代理

Llama-Index提供了一套全面的工具,以促进这些应用程序的开发,从初始原型到生产就绪的解决方案。这些工具使数据摄取和处理成为可能,同时实现了与基于LLM的提示结合的复杂查询工作流的实施。

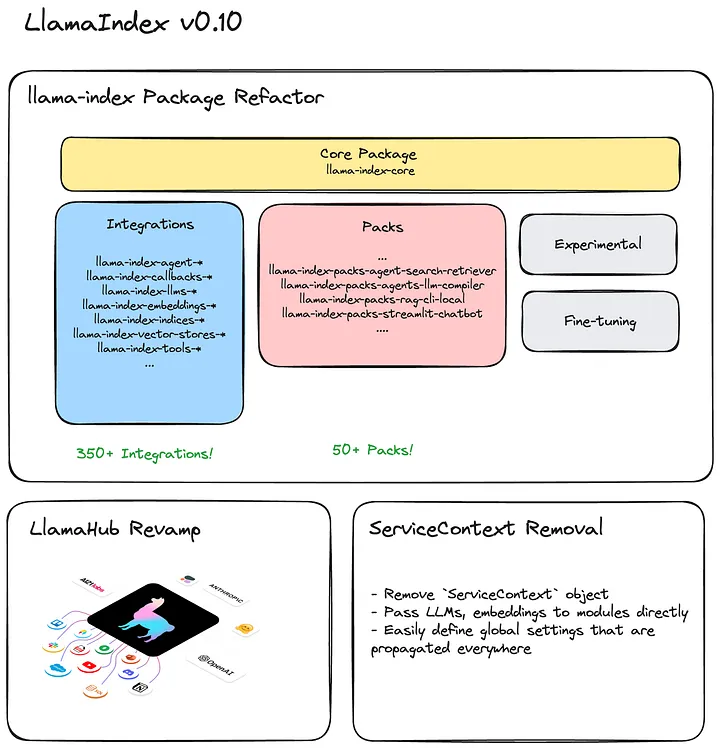

在这里,我们使用了 llama-index >= v0.10。

主要增强

ServiceContext已被弃用:每个LlamaIndex用户都熟悉ServiceContext,它逐渐变得过时且繁琐,用于管理LLMs、嵌入、块大小、回调以及其他功能。因此,我们完全将其弃用;现在您可以直接指定参数或设置默认值。

重新设计的文件夹结构:

- llama-index-core:此文件夹包含所有核心Llama-Index抽象。

- llama-index-integrations:该文件夹包括19个Llama-Index抽象的第三方集成,涵盖了数据加载器、LLMs、嵌入模型、向量存储等。

- llama-index-packs:在这里,您将找到我们的50多个LlamaPacks集合,这些模板旨在启动用户的应用程序。

LlamaHub将成为所有集成的中央枢纽。

Llama 3

Meta的Llama 3是开放访问的Llama系列的最新版本,可以通过Hugging Face访问。

它作为响应合成的语言模型。Llama 3有两种尺寸可供选择:8B适用于在消费级GPU上进行精简部署和开发,70B适用于广泛的AI应用。每种尺寸变体都提供基础版本和指令调整版本。

此外,一种在Llama 3 8B上进行微调的新版本Llama Guard已被引入为Llama Guard 2。

什么是 Qdrant?

Qdrant是一个向量相似度搜索引擎,通过易于使用的API提供了一个生产就绪的服务。它专门用于存储、搜索和管理点(向量)以及附加负载信息。

它经过优化,可以高效地存储和查询高维向量。像 Qdrant 这样的向量数据库利用了专门的数据结构和索引技术,例如用于实现近似最近邻居和产品量化等技术的分层可导航小世界(HNSW)。

这些优化使得快速相似度和语义搜索成为可能,允许用户根据指定的距离度量找到与给定查询向量最接近的向量。Qdrant支持的常用距离度量包括欧几里得距离、余弦相似度和点积。

使用的技术栈

- 应用程序框架:Llama-index

- 嵌入模型:BAAI/bge-small-en-v1.5

- LLM:Meta-Llama-3

- 向量存储:Qdrant

代码实现

安装所需库

%%writefile requirements.txt

llama-index

llama-index-llms-huggingface

llama-index-embeddings-fastembed

fastembed

Unstructured[md]

qdrant

llama-index-vector-stores-qdrant

einops

accelerate

sentence-transformers

#

!pip install -r requirements.txt

accelerate==0.29.3

einops==0.7.0

sentence-transformers==2.7.0

transformers==4.39.3

qdrant-client==1.9.0

llama-index==0.10.32

llama-index-agent-openai==0.2.3

llama-index-cli==0.1.12

llama-index-core==0.10.32

llama-index-embeddings-fastembed==0.1.4

llama-index-legacy==0.9.48

llama-index-llms-huggingface==0.1.4

llama-index-vector-stores-qdrant==0.2.8

下载数据集

!mkdir Data

!wget "https://arxiv.org/pdf/1810.04805.pdf" -O Data/arxiv.pdf

加载文档

from llama_index.core import SimpleDirectoryReader

documents = SimpleDirectoryReader("/content/Data").load_data()

实例化嵌入模型

from llama_index.embeddings.fastembed import FastEmbedEmbedding

from llama_index.core import Settings

embed_model = FastEmbedEmbedding(model_name="BAAI/bge-small-en-v1.5")

Settings.embed_model = embed_model

Settings.chunk_size = 512

定义系统提示

from llama_index.core import PromptTemplate

system_prompt = "You are a Q&A assistant. Your goal is to answer questions as accurately as possible based on the instructions and context provided."

# This will wrap the default prompts that are internal to llama-index

query_wrapper_prompt = PromptTemplate("{query_str}")

实例化LLM

由于我们使用Llama 3作为LLM,我们需要执行以下操作:

- 生成HuggingFace访问令牌

- 请求使用该模型的访问权限

from huggingface_hub import notebook_login

notebook_login()

import torch

from transformers import AutoModelForCausalLM, AutoTokenizer

from llama_index.llms.huggingface import HuggingFaceLLM

tokenizer = AutoTokenizer.from_pretrained("meta-llama/Meta-Llama-3-8B-Instruct")

stopping_ids = [

tokenizer.eos_token_id,

tokenizer.convert_tokens_to_ids(""),

]

llm = HuggingFaceLLM(

context_window=8192,

max_new_tokens=256,

generate_kwargs={"temperature": 0.7, "do_sample": False},

system_prompt=system_prompt,

query_wrapper_prompt=query_wrapper_prompt,

tokenizer_name="meta-llama/Meta-Llama-3-8B-Instruct",

model_name="meta-llama/Meta-Llama-3-8B-Instruct",

device_map="auto",

stopping_ids=stopping_ids,

tokenizer_kwargs={"max_length": 4096},

# uncomment this if using CUDA to reduce memory usage

# model_kwargs={"torch_dtype": torch.float16}

)

Settings.llm = llm

Settings.chunk_size = 512

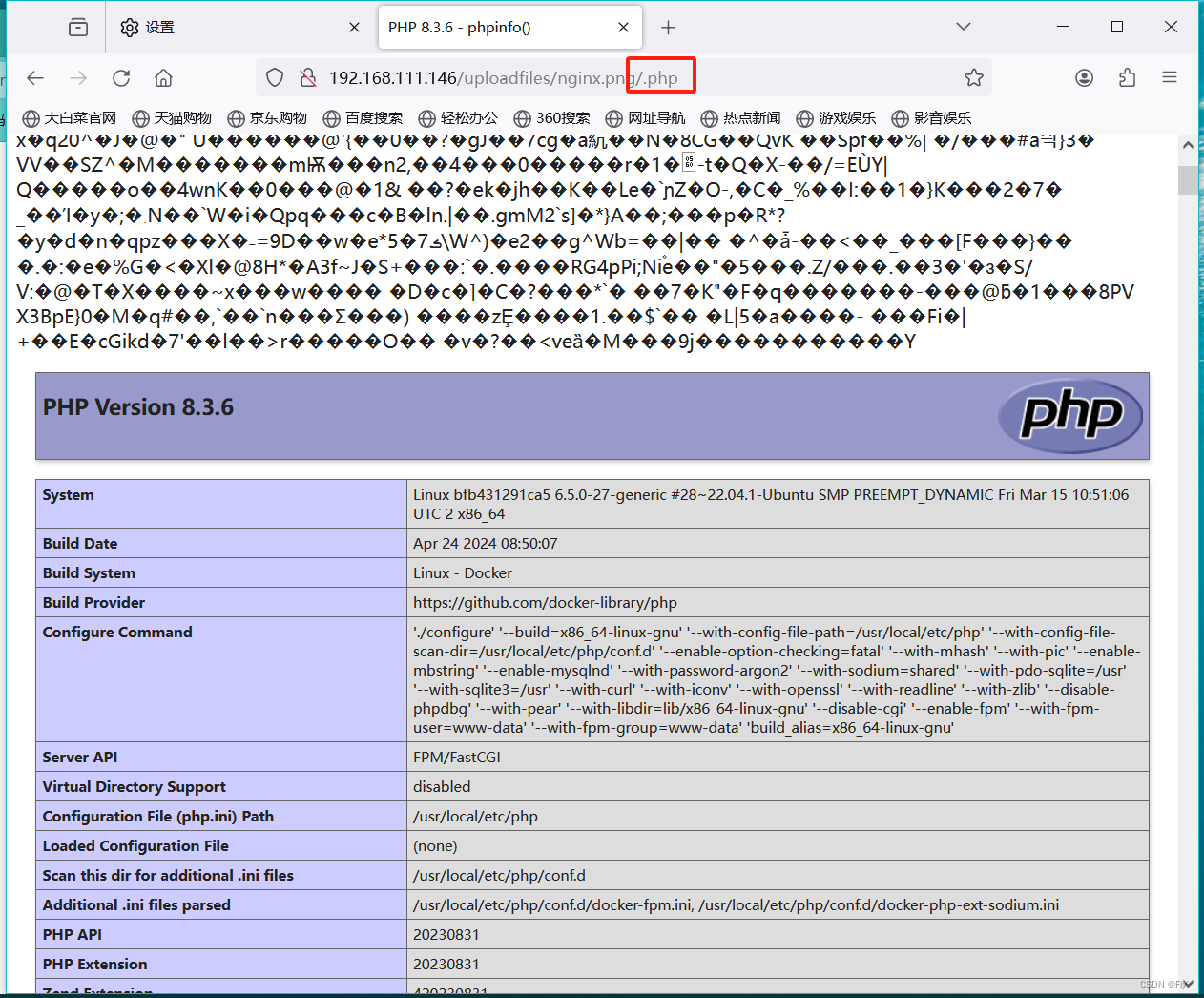

实例化向量存储并加载向量嵌入

from IPython.display import Markdown, display

from llama_index.core import VectorStoreIndex

from llama_index.core import StorageContext

from llama_index.vector_stores.qdrant import QdrantVectorStore

client = qdrant_client.QdrantClient(

# you can use :memory: mode for fast and light-weight experiments,

# it does not require to have Qdrant deployed anywhere

# but requires qdrant-client >= 1.1.1

location=":memory:"

# otherwise set Qdrant instance address with:

# url="http://<host>:<port>"

# otherwise set Qdrant instance with host and port:

# host="localhost",

# port=6333

# set API KEY for Qdrant Cloud

# api_key=<YOUR API KEY>

)

vector_store = QdrantVectorStore(client=client, collection_name="test")

storage_context = StorageContext.from_defaults(vector_store=vector_store)

index = VectorStoreIndex.from_documents(documents, storage_context=storage_context)

实例化重排序模块

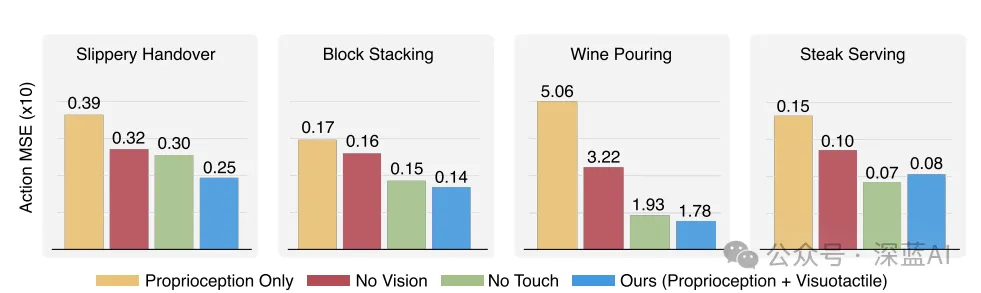

检索模型根据查询的嵌入相似性检索前k个文档。埌用嵌入进行检索有许多好处:

- 它非常高效,特别是在计算点积时,因为在查询时不需要进行任何模型调用。

- 尽管不是完美的,但嵌入可以充分编码文档和查询的语义。这导致嵌入式检索提供高度相关结果的查询子集。

然而,尽管具有这些优点,基于嵌入的检索有时可能不太准确,并返回与查询无关的上下文。这反过来降低了RAG系统的整体质量,而不论LLM的质量如何。

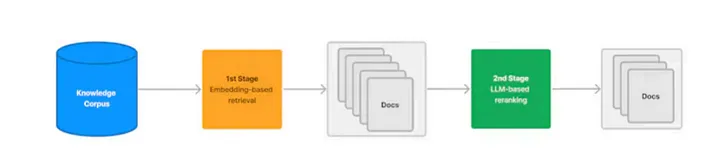

在这种方法中,我们实施了一个两阶段检索过程。

第一阶段采用了基于嵌入的检索,具有较高的top-k值,以优先考虑召回率,即使以较低的精度为代价。

随后,第二阶段采用了略微更具计算密集性的过程,强调精度而不是召回率。该阶段旨在“重新排列”最初检索到的候选项,增强最终结果的质量。

实例化查询引擎

import time

query_engine = index.as_query_engine(similarity_top_k=10, node_postprocessors=[rerank])

提问问题1

now = time.time()

response = query_engine.query("What is instruction finetuning?")

print(f"Response Generated: {response}")

print(f"Elapsed: {round(time.time() - now, 2)}s")

提问问题2

now = time.time()

response = query_engine.query("Describe the Feature-based Approach with BERT??")

print(f"Response Generated: {response}")

print(f"Elapsed: {round(time.time() - now, 2)}s")

提问问题3

now = time.time()

response = query_engine.query("What is SQuADv2.0?")

print(f"Response Generated: {response}")

print(f"Elapsed: {round(time.time() - now, 2)}s")

结论

在这里,我们开发了一个基于私有数据运行的高级RAG问答系统。

我们将LlamaIndex重新排列概念纳入其中,以优先考虑从检索器检索到的上下文中最相关的上下文。这种方法确保了生成响应的事实准确性。

通俗易懂讲解大模型系列

-

重磅消息!《大模型面试宝典》(2024版) 正式发布!

-

重磅消息!《大模型实战宝典》(2024版) 正式发布!

-

做大模型也有1年多了,聊聊这段时间的感悟!

-

用通俗易懂的方式讲解:大模型算法工程师最全面试题汇总

-

用通俗易懂的方式讲解:不要再苦苦寻觅了!AI 大模型面试指南(含答案)的最全总结来了!

-

用通俗易懂的方式讲解:我的大模型岗位面试总结:共24家,9个offer

-

用通俗易懂的方式讲解:大模型 RAG 在 LangChain 中的应用实战

-

用通俗易懂的方式讲解:ChatGPT 开放的多模态的DALL-E 3功能,好玩到停不下来!

-

用通俗易懂的方式讲解:基于扩散模型(Diffusion),文生图 AnyText 的效果太棒了

-

用通俗易懂的方式讲解:在 CPU 服务器上部署 ChatGLM3-6B 模型

-

用通俗易懂的方式讲解:ChatGLM3-6B 部署指南

-

用通俗易懂的方式讲解:使用 LangChain 封装自定义的 LLM,太棒了

-

用通俗易懂的方式讲解:基于 Langchain 和 ChatChat 部署本地知识库问答系统

-

用通俗易懂的方式讲解:Llama2 部署讲解及试用方式

-

用通俗易懂的方式讲解:一份保姆级的 Stable Diffusion 部署教程,开启你的炼丹之路

-

用通俗易懂的方式讲解:LlamaIndex 官方发布高清大图,纵览高级 RAG技术

-

用通俗易懂的方式讲解:为什么大模型 Advanced RAG 方法对于AI的未来至关重要?

-

用通俗易懂的方式讲解:基于 Langchain 框架,利用 MongoDB 矢量搜索实现大模型 RAG 高级检索方法