性能分析与限流策略

常用HTTP服务压测工具介绍

在项目正式上线之前,我们通常需要通过压测来评估当前系统能够支撑的请求量、排查可能存在的隐藏bug,同时了解了程序的实际处理能力能够帮我们更好地匹配项目的实际需求,节约资源成本

压测相关术语

- 响应时间(RT) :指系统对请求作出响应的时间.

- 吞吐量(Throughput) :指系统在单位时间内处理请求的数量

- QPS每秒查询率(Query Per Second) :“每秒查询率”,是一台服务器每秒能够响应的查询次数,是对一个特定的查询服务器在规定时间内所处理流量多少的衡量标准。

- TPS(TransactionPerSecond):每秒钟系统能够处理的交易或事务的数量

- 并发连接数:某个时刻服务器所接受的请求总数

压力测试工具

ab

ab全称Apache Bench,是Apache自 带的性能测试工具。使用这个工具,只须指定同时连接数、请求数以及URL,即可测试网站或网站程序的性能。

通过ab发送请求模拟多个访问者同时对某- -URL地址进行访问, 可以得到每秒传送字节数、每秒处理请求数、每请求处理时间等统计数据。

命令格式:

ab [options] [http://]hostname[:port]/path

常用参数如下:

-n requests 总请求数

-c concurrency 一次产生的请求数,可以理解为并发数

-t timelimit 测试所进行的最大秒数,可以当做请求的超时时间

-ppostfile 包含了需要POST的数据的文件

-T content-type POST数据所使用的Content-type头信息

例如测试某个GET请求接口:

ab -n 10000 -c 100 -t 10"http://127.0.0.1:8080/api/v1/posts?size=10

测试POST请求接口:

ab -n 10000 -c 100 -t 10 -p post.json -T"application/json" "http://127.0.0.1:8080/api/v1/post"

wrk

wrk是- -款开源的HTTP性能测试工具,它和上面提到的ab |同属于HTTP性能测试工具,它比| ab功能更加强大,可以通过编写lua脚本来支持更加复杂的测试场景。

常用命令参数

-C --conections: 保持的连接数

-d --duration: 压测持续时间(s)

-t --threads: 使用的线程总数

-S --script: 加载lua脚本

-H --header: 在请求头部添加一-些参数

--latency 打印详细的延迟统计信息

--timeout 请求的最大超时时间(s)

使用示例:

wrk -t8 -c100 -d30s --latency http://127.0.0.1:8080/api/v1/posts?size=10

输出结果:

Running 30s test @ http://127.0.0.1:8080/api/v1/posts?size=10

8 threads and 100 connections

Thread Stats Avg Stdev Max +/- Stdev

Latency 14.55ms 2.02ms 31. 59ms 76.70%

Req/Sec 828.16 85.69 0.97k 60.46%

Latency Distribution

50% 14.44ms

75% 15.76ms

90% 16.63ms

99% 21.07ms

198091 requests in 30.05s,29. 66MB read

Requests/sec: 6592.29

Trans fer/sec: 0.99MB

go-wrk

go-wrk是Go语言版本的wrk ,Windows同学可以使用它来测试,使用如下命令来安装go-wrk :

go get github. com/adeven/go-wrk

使用方法同wrk类似,基本格式如下:

go-wrk [flags] url

常用参数:

-H="User-Agent: go-wrk 0.1 bechmark\nContent-Type: text/html;": 由'\n' 分隔的请求头

-c=100:使用的最大连接数

-k=true:是否禁用keep-alives

-i=false: if TLS security checks are disabled

-m="GET": HTTP请求方法

-n=1000:请求总数

-t=1: 使用的线程数

-bm"

HTTP请求体

-s=""如果指定,它将计算响应中包含搜索到的字符串s的频率

执行测试:

go-wrk -t=8 -c=100 -n=10000 "http://127.0.0.1:8080/api/v1/posts?size=10"

常用限流策略——漏桶与令牌桶介绍

限流

限流又称为流量控制(流控),通常是指限制到达系统的并发请求数。

我们生活中也会经常遇到限流的场景,比如:某景区限制每日进入景区的游客数量为8万人;沙河地铁站早高峰通过站外排队逐一放行的方式限制同一时间进入车站的旅客数量等。

限流虽然会影响部分用户的使用体验,但是却能在一定程度上报障系统的稳定性,不至于崩溃(大家都没了用户体验)。

而互联网上类似需要限流的业务场景也有很多,比如电商系统的秒杀、微博上突发热点新闻、双十一购物节、12306抢票等等。这些场景下的用户请求量通常会激增,远远超过平时正常的请求量,此时如果不加任何限制很容易就会将后端服务打垮,影响服务的稳定性。

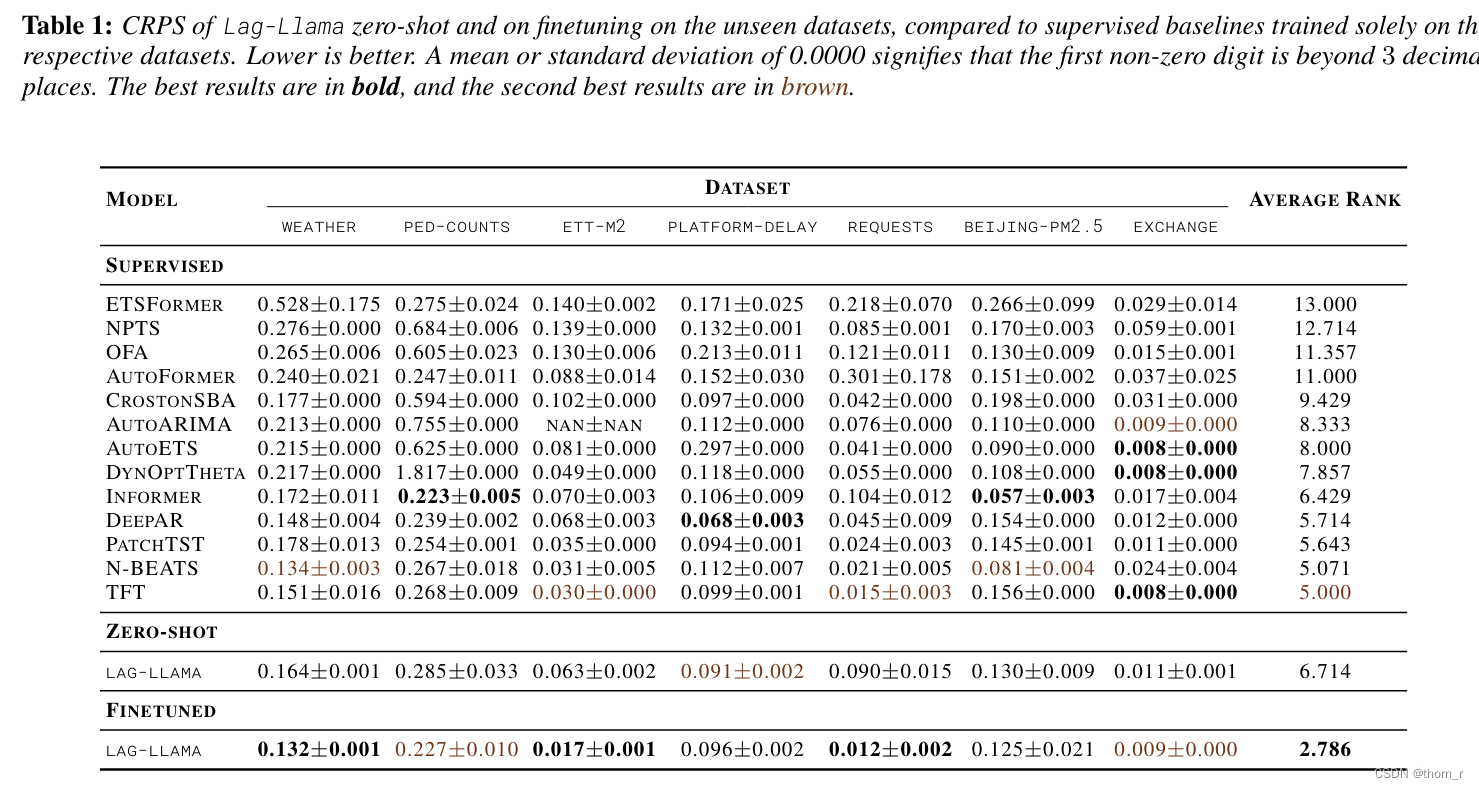

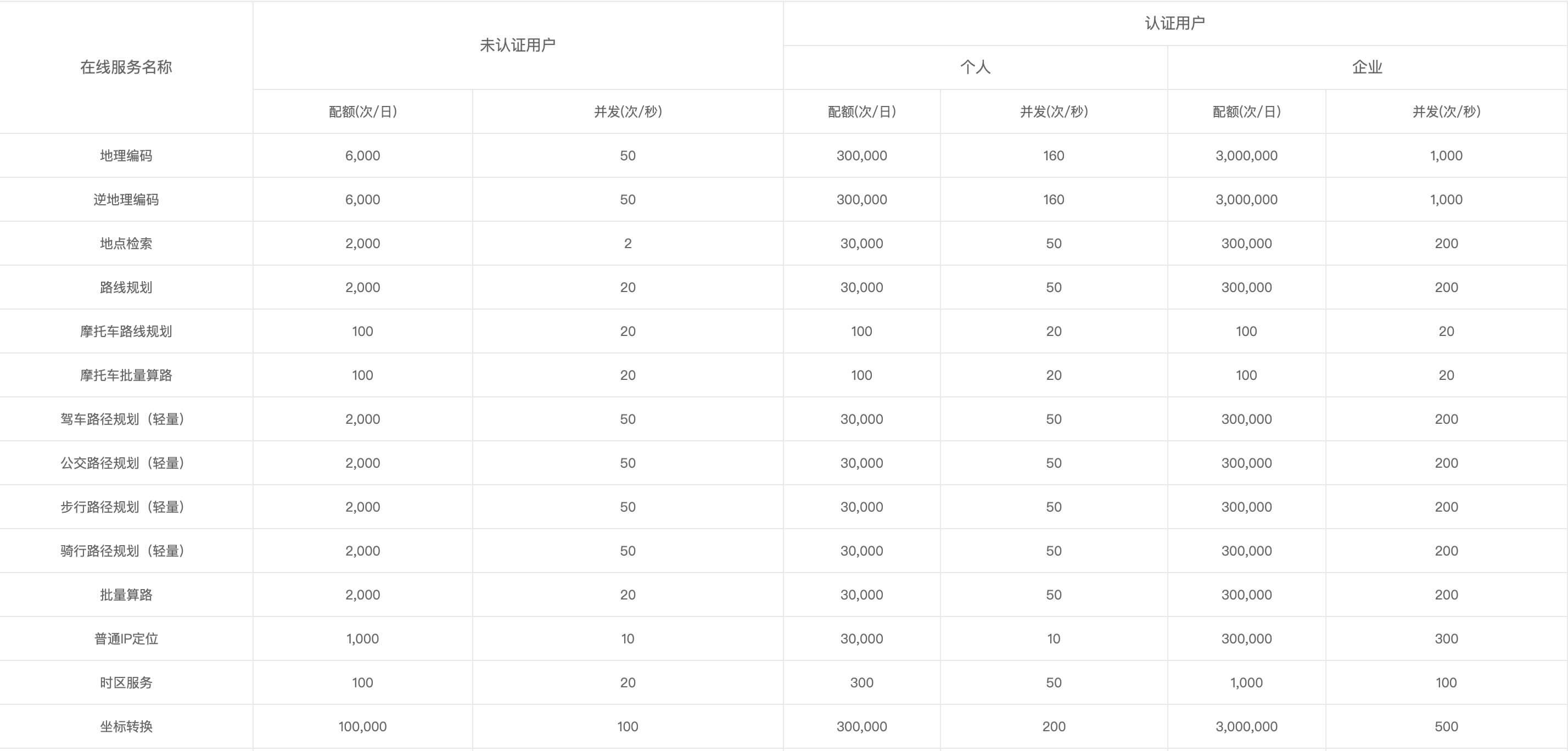

此外,一些厂商公开的API服务通常也会限制用户的请求次数,比如百度地图开放平台等会根据用户的付费情况来限制用户的请求数等。

常用的限流策略

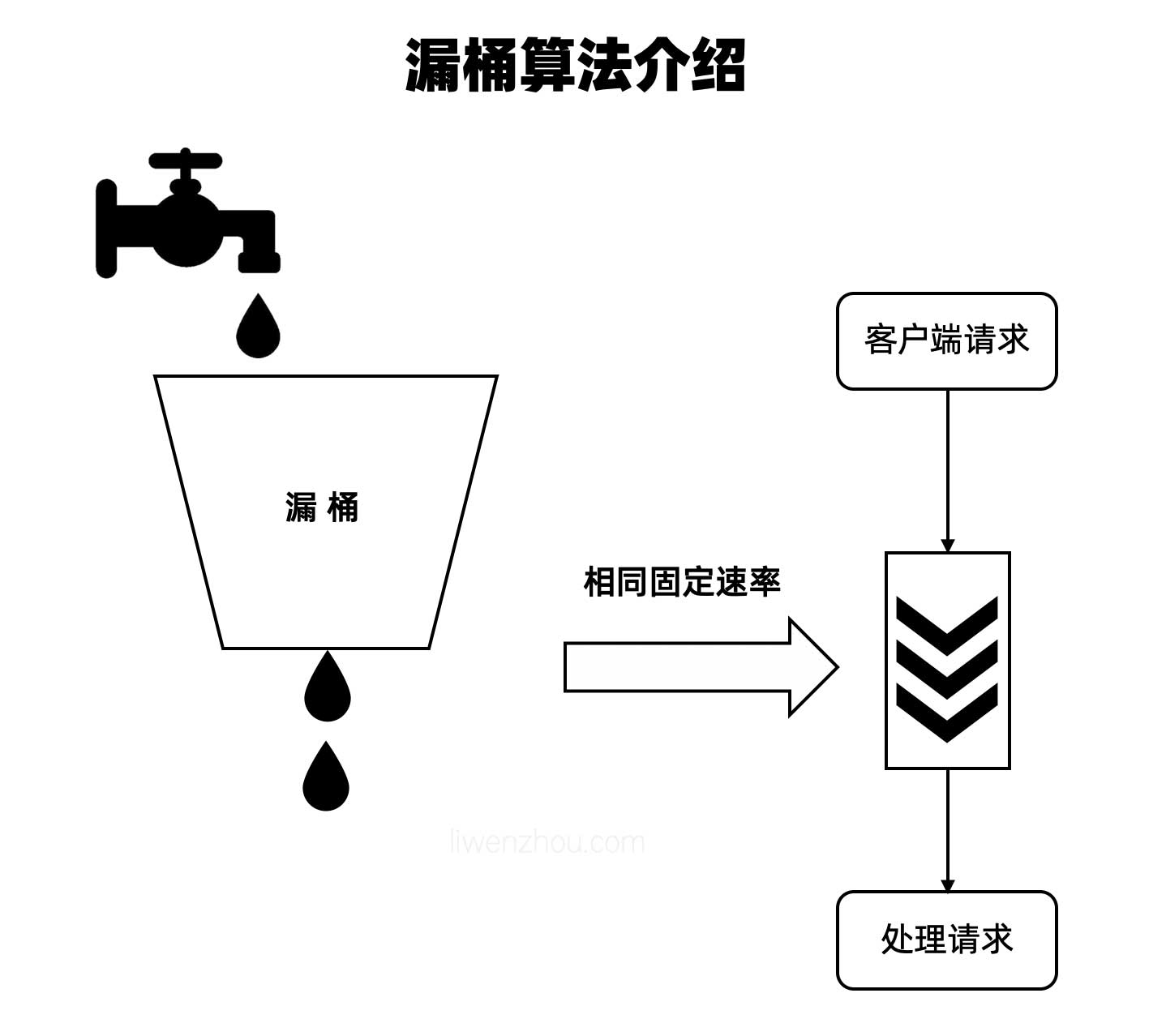

漏桶

漏桶法限流很好理解,假设我们有一个水桶按固定的速率向下方滴落一滴水,无论有多少请求,请求的速率有多大,都按照固定的速率流出,对应到系统中就是按照固定的速率处理请求。

漏桶法的关键点在于漏桶始终按照固定的速率运行,但是它并不能很好的处理有大量突发请求的场景,毕竟在某些场景下我们可能需要提高系统的处理效率,而不是一味的按照固定速率处理请求。

关于漏桶的实现,uber团队有一个开源的github.com/uber-go/ratelimit库。 这个库的使用方法比较简单,Take() 方法会返回漏桶下一次滴水的时间。

import (

"fmt"

"time"

"go.uber.org/ratelimit"

)

func main() {

rl := ratelimit.New(100) // per second

prev := time.Now()

for i := 0; i < 10; i++ {

now := rl.Take()

fmt.Println(i, now.Sub(prev))

prev = now

}

// Output:

// 0 0

// 1 10ms

// 2 10ms

// 3 10ms

// 4 10ms

// 5 10ms

// 6 10ms

// 7 10ms

// 8 10ms

// 9 10ms

}

它的源码实现也比较简单,这里大致说一下关键的地方,有兴趣的同学可以自己去看一下完整的源码。

限制器是一个接口类型,其要求实现一个Take()方法:

type Limiter interface {

// Take方法应该阻塞已确保满足 RPS

Take() time.Time

}

实现限制器接口的结构体定义如下,这里可以重点留意下maxSlack字段,它在后面的Take()方法中的处理。

type limiter struct {

sync.Mutex // 锁

last time.Time // 上一次的时刻

sleepFor time.Duration // 需要等待的时间

perRequest time.Duration // 每次的时间间隔

maxSlack time.Duration // 最大的富余量

clock Clock // 时钟

}

limiter结构体实现Limiter接口的Take()方法内容如下:

// Take 会阻塞确保两次请求之间的时间走完

// Take 调用平均数为 time.Second/rate.

func (t *limiter) Take() time.Time {

t.Lock()

defer t.Unlock()

now := t.clock.Now()

// 如果是第一次请求就直接放行

if t.last.IsZero() {

t.last = now

return t.last

}

// sleepFor 根据 perRequest 和上一次请求的时刻计算应该sleep的时间

// 由于每次请求间隔的时间可能会超过perRequest, 所以这个数字可能为负数,并在多个请求之间累加

t.sleepFor += t.perRequest - now.Sub(t.last)

// 我们不应该让sleepFor负的太多,因为这意味着一个服务在短时间内慢了很多随后会得到更高的RPS。

if t.sleepFor < t.maxSlack {

t.sleepFor = t.maxSlack

}

// 如果 sleepFor 是正值那么就 sleep

if t.sleepFor > 0 {

t.clock.Sleep(t.sleepFor)

t.last = now.Add(t.sleepFor)

t.sleepFor = 0

} else {

t.last = now

}

return t.last

}

上面的代码根据记录每次请求的间隔时间和上一次请求的时刻来计算当次请求需要阻塞的时间——sleepFor,这里需要留意的是sleepFor的值可能为负,在经过间隔时间长的两次访问之后会导致随后大量的请求被放行,所以代码中针对这个场景有专门的优化处理。创建限制器的New()函数中会为maxSlack设置初始值,也可以通过WithoutSlack这个Option取消这个默认值。

func New(rate int, opts ...Option) Limiter {

l := &limiter{

perRequest: time.Second / time.Duration(rate),

maxSlack: -10 * time.Second / time.Duration(rate),

}

for _, opt := range opts {

opt(l)

}

if l.clock == nil {

l.clock = clock.New()

}

return l

}

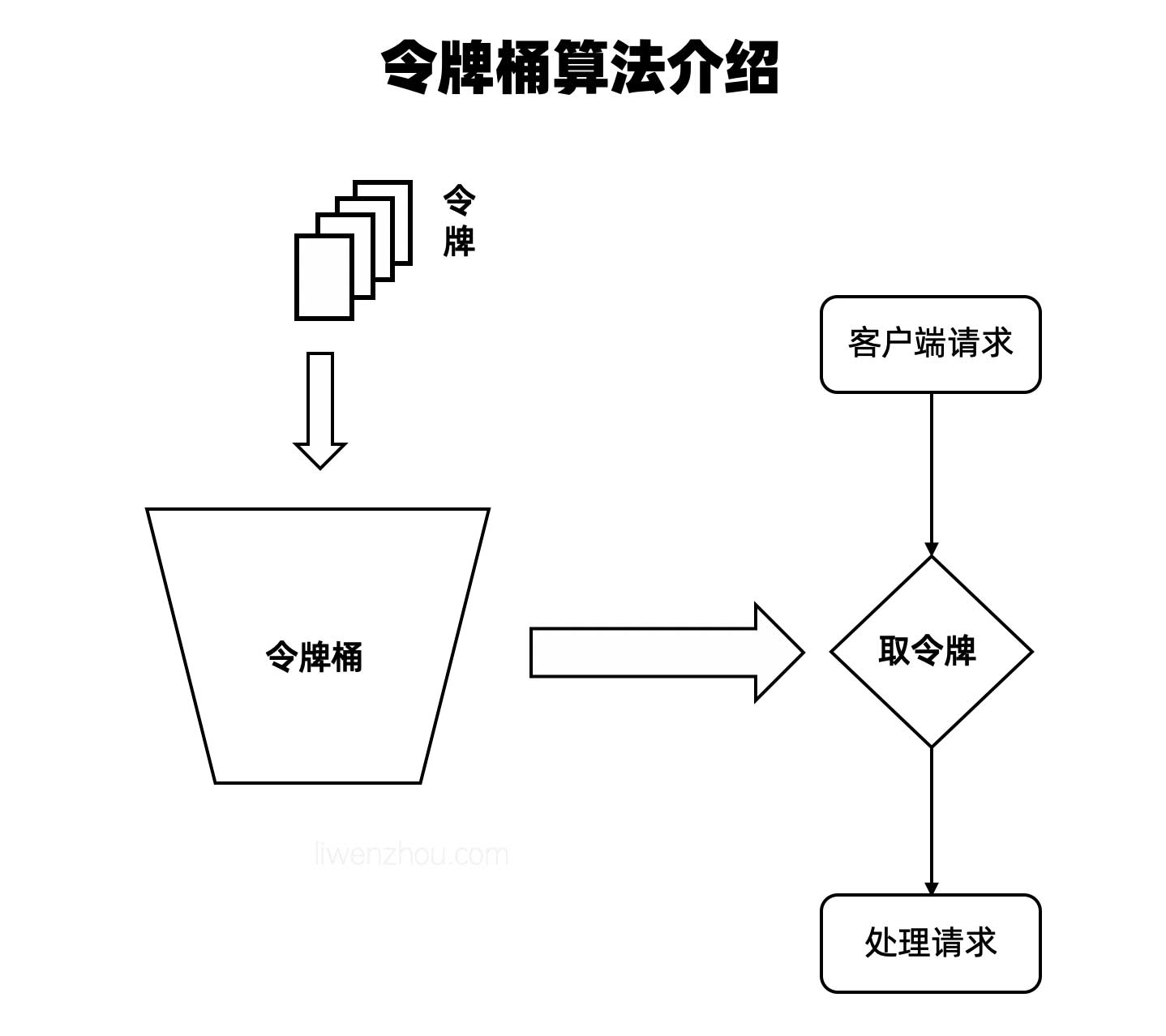

令牌桶

令牌桶其实和漏桶的原理类似,令牌桶按固定的速率往桶里放入令牌,并且只要能从桶里取出令牌就能通过,令牌桶支持突发流量的快速处理。

对于从桶里取不到令牌的场景,我们可以选择等待也可以直接拒绝并返回。

对于令牌桶的Go语言实现,大家可以参照github.com/juju/ratelimit库。这个库支持多种令牌桶模式,并且使用起来也比较简单。

创建令牌桶的方法:

// 创建指定填充速率和容量大小的令牌桶

func NewBucket(fillInterval time.Duration, capacity int64) *Bucket

// 创建指定填充速率、容量大小和每次填充的令牌数的令牌桶

func NewBucketWithQuantum(fillInterval time.Duration, capacity, quantum int64) *Bucket

// 创建填充速度为指定速率和容量大小的令牌桶

// NewBucketWithRate(0.1, 200) 表示每秒填充20个令牌

func NewBucketWithRate(rate float64, capacity int64) *Bucket

取出令牌的方法如下:

// 取token(非阻塞)

func (tb *Bucket) Take(count int64) time.Duration

func (tb *Bucket) TakeAvailable(count int64) int64

// 最多等maxWait时间取token

func (tb *Bucket) TakeMaxDuration(count int64, maxWait time.Duration) (time.Duration, bool)

// 取token(阻塞)

func (tb *Bucket) Wait(count int64)

func (tb *Bucket) WaitMaxDuration(count int64, maxWait time.Duration) bool

虽说是令牌桶,但是我们没有必要真的去生成令牌放到桶里,我们只需要每次来取令牌的时候计算一下,当前是否有足够的令牌就可以了,具体的计算方式可以总结为下面的公式:

当前令牌数 = 上一次剩余的令牌数 + (本次取令牌的时刻-上一次取令牌的时刻)/放置令牌的时间间隔 * 每次放置的令牌数

github.com/juju/ratelimit这个库中关于令牌数计算的源代码如下:

func (tb *Bucket) currentTick(now time.Time) int64 {

return int64(now.Sub(tb.startTime) / tb.fillInterval)

}

func (tb *Bucket) adjustavailableTokens(tick int64) {

if tb.availableTokens >= tb.capacity {

return

}

tb.availableTokens += (tick - tb.latestTick) * tb.quantum

if tb.availableTokens > tb.capacity {

tb.availableTokens = tb.capacity

}

tb.latestTick = tick

return

}

获取令牌的TakeAvailable()函数关键部分的源代码如下:

func (tb *Bucket) takeAvailable(now time.Time, count int64) int64 {

if count <= 0 {

return 0

}

tb.adjustavailableTokens(tb.currentTick(now))

if tb.availableTokens <= 0 {

return 0

}

if count > tb.availableTokens {

count = tb.availableTokens

}

tb.availableTokens -= count

return count

}

大家从代码中也可以看到其实令牌桶的实现并没有很复杂。

gin框架中使用限流中间件

在gin框架构建的项目中,我们可以将限流组件定义成中间件。

这里使用令牌桶作为限流策略,编写一个限流中间件如下:

func RateLimitMiddleware(fillInterval time.Duration, cap int64) func(c *gin.Context) {

bucket := ratelimit.NewBucket(fillInterval, cap)

return func(c *gin.Context) {

// 如果取不到令牌就中断本次请求返回 rate limit...

if bucket.TakeAvailable(1) < 1 {

c.String(http.StatusOK, "rate limit...")

c.Abort()

return

}

c.Next()

}

}

对于该限流中间件的注册位置,我们可以按照不同的限流策略将其注册到不同的位置,例如:

- 如果要对全站限流就可以注册成全局的中间件。

- 如果是某一组路由需要限流,那么就只需将该限流中间件注册到对应的路由组即可。

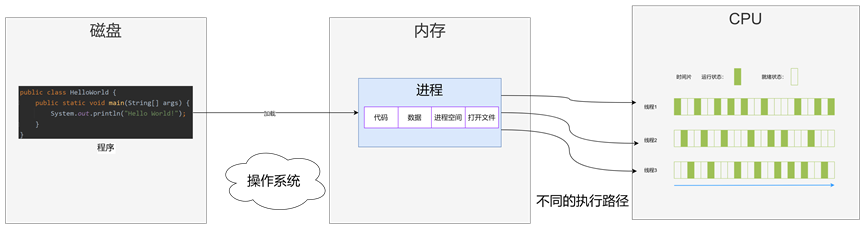

在计算机性能调试领域里,profiling 是指对应用程序的画像,画像就是应用程序使用 CPU 和内存的情况。 Go语言是一个对性能特别看重的语言,因此语言中自带了 profiling 的库,这篇文章就要讲解怎么在 golang 中做 profiling。

Go性能优化

Go语言项目中的性能优化主要有以下几个方面:

- CPU profile:报告程序的 CPU 使用情况,按照一定频率去采集应用程序在 CPU 和寄存器上面的数据

- Memory Profile(Heap Profile):报告程序的内存使用情况

- Block Profiling:报告 goroutines 不在运行状态的情况,可以用来分析和查找死锁等性能瓶颈

- Goroutine Profiling:报告 goroutines 的使用情况,有哪些 goroutine,它们的调用关系是怎样的

采集性能数据

Go语言内置了获取程序的运行数据的工具,包括以下两个标准库:

runtime/pprof:采集工具型应用运行数据进行分析net/http/pprof:采集服务型应用运行时数据进行分析

pprof开启后,每隔一段时间(10ms)就会收集下当前的堆栈信息,获取各个函数占用的CPU以及内存资源;最后通过对这些采样数据进行分析,形成一个性能分析报告。

注意,我们只应该在性能测试的时候才在代码中引入pprof。

工具型应用

如果你的应用程序是运行一段时间就结束退出类型。那么最好的办法是在应用退出的时候把 profiling 的报告保存到文件中,进行分析。对于这种情况,可以使用runtime/pprof库。 首先在代码中导入runtime/pprof工具:

import "runtime/pprof"

CPU性能分析

开启CPU性能分析:

pprof.StartCPUProfile(w io.Writer)

停止CPU性能分析:

pprof.StopCPUProfile()

应用执行结束后,就会生成一个文件,保存了我们的 CPU profiling 数据。得到采样数据之后,使用go tool pprof工具进行CPU性能分析。

内存性能优化

记录程序的堆栈信息

pprof.WriteHeapProfile(w io.Writer)

得到采样数据之后,使用go tool pprof工具进行内存性能分析。

go tool pprof默认是使用-inuse_space进行统计,还可以使用-inuse-objects查看分配对象的数量。

服务型应用

如果你的应用程序是一直运行的,比如 web 应用,那么可以使用net/http/pprof库,它能够在提供 HTTP 服务进行分析。

如果使用了默认的http.DefaultServeMux(通常是代码直接使用 http.ListenAndServe(“0.0.0.0:8000”, nil)),只需要在你的web server端代码中按如下方式导入net/http/pprof

import _ "net/http/pprof"

如果你使用自定义的 Mux,则需要手动注册一些路由规则:

r.HandleFunc("/debug/pprof/", pprof.Index)

r.HandleFunc("/debug/pprof/cmdline", pprof.Cmdline)

r.HandleFunc("/debug/pprof/profile", pprof.Profile)

r.HandleFunc("/debug/pprof/symbol", pprof.Symbol)

r.HandleFunc("/debug/pprof/trace", pprof.Trace)

如果你使用的是gin框架,那么推荐使用github.com/gin-contrib/pprof,在代码中通过以下命令注册pprof相关路由。

pprof.Register(router)

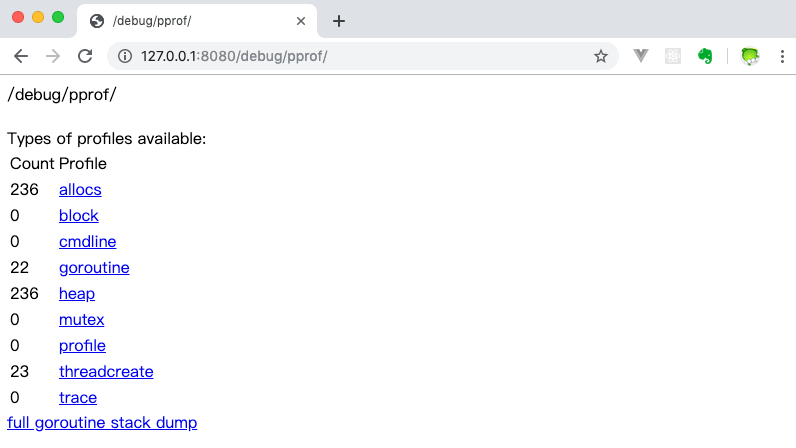

不管哪种方式,你的 HTTP 服务都会多出/debug/pprof endpoint,访问它会得到类似下面的内容: 这个路径下还有几个子页面:

这个路径下还有几个子页面:

- /debug/pprof/profile:访问这个链接会自动进行 CPU profiling,持续 30s,并生成一个文件供下载

- /debug/pprof/heap: Memory Profiling 的路径,访问这个链接会得到一个内存 Profiling 结果的文件

- /debug/pprof/block:block Profiling 的路径

- /debug/pprof/goroutines:运行的 goroutines 列表,以及调用关系

go tool pprof命令

不管是工具型应用还是服务型应用,我们使用相应的pprof库获取数据之后,下一步的都要对这些数据进行分析,我们可以使用go tool pprof命令行工具。

go tool pprof最简单的使用方式为:

go tool pprof [binary] [source]

其中:

- binary 是应用的二进制文件,用来解析各种符号;

- source 表示 profile 数据的来源,可以是本地的文件,也可以是 http 地址。

注意事项: 获取的 Profiling 数据是动态的,要想获得有效的数据,请保证应用处于较大的负载(比如正在生成中运行的服务,或者通过其他工具模拟访问压力)。否则如果应用处于空闲状态,得到的结果可能没有任何意义。

具体示例

首先我们来写一段有问题的代码:

// runtime_pprof/main.go

package main

import (

"flag"

"fmt"

"os"

"runtime/pprof"

"time"

)

// 一段有问题的代码

func logicCode() {

var c chan int

for {

select {

case v := <-c:

fmt.Printf("recv from chan, value:%v\n", v)

default:

}

}

}

func main() {

var isCPUPprof bool

var isMemPprof bool

flag.BoolVar(&isCPUPprof, "cpu", false, "turn cpu pprof on")

flag.BoolVar(&isMemPprof, "mem", false, "turn mem pprof on")

flag.Parse()

if isCPUPprof {

file, err := os.Create("./cpu.pprof")

if err != nil {

fmt.Printf("create cpu pprof failed, err:%v\n", err)

return

}

pprof.StartCPUProfile(file)

defer pprof.StopCPUProfile()

}

for i := 0; i < 8; i++ {

go logicCode()

}

time.Sleep(20 * time.Second)

if isMemPprof {

file, err := os.Create("./mem.pprof")

if err != nil {

fmt.Printf("create mem pprof failed, err:%v\n", err)

return

}

pprof.WriteHeapProfile(file)

file.Close()

}

}

通过flag我们可以在命令行控制是否开启CPU和Mem的性能分析。 将上面的代码保存并编译成runtime_pprof可执行文件,执行时加上-cpu命令行参数如下:

./runtime_pprof -cpu

等待30秒后会在当前目录下生成一个cpu.pprof文件。

命令行交互界面

我们使用go工具链里的pprof来分析一下。

go tool pprof cpu.pprof

执行上面的代码会进入交互界面如下:

runtime_pprof $ go tool pprof cpu.pprof

Type: cpu

Time: Jun 28, 2019 at 11:28am (CST)

Duration: 20.13s, Total samples = 1.91mins (568.60%)

Entering interactive mode (type "help" for commands, "o" for options)

(pprof)

我们可以在交互界面输入top3来查看程序中占用CPU前3位的函数:

(pprof) top3

Showing nodes accounting for 100.37s, 87.68% of 114.47s total

Dropped 17 nodes (cum <= 0.57s)

Showing top 3 nodes out of 4

flat flat% sum% cum cum%

42.52s 37.15% 37.15% 91.73s 80.13% runtime.selectnbrecv

35.21s 30.76% 67.90% 39.49s 34.50% runtime.chanrecv

22.64s 19.78% 87.68% 114.37s 99.91% main.logicCode

其中:

- flat:当前函数占用CPU的耗时

- flat::当前函数占用CPU的耗时百分比

- sun%:函数占用CPU的耗时累计百分比

- cum:当前函数加上调用当前函数的函数占用CPU的总耗时

- cum%:当前函数加上调用当前函数的函数占用CPU的总耗时百分比

- 最后一列:函数名称

在大多数的情况下,我们可以通过分析这五列得出一个应用程序的运行情况,并对程序进行优化。

我们还可以使用list 函数名命令查看具体的函数分析,例如执行list logicCode查看我们编写的函数的详细分析。

(pprof) list logicCode

Total: 1.91mins

ROUTINE ================ main.logicCode in .../runtime_pprof/main.go

22.64s 1.91mins (flat, cum) 99.91% of Total

. . 12:func logicCode() {

. . 13: var c chan int

. . 14: for {

. . 15: select {

. . 16: case v := <-c:

22.64s 1.91mins 17: fmt.Printf("recv from chan, value:%v\n", v)

. . 18: default:

. . 19:

. . 20: }

. . 21: }

. . 22:}

通过分析发现大部分CPU资源被17行占用,我们分析出select语句中的default没有内容会导致上面的case v:=<-c:一直执行。我们在default分支添加一行time.Sleep(time.Second)即可。

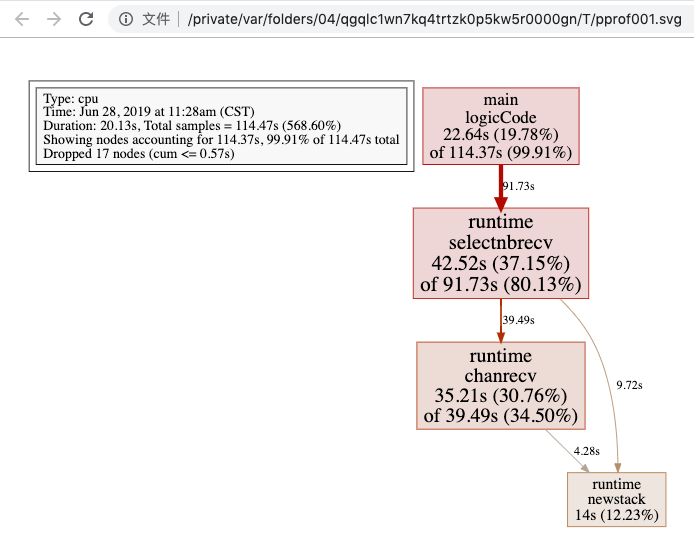

图形化

或者可以直接输入web,通过svg图的方式查看程序中详细的CPU占用情况。 想要查看图形化的界面首先需要安装graphviz图形化工具。

Mac:

brew install graphviz

Windows: 下载graphviz 将graphviz安装目录下的bin文件夹添加到Path环境变量中。 在终端输入dot -version查看是否安装成功。

关于图形的说明: 每个框代表一个函数,理论上框的越大表示占用的CPU资源越多。 方框之间的线条代表函数之间的调用关系。 线条上的数字表示函数调用的次数。 方框中的第一行数字表示当前函数占用CPU的百分比,第二行数字表示当前函数累计占用CPU的百分比。

关于图形的说明: 每个框代表一个函数,理论上框的越大表示占用的CPU资源越多。 方框之间的线条代表函数之间的调用关系。 线条上的数字表示函数调用的次数。 方框中的第一行数字表示当前函数占用CPU的百分比,第二行数字表示当前函数累计占用CPU的百分比。

除了分析CPU性能数据,pprof也支持分析内存性能数据。比如,使用下面的命令分析http服务的heap性能数据,查看当前程序的内存占用以及热点内存对象使用的情况。

# 查看内存占用数据

go tool pprof -inuse_space http://127.0.0.1:8080/debug/pprof/heap

go tool pprof -inuse_objects http://127.0.0.1:8080/debug/pprof/heap

# 查看临时内存分配数据

go tool pprof -alloc_space http://127.0.0.1:8080/debug/pprof/heap

go tool pprof -alloc_objects http://127.0.0.1:8080/debug/pprof/heap

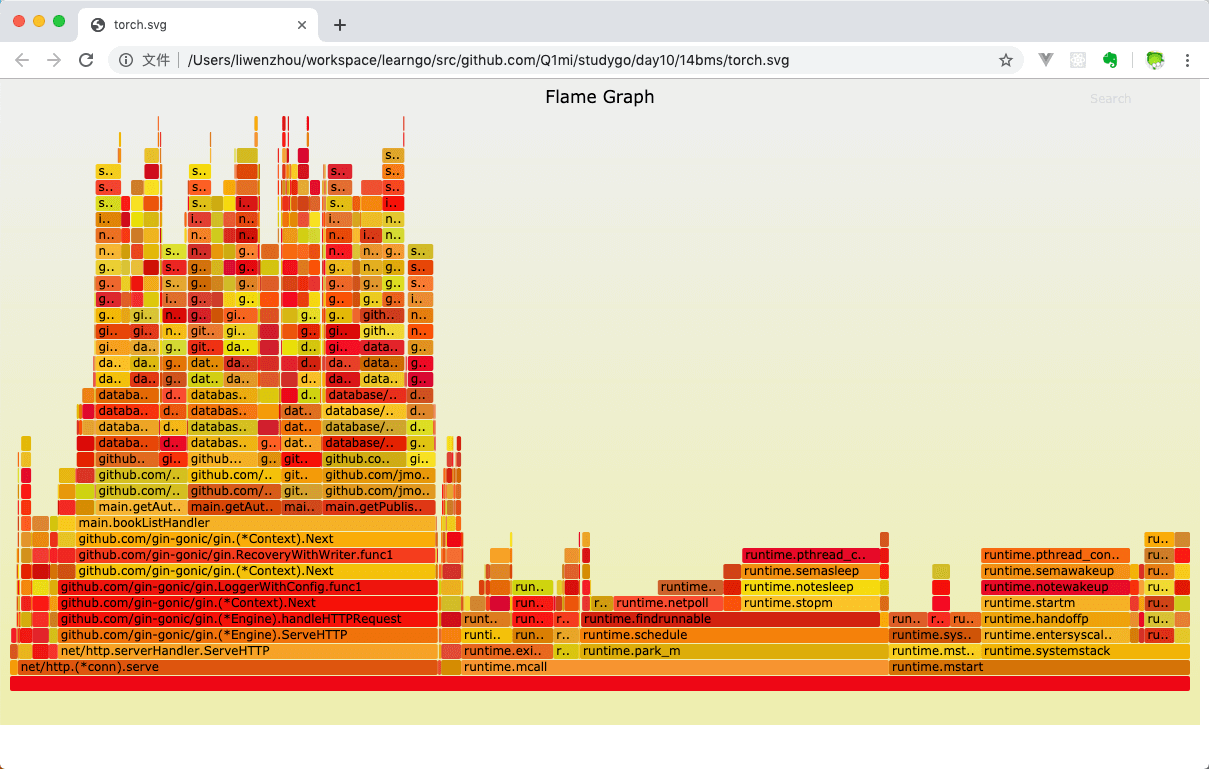

go-torch和火焰图

火焰图(Flame Graph)是 Bredan Gregg 创建的一种性能分析图表,因为它的样子近似 🔥而得名。上面的 profiling 结果也转换成火焰图,如果对火焰图比较了解可以手动来操作,不过这里我们要介绍一个工具:go-torch。这是 uber 开源的一个工具,可以直接读取 golang profiling 数据,并生成一个火焰图的 svg 文件。

安装go-torch

go get -v github.com/uber/go-torch

火焰图 svg 文件可以通过浏览器打开,它对于调用图的最优点是它是动态的:可以通过点击每个方块来 zoom in 分析它上面的内容。

火焰图的调用顺序从下到上,每个方块代表一个函数,它上面一层表示这个函数会调用哪些函数,方块的大小代表了占用 CPU 使用的长短。火焰图的配色并没有特殊的意义,默认的红、黄配色是为了更像火焰而已。

go-torch 工具的使用非常简单,没有任何参数的话,它会尝试从http://localhost:8080/debug/pprof/profile获取 profiling 数据。它有三个常用的参数可以调整:

- -u –url:要访问的 URL,这里只是主机和端口部分

- -s –suffix:pprof profile 的路径,默认为 /debug/pprof/profile

- –seconds:要执行 profiling 的时间长度,默认为 30s

安装 FlameGraph

要生成火焰图,需要事先安装 FlameGraph工具,这个工具的安装很简单(需要perl环境支持),只要把对应的可执行文件加入到环境变量中即可。

- 下载安装perl:https://www.perl.org/get.html

- 下载FlameGraph:

git clone https://github.com/brendangregg/FlameGraph.git - 将

FlameGraph目录加入到操作系统的环境变量中。 - Windows平台的同学,需要把

go-torch/render/flamegraph.go文件中的GenerateFlameGraph按如下方式修改,然后在go-torch目录下执行go install即可。

// GenerateFlameGraph runs the flamegraph script to generate a flame graph SVG. func GenerateFlameGraph(graphInput []byte, args ...string) ([]byte, error) {

flameGraph := findInPath(flameGraphScripts)

if flameGraph == "" {

return nil, errNoPerlScript

}

if runtime.GOOS == "windows" {

return runScript("perl", append([]string{flameGraph}, args...), graphInput)

}

return runScript(flameGraph, args, graphInput)

}

压测工具wrk

推荐使用https://github.com/wg/wrk 或 https://github.com/adjust/go-wrk

使用go-torch

使用wrk进行压测:

go-wrk -n 50000 http://127.0.0.1:8080/book/list

在上面压测进行的同时,打开另一个终端执行:

go-torch -u http://127.0.0.1:8080 -t 30

30秒之后终端会初夏如下提示:Writing svg to torch.svg

然后我们使用浏览器打开torch.svg就能看到如下火焰图了。 火焰图的y轴表示cpu调用方法的先后,x轴表示在每个采样调用时间内,方法所占的时间百分比,越宽代表占据cpu时间越多。通过火焰图我们就可以更清楚的找出耗时长的函数调用,然后不断的修正代码,重新采样,不断优化。

火焰图的y轴表示cpu调用方法的先后,x轴表示在每个采样调用时间内,方法所占的时间百分比,越宽代表占据cpu时间越多。通过火焰图我们就可以更清楚的找出耗时长的函数调用,然后不断的修正代码,重新采样,不断优化。

此外还可以借助火焰图分析内存性能数据:

go-torch -inuse_space http://127.0.0.1:8080/debug/pprof/heap

go-torch -inuse_objects http://127.0.0.1:8080/debug/pprof/heap

go-torch -alloc_space http://127.0.0.1:8080/debug/pprof/heap

go-torch -alloc_objects http://127.0.0.1:8080/debug/pprof/heap

pprof与性能测试结合

go test命令有两个参数和 pprof 相关,它们分别指定生成的 CPU 和 Memory profiling 保存的文件:

- -cpuprofile:cpu profiling 数据要保存的文件地址

- -memprofile:memory profiling 数据要报文的文件地址

我们还可以选择将pprof与性能测试相结合,比如:

比如下面执行测试的同时,也会执行 CPU profiling,并把结果保存在 cpu.prof 文件中:

go test -bench . -cpuprofile=cpu.prof

比如下面执行测试的同时,也会执行 Mem profiling,并把结果保存在 cpu.prof 文件中:

go test -bench . -memprofile=./mem.prof

需要注意的是,Profiling 一般和性能测试一起使用,这个原因在前文也提到过,只有应用在负载高的情况下 Profiling 才有意义。