GooLeNet

亮点

-

最明显的亮点就是引入了Inception,初衷是多卷积核增加特征的多样性,提高泛化能力 ,比如,最下边是一个输入层,然后这个输入分别传递给1*1,3 * 3 ,5 * 5和一个最大池化层,然后将所有的输出特征图在深度上进行一个串联,所以说这就要保证特征图的大小必须得是一致的,1 * 1的卷积核不改变大小,其他卷积核池化要添加0补充。

这就是Inception V1结构,但由于他们是在深度上进行串联的,所以这就导致了深度或者说通道特别深,因为maxpooling层是不改变深度的,只会越来越深。

所以这个问题如何解决呢?这就引入了Inception V2结构,在3 * 3 5 * 5的卷积核之前加入1 * 1卷积核降维 , 最大池化层后也加入1 * 1降维,从而减少了深度和参数

除此之外呢,还有Inception V3结构,将 5 * 5卷积核裂变为3 * 3 的卷积核堆叠起来,进一步降低了参数量, 一个是5 5 + 1 = 26 一个是(3 * 3 + 1) 2 = 20,同时多个卷积核引入了多个非线性激活函数,从而使表征能力更强,训练更快。

-

除了最后类别输出的一个全连接层,没有额外的全连接层,使用平均池化层,大大减少了模型参数。

-

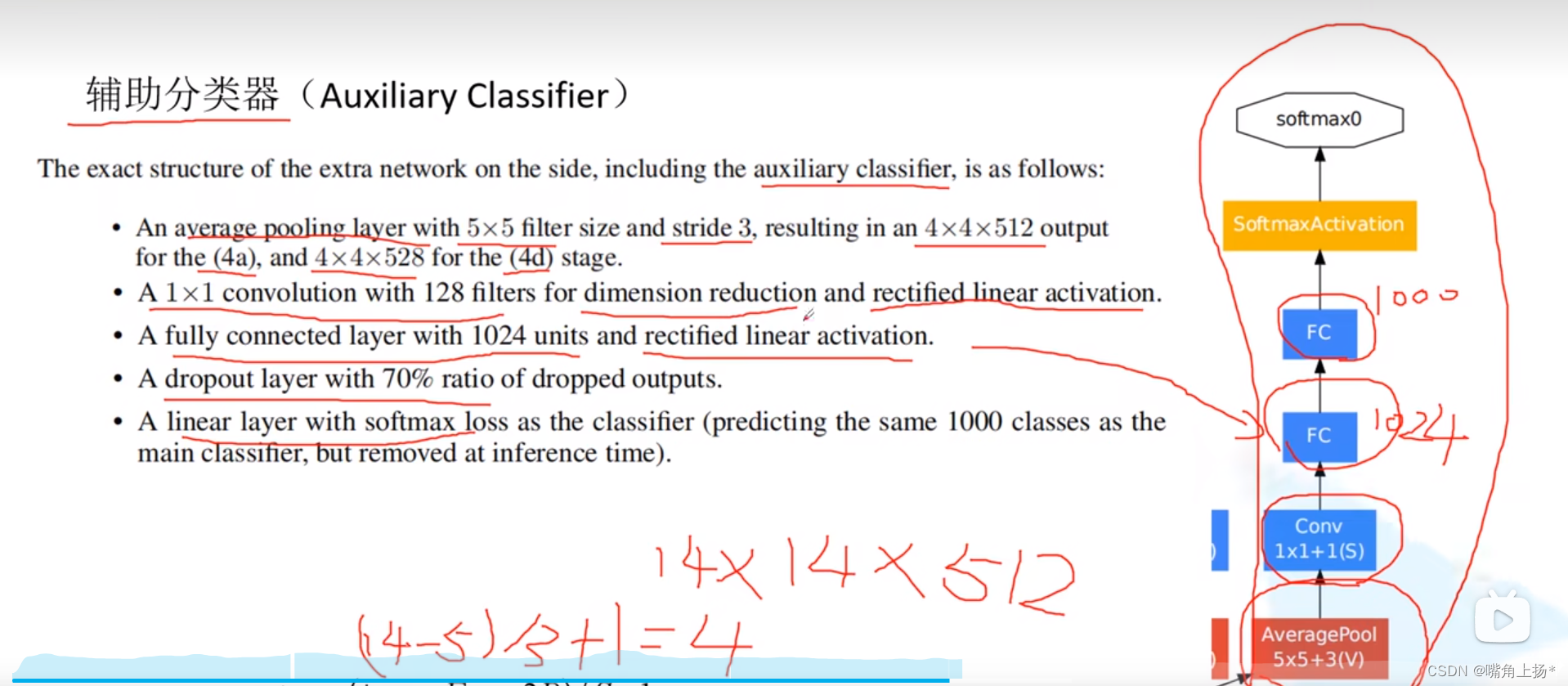

添加了两个辅助分类器帮助训练,解决由于模型深度过深导致的梯度消失的问题。

1*1 卷积核作用

因为输出后特征图的深度和卷积核的数量相等,所以使用1*1卷积核可以减少特征矩阵的深度,从而减少参数和计算量

辅助分类器的结构

1个平均池化层和1一个卷积层以及2个全连接层和Softmax激活层

![[ROS 系列学习教程] rosbag C++ API](https://img-blog.csdnimg.cn/direct/5f927cceba4d474da5b8887bc77d34e4.png#pic_center)