OpenAI最新推出的视频创作的颠覆性产品:Sora,它开启了该行业的新纪元,吊打目前一众视频制作工具。

无论是专业人士还是爱好者,都可以轻松创作出高质量的视频内容。

Sora同样是一个根据文本指令创建逼真而富有想象力的场景的人工智能模型。 尽管仍有一些限制,但随着技术的不断进步,相信这些问题将会逐渐被解决。

需要注意的是,截止本文发布之日,OpenAI只向部分专业用户开放了Sora的访问权限。普通用户只能观看其发布的演示视频。

CSDN视频上传出了问题,目前仅能上传一部分视频。

官方网址:https://openai.com/sora

OpenAI推出SORA之paper-planes

1. Sora介绍

OpenAI正在教导人工智能理解和模拟运动中的物理世界,旨在训练出能够帮助人们解决真实世界互动的问题的模型。

2024年2月16日推出的Sora,能将文本转为视频模型。

Sora可以生成长达一分钟的视频,同时保持视觉质量和与用户提示的一致性。

OpenAI推出最新的文本制作视频工具之tokyo-walk

2. 目前情况

2024年2月16日,Sora已提供给测试团队,以评估可能存在损害或风险的关键领域,同时还授权一些视觉艺术家、设计师和电影制作人使用,以获取关于如何推进模型以对创意专业人士最有帮助的反馈。

OpenAI提前分享研究进展,开始与OpenAI以外的人合作,并获取反馈,让公众了解人工智能技术未来的发展方向。

OpenAI推出最新的视频工具Sora之gold-rush

3. 优势能力

Sora能够生成包含多个角色、特定类型的动作以及主题和背景的准确细节的复杂场景。该模型不仅理解用户在提示中要求的内容,还能理解这些内容在物理世界中的存在方式。

OpenAI之closeup-of-womans-eye

该模型对语言有深刻的理解,能够准确解释提示,并生成生动的角色,表达丰富的情感。Sora还可以在单个生成的视频中创建多个镜头,准确地保持角色和视觉风格。

OpenAI推出Sora之dancing-kangaroo

4. 弱点缺陷

当前模型存在一些缺陷。它可能在准确模拟复杂场景的物理过程上遇到困难,并且可能无法理解特定情况下的因果关系。例如,一个人可能咬了一口饼干,但之后饼干上可能没有咬痕。

该模型还可能混淆提示中的空间细节,例如左右混淆,可能在对随时间发生的事件进行精确描述时遇到困难,比如追踪特定的摄像机轨迹。

OpenAI推出最新的视频工具Sora之lagos

5. 安全方面

安全性

在将Sora引入OpenAI的产品之前,OpenAI将采取几项重要的安全步骤。OpenAI正在与测试团队合作,测试团队是在误导信息、仇恨内容和偏见等领域的领域专家,他们将对该模型进行对抗性测试。

OpenAI还正在构建工具来帮助检测误导性内容,比如一个检测分类器,可以判断视频是否由Sora生成。如果OpenAI将该模型部署到OpenAI产品中,OpenAI计划在将来包含C2PA元数据。

OpenAI推出最新的视频工zen-garden-gnome

除了OpenAI开发新技术以准备部署外,OpenAI还利用了为使用DALL·E 3的产品构建的现有安全方法,这些方法也适用于Sora。

例如,一旦进入OpenAI产品, 其文本分类器将检查并拒绝违反使用政策的文本输入提示,例如那些请求极端暴力、性内容、仇恨图像、名人肖像或他人知识产权的提示。OpenAI还开发了强大的图像分类器,用于审查生成的每个视频的帧,以确保其符合使用政策,然后再向用户显示。

OpenAI将与全球的政策制定者、教育工作者和艺术家进行互动,了解他们的关注点,并确定这项新技术的积极应用案例。尽管进行了广泛的研究和测试,OpenAI无法预测人们将如何以及会如何滥用OpenAI的技术。这就是为什么OpenAI认为从实际使用中学习是创建和释放日益安全的人工智能系统的关键组成部分。

OpenAI推出Sora之petri-dish-pandas

6. 未来方向

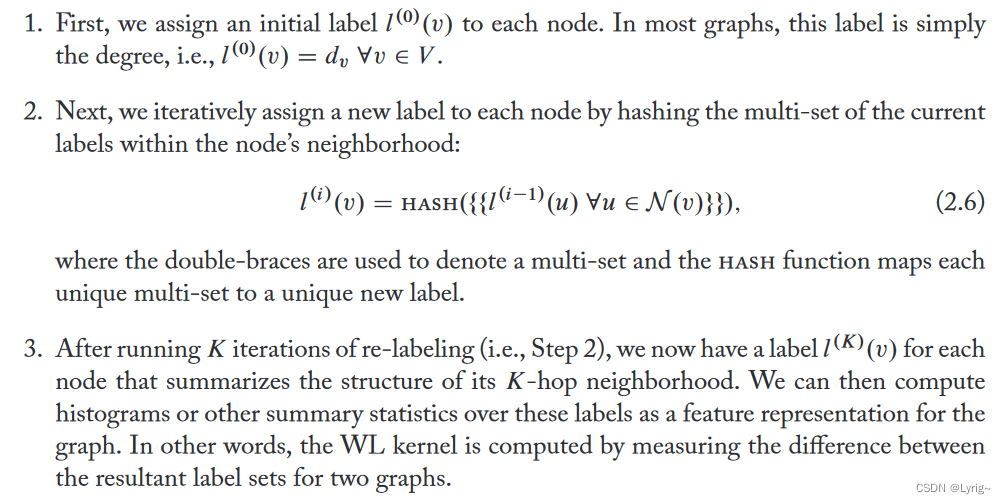

Sora是一个扩散模型,它通过从一个看起来像静态噪声的视频开始,并逐步通过在许多步骤中消除噪声来转换它来生成视频。

Sora能够一次性生成整个视频,也可以扩展生成的视频以使其更长。通过让模型一次性预见多个帧,OpenAI解决了一个具有挑战性的问题,即确保主题在暂时离开视野时保持不变。

类似于GPT模型,Sora使用变压器架构,实现了更优越的扩展性能。

OpenAI将视频和图像表示为称为“补丁”的更小数据单元的集合,每个补丁类似于GPT中的一个令牌。通过统一OpenAI表示数据的方式,OpenAI可以训练扩散变压器处理比以前更广泛的视觉数据,包括不同的持续时间、分辨率和纵横比。

Sora建立在过去DALL·E和GPT模型的研究基础上。它使用了DALL·E 3中的重新标注技术,该技术涉及为视觉训练数据生成高度描述性的标题。因此,模型能够更忠实地遵循用户的文本指令生成视频。

除了能够仅通过文本指令生成视频之外,该模型还能够接收现有的静止图像并从中生成视频,以准确且关注细节地对图像内容进行动画处理。该模型还可以接收现有视频并扩展其长度或填充缺失的帧。在OpenAI的技术报告中了解更多信息。

Sora作为能够理解和模拟真实世界的模型的基础,OpenAI认为这是实现通用人工智能的重要里程碑。

OpenAI推出最新的工具Sora之stack-of-tvs

7. 具体操作

-

使用Sora前的准备工作

在开始之前,确保您已经注册了OpenAI账户,并获得了Sora的访问权限。准备好您想要转化成视频的文本描述,记住越详细越好。 -

Sora使用步骤一:文本描述

登录您的OpenAI账户,找到Sora的使用界面。在指定区域输入您的文本描述,可以是一个故事概述、场景描述或是具体的动作指令。 -

Sora使用步骤二:生成视频

完成文本描述和自定义设置后,点击“生成视频”按钮。Sora将开始处理您的请求,这可能需要几分钟时间。完成后,您可以预览生成的视频。

OpenAI推出Sora之wooly-mammoth