本文来自DataLearnerAI官方网站:如何提高大模型在超长上下文的表现?Claude实验表明加一句prompt立即提升效果~ | 数据学习者官方网站(Datalearner) https://www.datalearner.com/blog/1051701947131881

https://www.datalearner.com/blog/1051701947131881

Claude 2.1版本的模型上下文长度最高拓展到200K,也是目前商用领域上下文长度支持最长的模型之一。但是,在模型发布不久之后,有人测试发现Claude 2.1模型在超过20K之后效果下降明显。但是Anthropic官方发布了一个说明解释这不是Claude模型本身在超长上下文的真实原因,主要是模型拒绝回答一些与文章主体不符的内容,实际中只需要一句prompt即可提高性能,将模型在超长上下文的水平准确率从27%提高到98%。

- Claude2.1的超长上下文水平简介

- 模型不愿意回答与文本不相干的内容

- 总结

Claude2.1的超长上下文水平简介

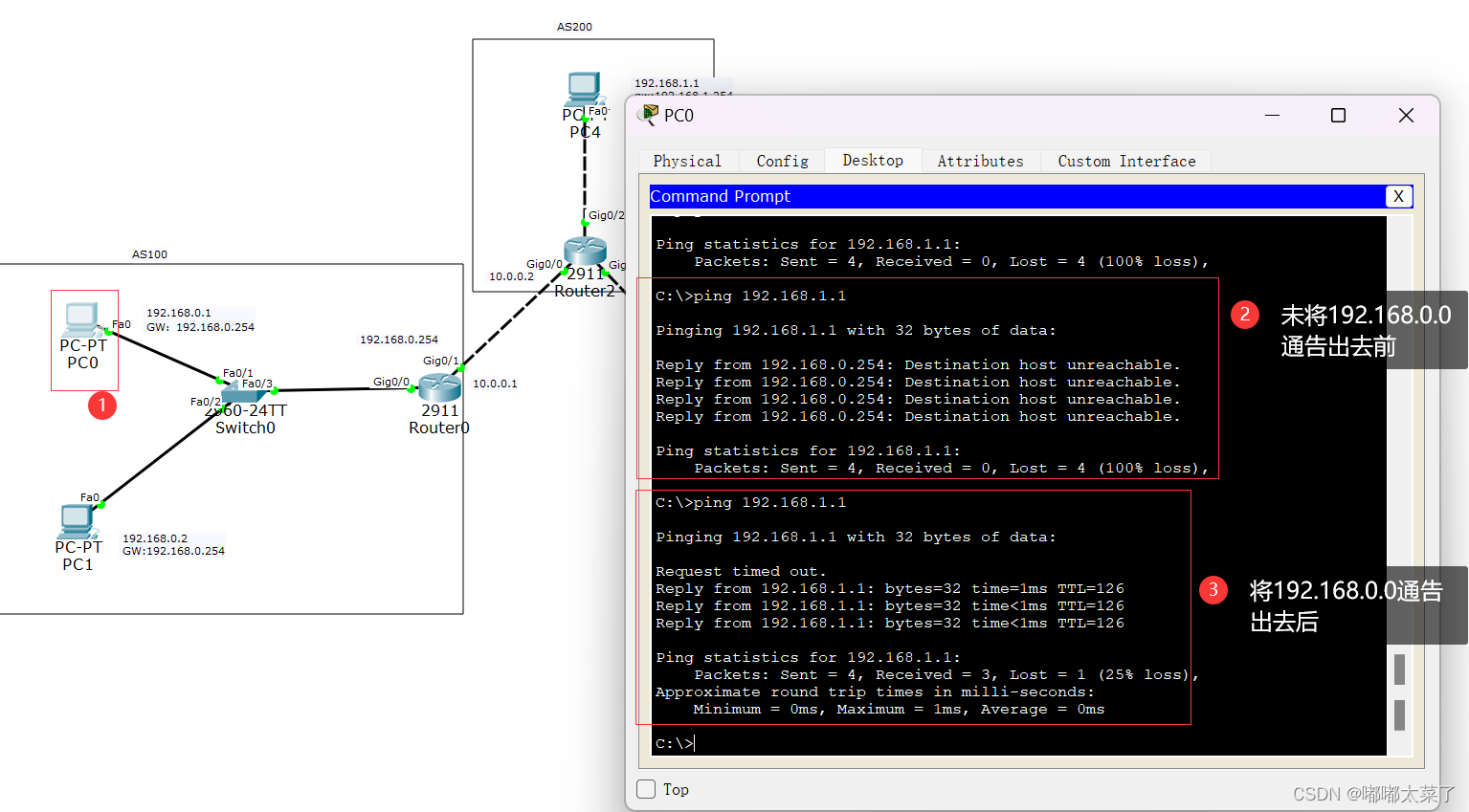

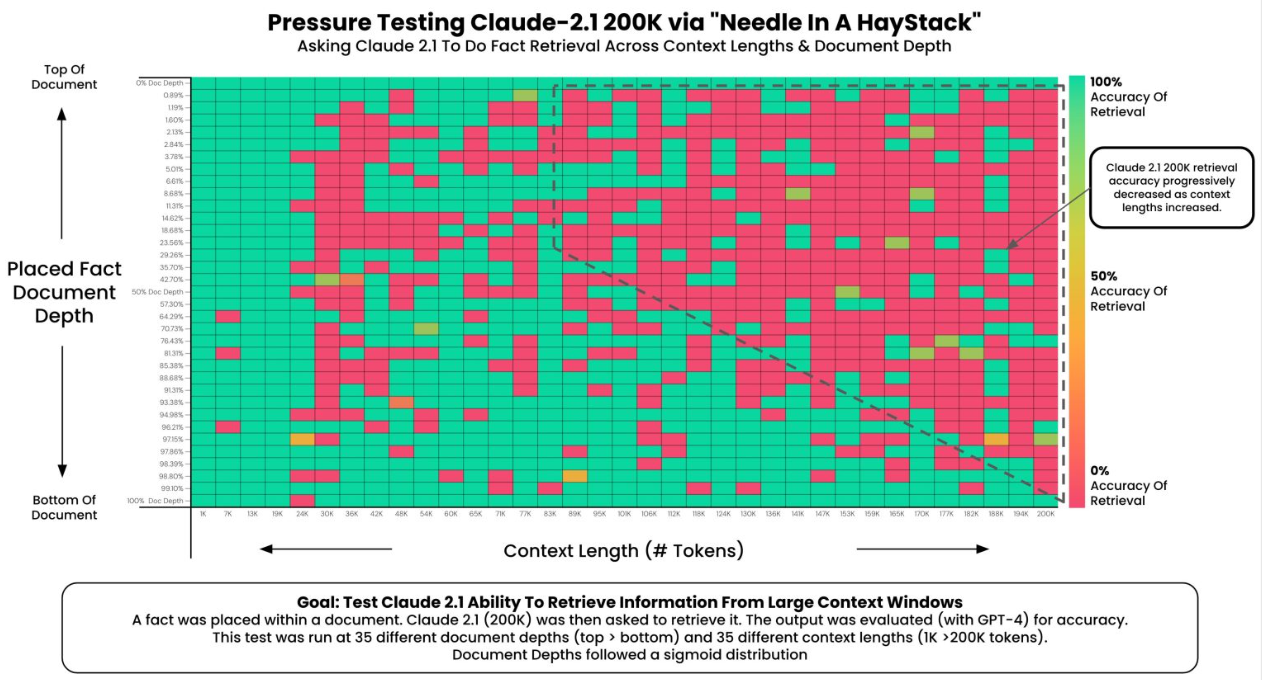

此前,有用户通过在超长上下文中注入一段特别的句子让模型回答用来测试大模型在超长上下文条件的表现(具体测试参考:GPT-4-Turbo的128K长度上下文性能如何?超过73K Tokens的数据支持依然不太好!)。

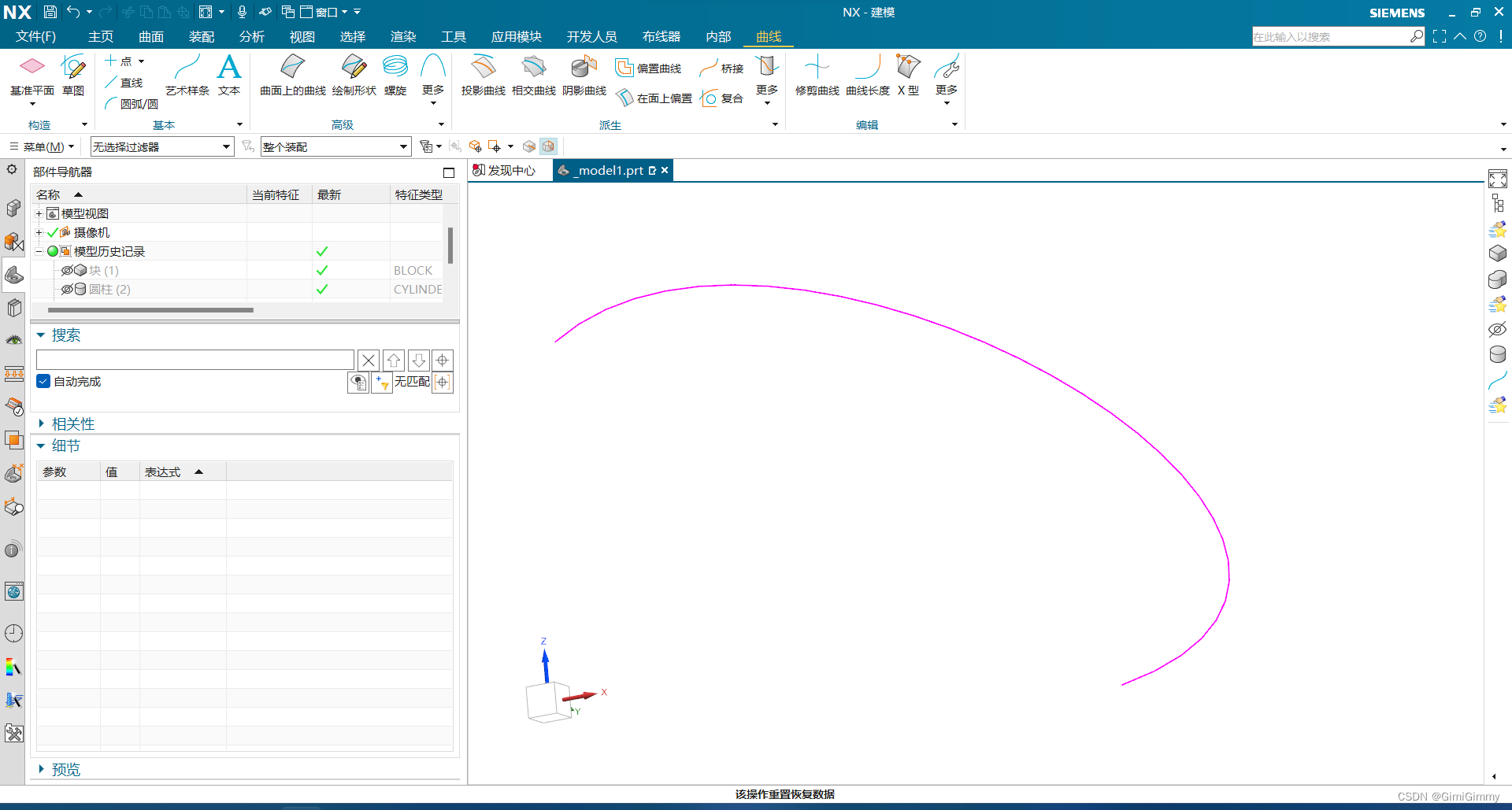

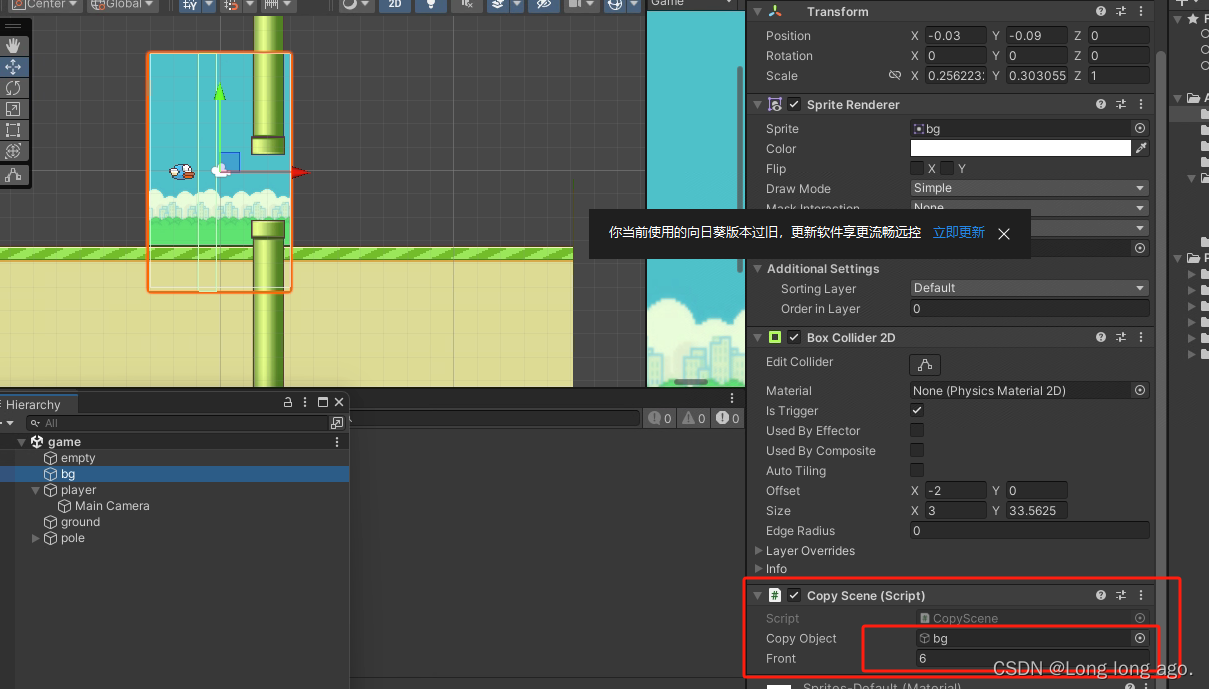

Claude-2.1-200K推出之后,作者做了同样的测试,发现Claude-2.1表现非常差:

可以看到,当文档长度超过20K之后,表现就非常差,与Anthropic官方的说法差别很大。

而今天,Anthropic官方发布了一个博客解释,这个不是因为Claude模型能力不行,而是测试的方式不太好。

模型不愿意回答与文本不相干的内容

为了减少错误和避免提出无依据的声明,Claude 2.1被训练成在没有足够信息支持回答时不回答问题。这意味着如果文档没有提供足够的信息来明确回答一个问题,模型可能会选择不作回答。模型的训练数据可能包括减少不准确性的特定任务。如果模型在训练过程中接收到避免错误和不准确声明的强烈信号,它可能会在实际应用中表现出更多的谨慎。进而导致上述情况出现。

而进一步的,Anthropic发现可以通过简单的prompt提示就可以提高模型不愿意回答不相关内容的效果,即让模型回答问题之前,加上一句“Here is the most relevant sentence in the context:”即可大幅提升模型回答效果,改进模型不愿意回答不相关内容的水平。