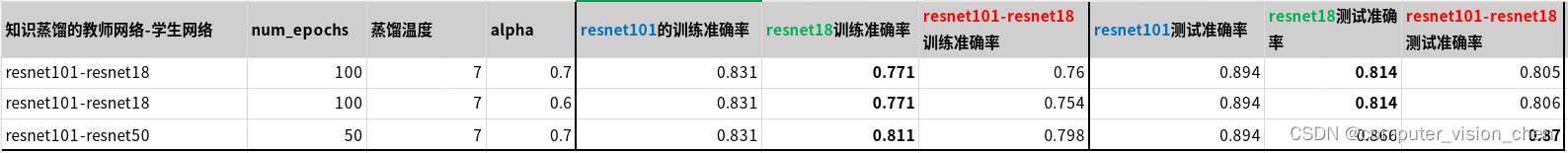

当教师网络为resnet101,学生网络为resnet18时:

使用蒸馏方法训练的resnet18训练准确率都小于单独训练resnet18,使用蒸馏方法反而导致了下降。

当hard_loss的alpha为0.7时,下降了1.1

当hard_loss的alpha为0.6时,下降了1.7

说明当学生网络和教师网络训练准确率相差不多时,要给hard_loss权重大一点。

待更新

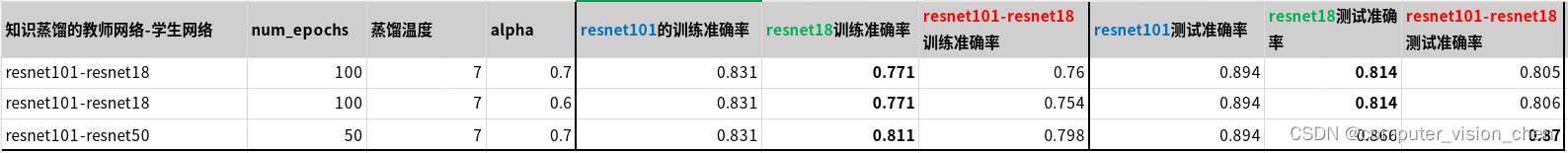

当教师网络为resnet101,学生网络为resnet18时:

使用蒸馏方法训练的resnet18训练准确率都小于单独训练resnet18,使用蒸馏方法反而导致了下降。

当hard_loss的alpha为0.7时,下降了1.1

当hard_loss的alpha为0.6时,下降了1.7

说明当学生网络和教师网络训练准确率相差不多时,要给hard_loss权重大一点。

待更新

本文来自互联网用户投稿,该文观点仅代表作者本人,不代表本站立场。本站仅提供信息存储空间服务,不拥有所有权,不承担相关法律责任。如若转载,请注明出处:http://www.coloradmin.cn/o/1277045.html

如若内容造成侵权/违法违规/事实不符,请联系多彩编程网进行投诉反馈,一经查实,立即删除!