这周接着详细解析小白YOLOv5全流程-训练+实现数字识别_牛大了2022的博客-CSDN博客_yolov5识别数字,上周入门教大家下载配置环境,如果没有的话请参考上周的文章深度学习Week11-调用官方权重进行检测(YOLOv5)_牛大了2022的博客-CSDN博客

一、准备自己的数据集

提供一个数据集:🔗水果检测

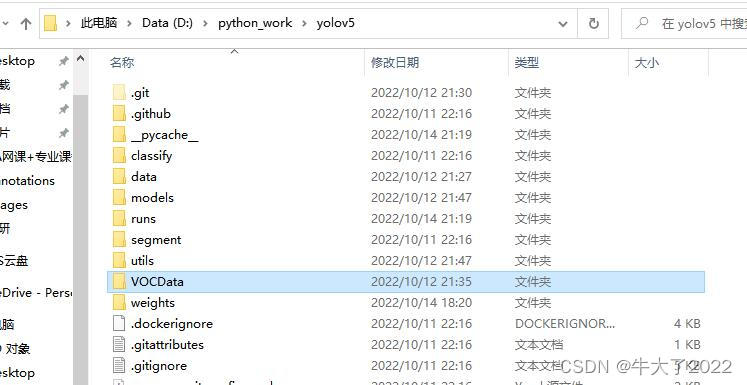

1.在yolov5文件夹下新建一个文件夹,这里取名为VOCData

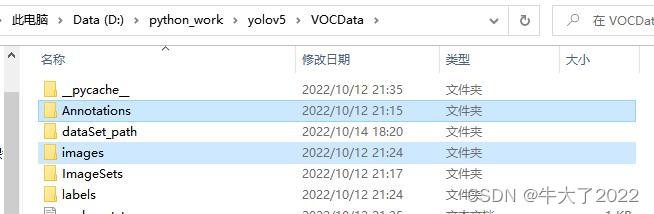

2.进入后新建两个文件夹 Annotations 和 images(图中多余是之后生成的)

images:用于存放要标注的图片(jpg格式)

Annotations :用于存放标注图片后产生的内容(XML格式)

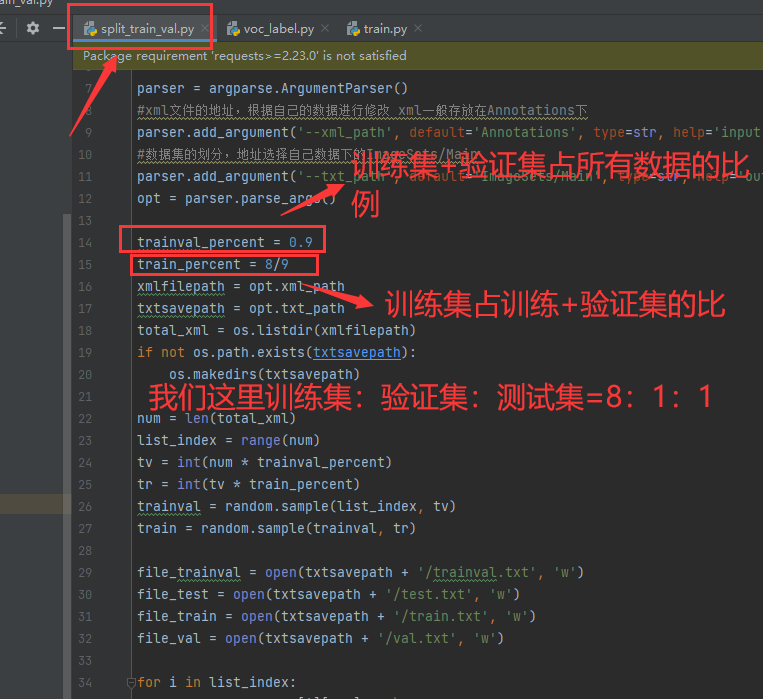

二、运行 split_train_val.py 文件

1.在VOCData目录下创建程序 split_train_val.py 并运行

不用修改

# coding:utf-8

import os

import random

import argparse

parser = argparse.ArgumentParser()

#xml文件的地址,根据自己的数据进行修改 xml一般存放在Annotations下

parser.add_argument('--xml_path', default='Annotations', type=str, help='input xml label path')

#数据集的划分,地址选择自己数据下的ImageSets/Main

parser.add_argument('--txt_path', default='ImageSets/Main', type=str, help='output txt label path')

opt = parser.parse_args()

trainval_percent = 1.0 # 训练集和验证集所占比例。 这里没有划分测试集

train_percent = 0.9 # 训练集所占比例,可自己进行调整

xmlfilepath = opt.xml_path

txtsavepath = opt.txt_path

total_xml = os.listdir(xmlfilepath)

if not os.path.exists(txtsavepath):

os.makedirs(txtsavepath)

num = len(total_xml)

list_index = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list_index, tv)

train = random.sample(trainval, tr)

file_trainval = open(txtsavepath + '/trainval.txt', 'w')

file_test = open(txtsavepath + '/test.txt', 'w')

file_train = open(txtsavepath + '/train.txt', 'w')

file_val = open(txtsavepath + '/val.txt', 'w')

for i in list_index:

name = total_xml[i][:-4] + '\n'

if i in trainval:

file_trainval.write(name)

if i in train:

file_train.write(name)

else:

file_val.write(name)

else:

file_test.write(name)

file_trainval.close()

file_train.close()

file_val.close()

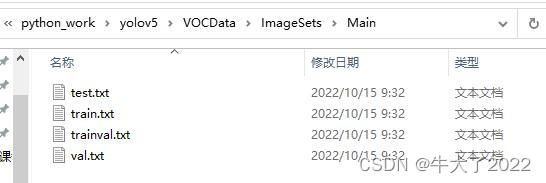

file_test.close()运行完后会在VOCData\ImagesSets\Main下生成 测试集、训练集、训练验证集和验证集

注:如何修改数据集中训练集、验证集、测试集的比例? 请参考:

三、生成 train.txt、test.txt、val.txt 文件

我之前并没有涉及到这一步,这里放出来供大家参考。类似于我文章中将xml格式转为yolo_txt格式 这一步

在VOCData目录下新建并运行voc_label.py

# -*- coding: utf-8 -*-

import xml.etree.ElementTree as ET

import os

from os import getcwd

sets = ['train', 'val', 'test']

classes = ["unripe citrus"] # 改成自己的类别

abs_path = os.getcwd()

print(abs_path)

def convert(size, box):

dw = 1. / (size[0])

dh = 1. / (size[1])

x = (box[0] + box[1]) / 2.0 - 1

y = (box[2] + box[3]) / 2.0 - 1

w = box[1] - box[0]

h = box[3] - box[2]

x = x * dw

w = w * dw

y = y * dh

h = h * dh

return x, y, w, h

def convert_annotation(image_id):

in_file = open('./Annotations/%s.xml' % (image_id), encoding='UTF-8')

out_file = open('./labels/%s.txt' % (image_id), 'w')

tree = ET.parse(in_file)

root = tree.getroot()

size = root.find('size')

w = int(size.find('width').text)

h = int(size.find('height').text)

for obj in root.iter('object'):

difficult = obj.find('difficult').text

cls = obj.find('name').text

if cls not in classes or int(difficult) == 1:

continue

cls_id = classes.index(cls)

xmlbox = obj.find('bndbox')

b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),

float(xmlbox.find('ymax').text))

b1, b2, b3, b4 = b

# 标注越界修正

if b2 > w:

b2 = w

if b4 > h:

b4 = h

b = (b1, b2, b3, b4)

bb = convert((w, h), b)

out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')

wd = getcwd()

for image_set in sets:

if not os.path.exists('./labels/'):

os.makedirs('./labels/')

image_ids = open('./ImageSets/Main/%s.txt' % (image_set)).read().strip().split()

list_file = open('./%s.txt' % (image_set), 'w')

for image_id in image_ids:

list_file.write(abs_path + '/images/%s.png\n' % (image_id)) # 注意你的图片格式,如果是.jpg记得修改

convert_annotation(image_id)

list_file.close()

运行后会得到 train.txt、test.txt、val.txt三个文件

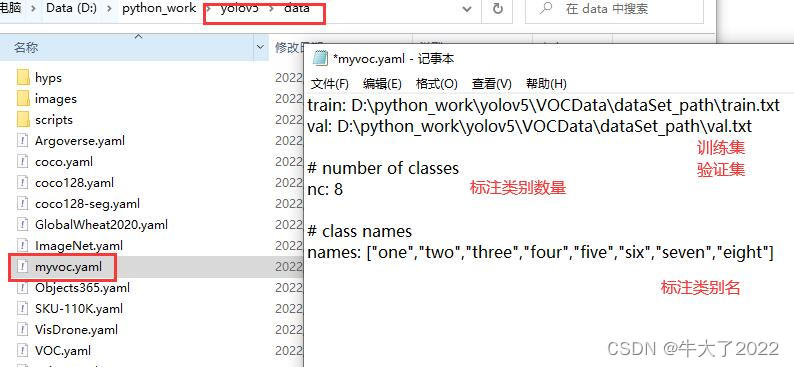

四、创建 .yaml 文件

在 yolov5 目录下的 data 文件夹下 新建一个 myvoc.yaml文件(可以自定义命名),用记事本打开。

内容是:

训练集以及验证集(train.txt和val.txt)的路径(可以改为相对路径)

以及 目标的类别数目和类别名称。

//注意:冒号后面要加空格

train: D:\python_work\yolov5\VOCData\dataSet_path\train.txt //如果执行这篇文章第三步,位置就是VOCData下面的train.txt 和 val.txt

val: D:\python_work\yolov5\VOCData\dataSet_path\val.txt# number of classes

nc: 8# class names

names: ["one","two","three","four","five","six","seven","eight"] //改成自己的类别

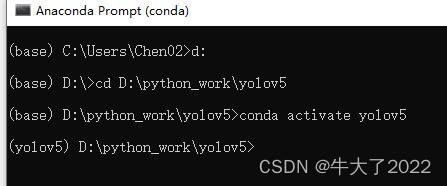

五、开始用自己的数据集训练模型

打开anaconda终端,选到yolov5的文件下,并激活相应的环境(我起名是yolov5)

接着输入如下训练命令:

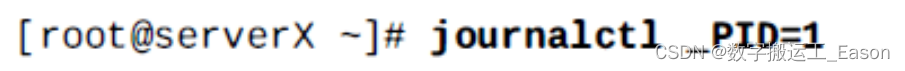

python train.py --img 900 --batch 2 --epoch 100 --data data/ab.yaml --cfg models/yolov5s.yaml --weights weights/yolov5s.pt --device '0'

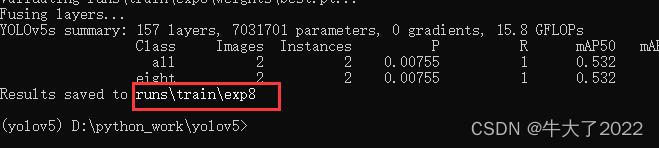

然后就开始训练了,最后训练好的模型会被保存在 yolov5 目录下的 runs/train/weights/expxx下。

测试效果我上周的入门和全流程最后一节都有讲,这里不在赘述~

注: 如果你是采用pycharm右键训练的,记得将batch-size下调,否则可能会报yolov5训练时报错 OSError: [WinError 1455] 页面文件太小,无法完成操作。 Error loading的错误

![【GO】K8s 管理系统项目[API部分--Pv]](https://img-blog.csdnimg.cn/d31bda7771094ff9ad9f62c7311f485f.png)