在进行数据采集时,经常会遇到被目标网站封禁IP的情况,这给爬虫系统带来了困扰。本文将介绍如何提升爬虫IP的时效,解决被封IP的难题,帮助您顺利进行数据采集,不再受限于IP封禁。

第一步:使用爬虫IP

使用爬虫IP是提升爬虫时效的一种常见方法。爬虫IP可以隐藏真实IP地址,并模拟使用不同IP进行访问,从而避免被目标网站封禁。以下是一些步骤可以帮助您使用爬虫IP:

1、获取爬虫IP池:可以通过购买爬虫IP服务或使用免费的爬虫IP提供商来获取爬虫IP池。

2、随机选择爬虫IP:在发送HTTP请求之前,从爬虫IP池中随机选择一个爬虫IP,并将其加入请求头中,以实现IP的随机切换。

3、监测爬虫IP的可用性:定期检查爬虫IP的可用性,排除无效的爬虫IP,保持爬虫IP池的质量和稳定性。

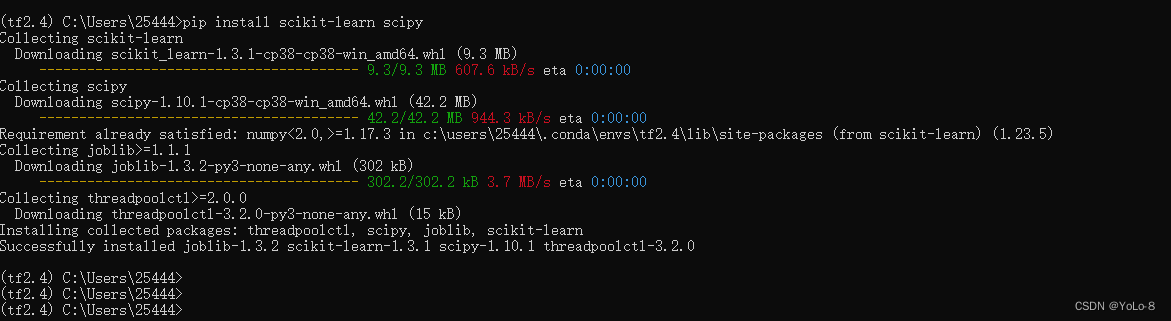

示例代码:

以下是一个使用Python的Requests库和爬虫IP池的示例代码:

import requests

from random import choice

# 获取爬虫IP池

proxy_pool = ['117.251.85.192:8080', '106.0.38.187:3128', '183.89.47.249:8080']

# 随机选择爬虫IP

proxy_ip = choice(proxy_pool)

# 设置爬虫IP参数

proxies = {

'http': f'http://{proxy_ip}',

'https': f'http://{proxy_ip}',

}

# 发送HTTP请求,并通过爬虫IP获取响应数据

response = requests.get('http://www.example.com', proxies=proxies)

data = response.text

# 对响应数据进行处理

# ...

# 关闭HTTP连接

response.close()

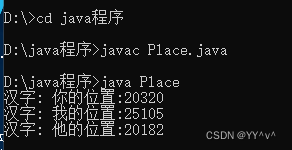

第二步:使用IP池管理器

使用自建的IP池管理器是另一种提升爬虫IP时效的方法。通过管理器自动查找、筛选和验证可用的IP,爬虫系统可以及时获取可用IP并进行使用,避免被封IP的问题。以下是一些步骤可以帮助您使用IP池管理器:

1、获取IP资源:可以通过购买IP资源或使用公开的免费IP资源来建立IP池。

2、IP验证和筛选:通过发送简单的HTTP请求,验证IP的可用性。同时,对验证通过的IP进行筛选,保证IP池的质量和稳定性。

3、IP池管理器:开发一个IP池管理器,负责从IP池中获取可用IP,并动态分配给爬虫系统进行使用。

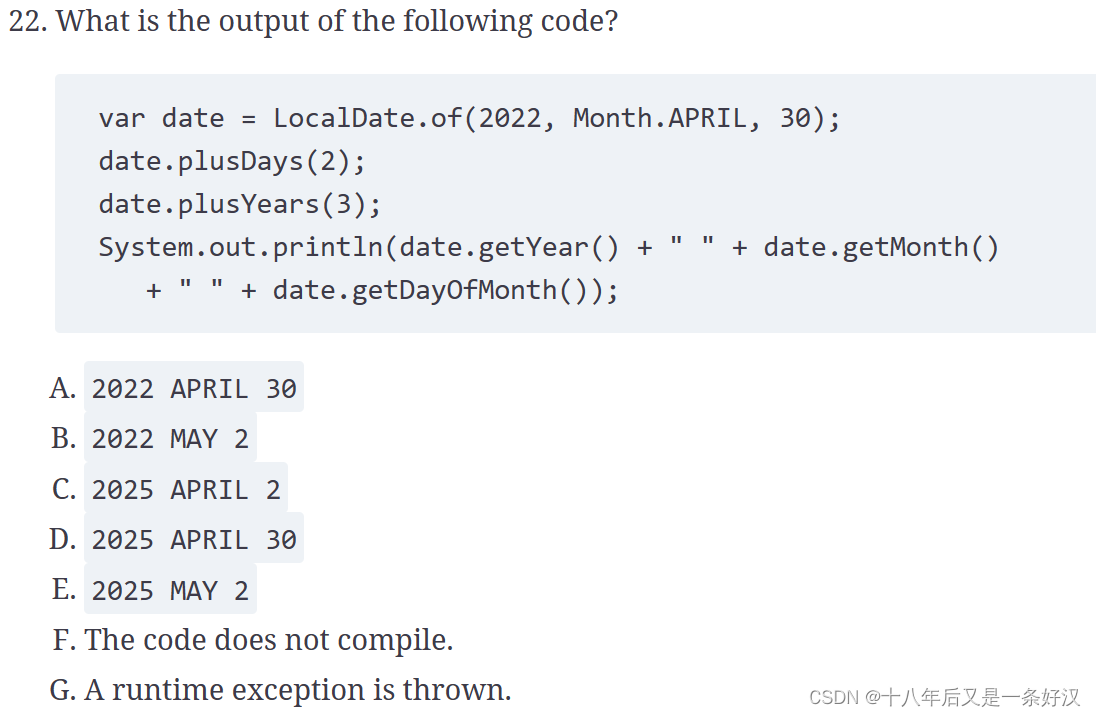

示例代码:

以下是一个简单的IP池管理器的示例代码:

import requests

from queue import Queue

from threading import Thread

# IP池管理器类

class IPManager:

def __init__(self):

self.ip_pool = Queue()

self.verify_ips()

# 验证IP的可用性

def verify_ip(self, ip):

proxies = {

'http': f'http://{ip}',

'https': f'http://{ip}',

}

try:

response = requests.get('http://www.example.com', proxies=proxies, timeout=5)

if response.status_code == 200:

self.ip_pool.put(ip)

response.close()

except:

pass

# 验证IP池中所有IP的可用性

def verify_ips(self):

ip_list = ['117.251.85.192:8080', '106.0.38.187:3128', '183.89.47.249:8080']

threads = []

for ip in ip_list:

t = Thread(target=self.verify_ip, args=(ip,))

threads.append(t)

t.start()

for t in threads:

t.join()

# 从IP池中获取一个可用IP

def get_ip(self):

return self.ip_pool.get()

# 创建IP池管理器实例

ip_manager = IPManager()

# 在爬虫中调用IP池管理器获取IP

ip = ip_manager.get_ip()

# 发送HTTP请求,使用获取到的IP

proxies = {

'http': f'http://{ip}',

'https': f'http://{ip}',

}

response = requests.get('http://www.example.com', proxies=proxies)

data = response.text

# 对响应数据进行处理

# ...

# 关闭HTTP连接

response.close()

使用爬虫IP或自建IP池管理器可以避免被目标网站封禁,确保爬虫系统的正常运行。在使用爬虫IP或自建IP池管理器时,需要注意IP的质量和稳定性,及时验证和更新IP池。希望这些方法可以帮助您顺利进行数据采集,从而取得更好的效果和结果!