在进行网络爬虫时,经常会遇到需要切换爬虫ip的情况,以绕过限制或保护自己的爬虫请求。今天,我将为你介绍Python爬虫中自动切换爬虫ip的终极方案,让你的爬虫更加高效稳定。

步骤一:准备爬虫ip池

首先,你需要准备一个可靠的爬虫ip池。爬虫ip池是由多个爬虫ip组成的集合,可以通过API或爬虫获取。你可以选择自建爬虫ip池,也可以使用第三方的IP服务器。确保爬虫ip池的质量和稳定性,这样才能保证切换到的爬虫ip可用且不会频繁失效。

步骤二:封装爬虫ip切换器

接下来,你需要封装一个爬虫ip切换器,用于实现自动切换爬虫ip的功能。这个切换器可以是一个独立的类或函数,负责从爬虫ip池中获取可用的爬虫ip,并对爬虫请求进行代理设置。

以下是一个示例的Python代码:

import requests

class ProxySwitcher:

def __init__(self, proxy_pool_url):

self.proxy_pool_url = proxy_pool_url

self.proxies = self.get_proxies()

def get_proxies(self):

response = requests.get(self.proxy_pool_url)

proxies = response.json()

return proxies

def get_proxy(self):

proxy = self.proxies.pop(0)

self.proxies.append(proxy)

return proxy

def make_request(self, url):

proxy = self.get_proxy()

proxies = {

'http': 'http://' + proxy,

'https': 'https://' + proxy

}

try:

response = requests.get(url, proxies=proxies)

if response.status_code == 200:

return response.text

else:

return None

except requests.exceptions.RequestException:

return None

# 使用示例

proxy_pool_url = 'http://your-proxy-pool-api-url' # 替换成你的爬虫ip池API地址

proxy_switcher = ProxySwitcher(proxy_pool_url)

response = proxy_switcher.make_request('http://example.com')

print(response)

在上面的示例代码中,我们首先通过get_proxies方法从爬虫ip池中获取爬虫ip列表。然后,在每次发起请求时,使用get_proxy方法获取下一个可用的爬虫ip,并将其应用于请求的proxies参数中。

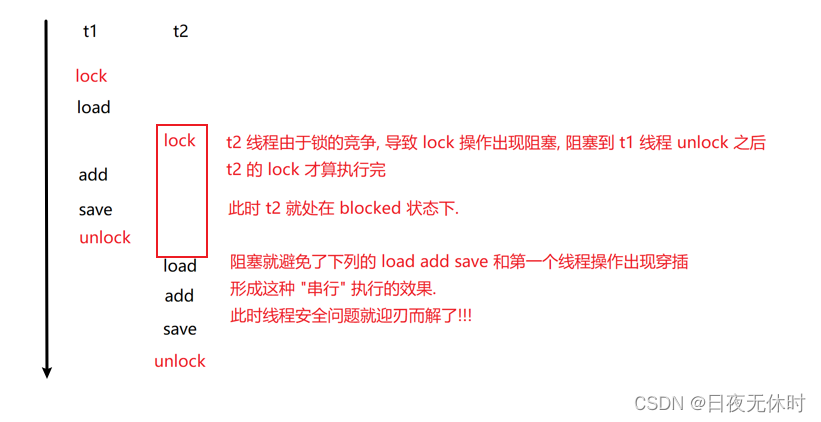

步骤三:设置请求间隔和异常处理

在爬虫中,合理的请求间隔和异常处理是非常重要的。如果过于频繁地切换爬虫ip或请求过于密集,容易引起目标网站的反爬机制。因此,在爬虫ip切换器中,你可以设置请求之间的时间间隔,以避免过度频繁的请求。

此外,还要注意处理爬虫ip失效或请求异常的情况。如果某个爬虫ip失效,可以将其从爬虫ip列表中移除,并记录日志进行排查。对于请求异常的情况,你可以根据具体情况进行重试、切换其他爬虫ip或采取其他策略来保证爬虫的稳定性和可靠性。

步骤四:监控爬虫ip池和优化策略

最后,要定期监控爬虫ip池的可用性和质量,并根据需要进行优化策略。你可以设置定时任务或使用监控工具来检测爬虫ip的响应速度、可用性等指标,及时发现并剔除不可用的爬虫ip。另外,还可以考虑采用多个爬虫ip池、自动验证爬虫ip等方法来提高爬虫ip的质量和稳定性。

通过以上步骤,你就可以实现Python爬虫中自动切换爬虫ip的终极方案。这样的方案能够让你的爬虫在面对反爬机制或限制时保持高效稳定的运行。记住合理使用爬虫ip、遵守网站规则,保持良好的爬虫行为,让你的爬虫世界更加广袤与自由!

希望本文对你有所帮助!